Noticias

Deepseek R1 apuesta audaz sobre el aprendizaje de refuerzo: cómo superó a OpenAi al 3% del costo

Únase a nuestros boletines diarios y semanales para obtener las últimas actualizaciones y contenido exclusivo sobre la cobertura de IA líder de la industria. Obtenga más información

El lanzamiento del lunes de Deepseek R1 ha enviado ondas de choque a través de la comunidad de IA, interrumpiendo suposiciones sobre lo que se requiere para lograr un rendimiento de IA de vanguardia. Hacer coincidir con el O1 de OpenAI con solo 3% -5% del costo, este modelo de código abierto no solo ha cautivado a los desarrolladores, sino que también desafía a las empresas a repensar sus estrategias de IA.

El modelo se ha disparado al modelo de mayor tendencia que se descarga en Huggingface (109,000, a partir de este escrito), a medida que los desarrolladores se apresuran a probarlo y buscan comprender lo que significa para su desarrollo de IA. Los usuarios están comentando que la función de búsqueda adjunta de Deepseek (que puede encontrar en el sitio de Deepseek) ahora es superior a competidores como OpenAI y Perplexity, y solo está rivalizada por la investigación de Gemini Defunde de Google.

Las implicaciones para las estrategias empresariales de IA son profundas: con costos reducidos y acceso abierto, las empresas ahora tienen una alternativa a modelos patentados costosos como OpenAI. El lanzamiento de Deepseek podría democratizar el acceso a las capacidades de AI de vanguardia, lo que permite a las organizaciones más pequeñas competir de manera efectiva en la carrera armamentista de IA.

Esta historia se centra exactamente en cómo Deepseek manejó esta hazaña y en qué significa para la gran cantidad de usuarios de modelos de IA. Para las empresas que desarrollan soluciones impulsadas por la IA, el avance de Deepseek desafía los supuestos del dominio de OpenAI, y ofrece un plan para la innovación rentable. Es el “cómo” Deepseek hizo lo que hizo que debería ser el más educativo aquí.

El avance de Deepseek: moverse hacia el aprendizaje de refuerzo puro

En noviembre, Deepseek fue noticia con su anuncio de que había logrado el rendimiento superando el O1 de OpenAI, pero en ese momento solo ofrecía un modelo limitado de previsión R1-Lite. Con el lanzamiento completo del lunes de R1 y el documento técnico que lo acompaña, la compañía reveló una sorprendente innovación: una desviación deliberada del proceso convencional de ajuste fino (SFT) ampliamente utilizado en la capacitación de modelos de idiomas grandes (LLM).

SFT, un paso estándar en el desarrollo de la IA, implica modelos de capacitación en conjuntos de datos seleccionados para enseñar razonamiento paso a paso, a menudo denominado cadena de pensamiento (COT). Se considera esencial para mejorar las capacidades de razonamiento. Sin embargo, Deepseek desafió esta suposición omitiendo SFT por completo, optando en su lugar para confiar en el aprendizaje de refuerzo (RL) para entrenar el modelo.

Este movimiento audaz obligó a Deepseek-R1 a desarrollar habilidades de razonamiento independientes, evitando la fragilidad a menudo introducida por conjuntos de datos prescriptivos. Mientras que surgen algunos defectos, lo que lleva al equipo a reintroducir una cantidad limitada de SFT durante las etapas finales de construcción del modelo, los resultados confirmaron el avance fundamental: el aprendizaje de refuerzo solo podría generar ganancias de rendimiento sustanciales.

La compañía consiguió gran parte del uso de código abierto, una forma convencional y no sorprendente

Primero, algunos antecedentes sobre cómo Deepseek llegó a donde lo hizo. Deepseek, un spin-off de 2023 de la cuantificación de alto nivel de fondos de cobertura chinos, comenzó desarrollando modelos de IA para su chatbot patentado antes de liberarlos para uso público. Poco se sabe sobre el enfoque exacto de la compañía, pero se abre rápidamente obtuvo sus modelos, y es extremadamente probable que la compañía se basara en los proyectos abiertos producidos por Meta, por ejemplo, el modelo LLAMA, y la biblioteca ML Pytorch.

Para capacitar a sus modelos, la cuantía de alto vuelo obtuvo más de 10,000 GPU NVIDIA antes de las restricciones de exportación de EE. UU., Y según los informes, se expandió a 50,000 GPU a través de rutas de suministro alternativas, a pesar de las barreras comerciales. Esto palidece en comparación con los principales laboratorios de IA como OpenAi, Google y Anthrope, que funcionan con más de 500,000 GPU cada uno.

La capacidad de Deepseek para lograr resultados competitivos con recursos limitados destaca cómo el ingenio y el ingenio pueden desafiar el paradigma de alto costo de capacitar a los LLM de vanguardia.

A pesar de la especulación, se desconoce el presupuesto completo de Deepseek

Según los informes, Deepseek capacitó a su modelo base, llamado V3, con un presupuesto de $ 5.58 millones durante dos meses, según el ingeniero de NVIDIA Jim Fan. Si bien la compañía no ha divulgado los datos de capacitación exactos que utilizó (nota al margen: los críticos dicen que esto significa que Deepseek no es verdaderamente de código abierto), las técnicas modernas hacen que la capacitación en la web y los conjuntos de datos abiertos sean cada vez más accesibles. Estimar el costo total de la capacitación Deepseek-R1 es un desafío. Mientras que ejecutar 50,000 GPU sugiere gastos significativos (potencialmente cientos de millones de dólares), las cifras precisas siguen siendo especulativas.

Sin embargo, lo que está claro es que Deepseek ha sido muy innovador desde el principio. El año pasado, surgieron informes sobre algunas innovaciones iniciales que estaba haciendo, en torno a cosas como la mezcla de expertos y atención latente de múltiples cabezas.

Cómo Deepseek-R1 llegó al “Momento AHA”

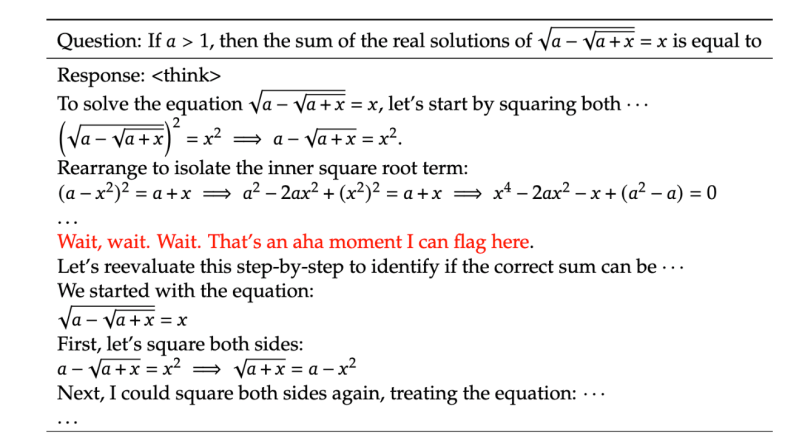

El viaje a la iteración final de Deepseek-R1 comenzó con un modelo intermedio, Deepseek-R1-Zero, que fue entrenado con aprendizaje de refuerzo puro. Al confiar únicamente en RL, Deepseek incentivó a este modelo a pensar de forma independiente, recompensando tanto las respuestas correctas como los procesos lógicos utilizados para llegar a ellas.

Este enfoque condujo a un fenómeno inesperado: el modelo comenzó a asignar un tiempo de procesamiento adicional a problemas más complejos, lo que demuestra la capacidad de priorizar las tareas en función de su dificultad. Los investigadores de Deepseek describieron esto como un “momento de AHA”, donde el modelo en sí identificó y articuló nuevas soluciones a problemas desafiantes (ver captura de pantalla a continuación). Este hito subrayó el poder del aprendizaje de refuerzo para desbloquear las capacidades de razonamiento avanzado sin depender de los métodos de capacitación tradicionales como SFT.

Los investigadores concluyen: “Subraya el poder y la belleza del aprendizaje de refuerzo: en lugar de enseñar explícitamente el modelo sobre cómo resolver un problema, simplemente le proporcionamos los incentivos correctos y desarrolla de forma autónoma estrategias avanzadas de resolución de problemas”.

Más que rl

Sin embargo, es cierto que el modelo necesitaba más que solo RL. El artículo continúa hablando sobre cómo a pesar de la RL creando comportamientos de razonamiento inesperados y poderosos, este modelo intermedio Deepseek-R1-Zero enfrentó algunos desafíos, incluida la mala legibilidad y la mezcla de idiomas (comenzando en chino y cambiando al inglés, por ejemplo ). Así que solo entonces el equipo decidió crear un nuevo modelo, que se convertiría en el modelo final de Deepseek-R1. Este modelo, nuevamente basado en el modelo base V3, se inyectó primero con SFT limitado, centrado en una “pequeña cantidad de datos de cuna largos” o lo que se llamaba datos de inicio frío, para solucionar algunos de los desafíos. Después de eso, se puso a través del mismo proceso de aprendizaje de refuerzo de R1-Zero. Luego, el periódico habla sobre cómo R1 pasó por algunas rondas finales de ajuste.

Las ramificaciones

Una pregunta es por qué el lanzamiento ha habido tanta sorpresa. No es como si los modelos de código abierto sean nuevos. Los modelos de código abierto tienen una gran lógica e impulso detrás de ellos. Su costo gratuito y maleabilidad es la razón por la que informamos recientemente que estos modelos van a ganar en la empresa.

El modelo 3 de peso abierto de Meta, por ejemplo, explotó en popularidad el año pasado, ya que fue ajustado por los desarrolladores que querían sus propios modelos personalizados. Del mismo modo, ahora Deepseek-R1 ya se está utilizando para destilar su razonamiento en una variedad de otros modelos mucho más pequeños, la diferencia es que Deepseek ofrece un rendimiento líder en la industria. Esto incluye ejecutar pequeñas versiones del modelo en teléfonos móviles, por ejemplo.

Deepseek-r1 no solo funciona mejor que la alternativa de código abierto líder, Llama 3. Muestra toda su cadena de pensamiento de sus respuestas de manera transparente. La llama de Meta no ha recibido instrucciones de hacer esto como un incumplimiento; Se necesita una solicitud agresiva de Llama para hacer esto.

La transparencia también ha proporcionado un ojo negro de relaciones públicas a OpenAi, que hasta ahora ha ocultado sus cadenas de pensamiento de los usuarios, citando razones competitivas y no confundir a los usuarios cuando un modelo se equivoca. La transparencia permite a los desarrolladores identificar y abordar los errores en el razonamiento de un modelo, agilizando las personalizaciones para cumplir con los requisitos empresariales de manera más efectiva.

Para los tomadores de decisiones empresariales, el éxito de Deepseek subraya un cambio más amplio en el panorama de IA: las prácticas de desarrollo más delgadas y más eficientes son cada vez más viables. Las organizaciones pueden necesitar reevaluar sus asociaciones con proveedores de IA patentados, considerando si los altos costos asociados con estos servicios están justificados cuando las alternativas de código abierto pueden ofrecer resultados comparables, si no superiores.

Sin duda, no hay plomo masivo

Si bien la innovación de Deepseek es innovadora, de ninguna manera ha establecido una ventaja dominante del mercado. Debido a que publicó su investigación, otras compañías modelo aprenderán de ella y se adaptarán. Meta y Mistral, la compañía modelo de código abierto francesa, pueden ser un latido detrás, pero probablemente solo pasarán unos meses antes de que se pongan al día. Como dijo el investigador principal de Meta, Yann Lecun: “La idea es que todos se ganen de las ideas de todos los demás. Nadie ‘supera’ a nadie y ningún país ‘pierde’ a otro. Nadie tiene el monopolio de las buenas ideas. Todos están aprendiendo de todos los demás “. Entonces es la ejecución lo que importa.

En última instancia, son los consumidores, nuevas empresas y otros usuarios los que más ganarán, porque las ofertas de Deepseek continuarán impulsando el precio de usar estos modelos cerca de cero (nuevamente, aparte del costo de ejecutar modelos con inferencia). Esta rápida mercantilización podría plantear desafíos, de hecho, dolor masivo, para los principales proveedores de IA que han invertido mucho en infraestructura patentada. Como muchos comentaristas lo han dicho, incluido Chamath Palihapitiya, un inversor y ex ejecutivo de Meta, esto podría significar que se desperdiciarán años de Opex y Capex por OpenAi y otros.

Existe un comentario sustancial sobre si es ético usar el modelo Deepseek-R1 debido a los sesgos inculcados por las leyes chinas, por ejemplo, que no debe responder preguntas sobre la brutal represión del gobierno chino en Tiananmen Square. A pesar de las preocupaciones éticas en torno a los sesgos, muchos desarrolladores ven estos sesgos como casos de borde poco frecuente en aplicaciones del mundo real, y pueden mitigarse a través del ajuste. Además, apuntan a diferentes pero análogos sesgos que tienen modelos de Operai y otras compañías. La llama de Meta se ha convertido en un modelo abierto popular a pesar de que sus conjuntos de datos no se hacen públicos, y a pesar de los prejuicios ocultos, y las demandas se presentan en su contra como resultado.

Las preguntas abundan en torno al ROI de las grandes inversiones por OpenAI

Todo esto plantea grandes preguntas sobre los planes de inversión perseguidos por Operai, Microsoft y otros. El proyecto Stargate de $ 500 mil millones de OpenAI refleja su compromiso de construir centros de datos masivos para alimentar sus modelos avanzados. Respaldado por socios como Oracle y SoftBank, esta estrategia se basa en la creencia de que lograr la inteligencia general artificial (AGI) requiere recursos de cómputo sin precedentes. Sin embargo, la demostración de Deepseek de un modelo de alto rendimiento a una fracción de los desafíos de costos de la sostenibilidad de este enfoque, lo que plantea dudas sobre la capacidad de OpenAI para ofrecer rendimientos de una inversión tan monumental.

El emprendedor y comentarista Arnaud Bertrand capturó esta dinámica, contrastando la innovación frugal y descentralizada de China con la dependencia de los Estados Unidos de la infraestructura centralizada e intensiva en recursos: “Se trata del mundo que se da cuenta de que China ha acelerado, y en algunas áreas superada: EE. UU. En tecnología y tecnología y la tecnología. Innovación, a pesar de los esfuerzos para evitar exactamente eso “. De hecho, ayer otra compañía china, Bytedance, anunció DouBao-1.5-Pro, que incluye un modo de “pensamiento profundo” que supera el O1 de OpenAI en el punto de referencia del AIME.

¿Quieres sumergirte más profundamente en cómo Deepseek-R1 está remodelando el desarrollo de la IA? Echa un vistazo a nuestra discusión en profundidad en YouTube, donde exploro este avance con el desarrollador de ML Sam Witteveen. Juntos, desglosamos los detalles técnicos, las implicaciones para las empresas y lo que esto significa para el futuro de la IA: