OpenAI, la empresa de tecnología que creó el popular chatbot ChatGPT, se encuentra en una encrucijada.

Comenzó como una organización sin fines de lucro dedicada al desarrollo de sistemas de inteligencia artificial más inteligentes que los humanos. Desde su fundación, OpenAI se ha jactado de defender su objetivo sin fines de lucro: “construir inteligencia artificial general (AGI) que sea segura y beneficie a toda la humanidad”.

Ahora, su tono ha cambiado. Según se informa, el liderazgo de OpenAI está tomando medidas para transformarla en una empresa con fines de lucro. Si eso sucede, la organización sin fines de lucro perdería el control.

Somos profesores de derecho especializados en organizaciones sin fines de lucro. Como explicamos en un artículo anterior, todas las organizaciones benéficas deben dedicar sus activos a sus fines legales. Si OpenAI esperaba divorciarse rápidamente de sus obligaciones caritativas, ahora está aprendiendo lo costoso que podría ser.

Proponer el divorcio de votos caritativos

OpenAI comenzó en 2015 como una organización de investigación científica sin fines de lucro. Cuatro años más tarde, su junta directiva decidió que lograr sus nobles objetivos requería algo más que obsequios y subvenciones.

Se reorganizó para dar cabida y atraer la inversión privada. Como resultado, la empresa conocida como OpenAI no es una única empresa con o sin fines de lucro; es un conjunto de entidades entrelazadas, incluida la filial con fines de lucro que realiza sus operaciones.

En general, OpenAI es, en última instancia, necesario para promover los propósitos de la organización sin fines de lucro. Estos propósitos representan las promesas que OpenAI hizo al público cuando se fundó.

El certificado de constitución sin fines de lucro de OpenAI establece los propósitos: “proporcionar financiación para la investigación, el desarrollo y la distribución de tecnología relacionada con la inteligencia artificial”, produciendo así tecnología que “beneficiará al público”.

Durante casi una década, OpenAI proclamó su compromiso con el desarrollo científico seguro, convirtiéndolo en una prioridad mayor que la obtención de beneficios. Por ejemplo, OpenAI advirtió a los inversores que “es posible que la empresa nunca obtenga ganancias” y que “sería prudente considerar una inversión… con el espíritu de una donación”.

Sin embargo, si se obtenían ganancias, los inversores como Microsoft tenían derecho a recibirlas, recaudando hasta 100 veces su inversión, antes de que la empresa matriz sin fines de lucro pudiera tomar parte de esas ganancias.

Tener dudas

El director ejecutivo Sam Altman y sus colegas aparentemente han tenido dudas sobre sus votos.

Según informes generalizados de los medios de comunicación que citan fuentes anónimas, quieren reestructurar y eliminar a la empresa matriz sin fines de lucro de su puesto de control, convirtiendo el resto de la empresa en una empresa benéfica, un tipo de empresa con fines de lucro con algunos objetivos de interés público.

Esos informes de los medios transmiten que los 6.600 millones de dólares en inversiones recientes en OpenAI están condicionados a que OpenAI se convierta en una empresa con fines de lucro en un plazo de dos años.

Si esta conversión falla, OpenAI deberá devolver ese dinero. Los inversores también quieren eliminar los límites a los rendimientos de sus inversiones. Según se informa, el propio Altman ahora quiere poseer una parte de la empresa.

No moverse tan rápido

Cambiar una empresa sin fines de lucro a una empresa con fines de lucro, lo que se conoce como “conversión”, a menudo requiere solo una votación de la junta y la presentación de formularios ante los reguladores estatales.

Delaware, donde se estableció OpenAI, regularía al menos este proceso de presentación. Cuando una organización sin fines de lucro tiene operaciones importantes en otro estado, ese estado también tiene autoridad para regular la conversión. En este caso, sería California, donde OpenAI tiene su sede y posee la mayoría de sus activos.

Los fiscales generales estatales de Delaware y California están revisando la reestructuración propuesta. La fiscal general de Delaware, Kathy Jennings, ha solicitado más información sobre cómo se protegerían los derechos de la organización sin fines de lucro si OpenAI lleva a cabo sus planes de reestructuración informados.

Y el Fiscal General de California, Rob Bonta, anunció que su oficina está “comprometida a proteger los activos caritativos para el fin previsto”.

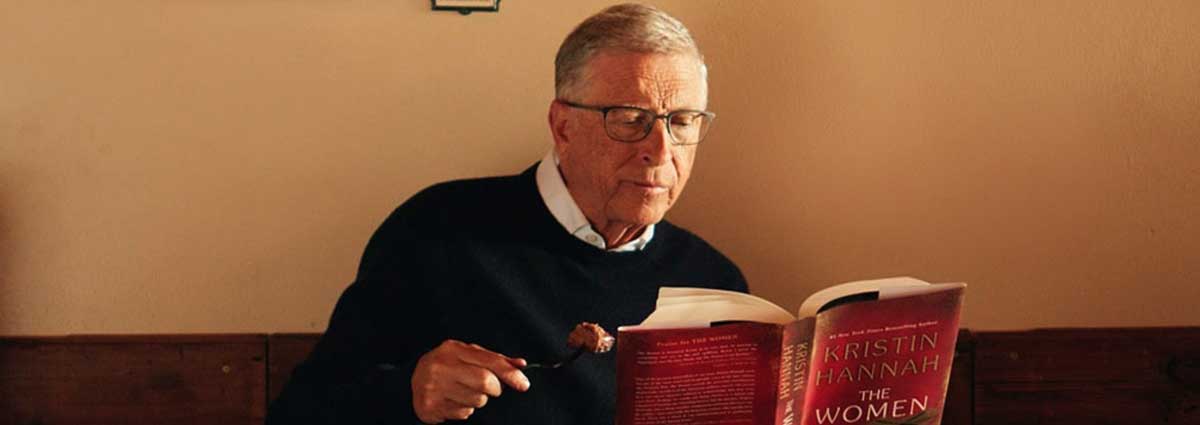

Con OpenAI valorada en 157 mil millones de dólares, la parte justa de la organización sin fines de lucro podría convertirla en la fundación más rica de Estados Unidos. La Fundación Bill y Melinda Gates, actualmente la fundación más grande con sede en Estados Unidos, posee 75.200 millones de dólares en activos. La donación de Harvard, la mayor para una universidad estadounidense, tiene alrededor de 53.200 millones de dólares en sus arcas.

Los reguladores estatales, que supervisan la transformación de organizaciones sin fines de lucro en organizaciones con fines de lucro, supervisaron muchas conversiones de aseguradoras de salud y hospitales en la década de 1990. Por ejemplo, el fiscal general de California supervisó los pagos de Blue Cross Blue Shield de California por 3.200 millones de dólares para establecer dos nuevas fundaciones de atención médica cuando se convirtió. Posteriormente, los críticos señalaron que los inversores en este tipo de empresas con fines de lucro obtuvieron ganancias aún mayores poco tiempo después.

Creemos que si la organización sin fines de lucro obtiene su parte justa de OpenAI, esas transacciones de atención médica palidecerían en comparación con la escala de una conversión de OpenAI.

Suriya Phosri/iStock vía Getty Images Plus

Estimando lo que está en juego

Sin duda, la organización sin fines de lucro no tendría derecho a recibir los 157 mil millones de dólares completos en una conversión de OpenAI. Entonces, ¿a qué tiene derecho la organización sin fines de lucro?

En primer lugar, la empresa matriz sin fines de lucro tiene derecho al valor de su participación en la propiedad de las operaciones con fines de lucro. Ese valor incluiría el valor de las propiedades propiedad de la subsidiaria con fines de lucro, como ChatGPT.

La organización sin fines de lucro también debería recibir compensación por renunciar a su control sobre toda la empresa OpenAI. Normalmente, los banqueros de inversión evalúan el valor del control entre el 20% y el 40% del valor de la empresa.

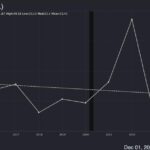

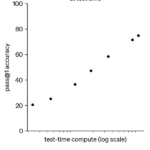

Lo que podría ser la parte más difícil de este proceso sería estimar el valor del derecho a las ganancias futuras de OpenAI. Según el acuerdo actual, los inversores primero obtienen 100 veces su inversión en OpenAI antes de que la organización sin fines de lucro reciba una parte de las ganancias.

Microsoft ha invertido hasta ahora 13 mil millones de dólares en OpenAI. Pero supongamos una inversión total de 10 mil millones de dólares: OpenAI necesitaría ganar 1 billón de dólares antes de que la organización sin fines de lucro obtenga su parte del pastel. Dado que sólo 10 empresas han ganado más de 100 veces la cantidad invertida en ellas en la última década, este es un listón muy alto.

Protegiendo a la organización sin fines de lucro

Aunque los fiscales generales estatales tienen el papel principal en la protección de las organizaciones sin fines de lucro, no tienen que hacer este trabajo solos.

En primer lugar, los miembros de la junta directiva de la organización sin fines de lucro existente están obligados legalmente a proteger la organización sin fines de lucro y sus propósitos. Esto los coloca aproximadamente en el mismo equipo que los fiscales generales estatales.

La junta podría decidir que la mejor manera de proteger los fines benéficos de OpenAI es escindiendo la empresa con fines de lucro. Aun así, debe garantizar que la organización sin fines de lucro reciba una compensación adecuada.

Otras autoridades pueden desempeñar un papel. Por ejemplo, si un fiscal general de un estado no puede negociar un acuerdo con OpenAI, podría encargar el trabajo. Un fiscal general del estado o un tribunal podrían autorizar a un tercero, como otra organización benéfica, a presentar un reclamo para proteger los activos de la organización sin fines de lucro.

Además, el IRS podría intervenir.

La agencia de recaudación y aplicación de impuestos tiene la responsabilidad de garantizar que los activos en poder de una organización sin fines de lucro exenta de impuestos permanezcan dentro del sector benéfico. En este caso, eso significaría garantizar que la organización sin fines de lucro de OpenAI obtenga lo que se le debe.

Como inconveniente adicional, el empresario multimillonario Elon Musk ya intervino como ex miembro de la junta directiva. Presentó una demanda en febrero de 2024 para proteger los compromisos caritativos de OpenAI, la retiró y la volvió a presentar. Ahora, ha metido a Microsoft en la pelea, argumentando que la asociación de Microsoft con OpenAI está permitiendo a las dos compañías eludir las leyes antimonopolio.

Estamos seguros de que si OpenAI se embarca en un viaje hacia el estado con fines de lucro, ese camino será largo y lleno de obstáculos. Al determinar el valor de los activos de OpenAI y quién es su propietario, los reguladores estatales y la junta directiva de la organización sin fines de lucro están facultados para proteger completamente a la organización sin fines de lucro, no al director ejecutivo de OpenAI, a sus empleados, a la propia empresa con fines de lucro ni a ningún inversor.