El 30 de abril de 2024, ocho de los diarios más importantes del país, incluido el New York Timespresentó una demanda contra OpenAI y Microsoft, alegando que ambas empresas utilizaron artículos de noticias sin permiso para entrenar sus modelos de IA.

Es uno de los casos más importantes iniciados contra desarrolladores de IA hasta la fecha y sigue a una demanda separada y en curso presentada el 27 de diciembre de 2023, en la que el New York Times Afirmó que OpenAI cometió una infracción de derechos de autor a través de ChatGPT.

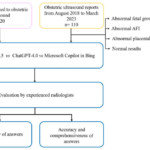

Cuando le pregunté a ChatGPT sobre estos casos, obedientemente me dio un resumen del caso de 2023, que incluía tres puntos principales: infracción de derechos de autor, falta de compensación por el uso de contenido protegido por derechos de autor y la naturaleza continua del caso.

Irónicamente, al explicarme este caso, ChatGPT puede haberse alejado de New York Times artículos, destacando el tema exacto en cuestión o, al menos, el tema que trata el periódico.

¿Pero es este caso tan blanco y negro como Los tiempos‘ propia cabecera? Dado que su resultado podría determinar cómo las empresas manejan la capacitación de modelos futuros durante potencialmente las próximas décadas, vale la pena echarle un vistazo más de cerca.

Un asunto urgente: el caso para The New York Times

Al momento de escribir este artículo, OpenAI es solo una de varias empresas de IA que enfrentan docenas de demandas. Estos casos a menudo se centran en alguna forma de infracción de derechos de autor, y los demandantes van desde creadores individuales de YouTube hasta conglomerados de medios y estudios de música.

Cuando escuchamos sobre denuncias de infracción de derechos de autor por parte de AI, lo primero que nos viene a la mente es músicos, actores y escritores. Hollywood ha estado en el centro de las tensiones con la industria de la IA desde hace años, pero la prensa y los medios de comunicación también desempeñan un papel importante en la batalla contra el uso indebido de la IA.

Casos como el 2023 y 2024 New York Times Las demandas no tratan sólo de proteger a los periodistas de perder sus trabajos a causa de la IA. A diferencia de los casos relacionados con la IA en Hollywood, estos casos se centran más en la explotación de artículos de noticias por parte de chatbots de IA y los riesgos de que esos chatbots difundan información errónea bajo la apariencia de fuentes de noticias legítimas.

La posibilidad de que la IA generativa fabrique noticias tampoco es hipotética. Ya está sucediendo. Por ejemplo, en 2023, el guardián bloqueó a ChatGPT para que no raspara su sitio web en busca de datos de entrenamiento después de que los lectores informaron que el chatbot estaba generando artículos de noticias en Guardián firmas de reporteros… que esos reporteros nunca escribieron.

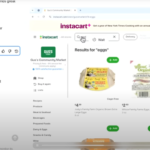

Del mismo modo, el 2024 New York Times La demanda contra AI citó múltiples ejemplos de ChatGPT generando recomendaciones de productos falsas atribuidas a medios de comunicación.

Esta información completamente fabricada no es sólo un error incómodo de la IA. Puede causar graves daños a los lectores que creen que están obteniendo información de una fuente confiable. Como afirman las demandas, esto también puede dañar la reputación de los periódicos si los lectores desprevenidos no se dan cuenta de que están recibiendo una recomendación o una historia completamente inventada.

Para complicar aún más las cosas, estas demandas también plantean la cuestión de la pérdida de ingresos. No es ningún secreto que los periódicos dependen de suscripciones pagas para mantenerse en el negocio. Los modelos de IA pueden brindar a los lectores acceso al texto de artículos de noticias con derechos de autor sin pagar por el acceso a ese contenido. Entonces, el New York Times y los otros medios de comunicación que se unieron a él en la demanda de 2024 afirman que se les debe una compensación por el uso de su contenido por parte de OpenAI.

Todo esto equivale a una cuestión de responsabilidad. ¿Pueden las empresas de IA sacar provecho de contenido que no estaban autorizadas a utilizar? ¿Son responsables del daño causado cuando sus algoritmos generan contenido falso o engañoso?

Mirar

Generando titulares: el caso de OpenAI

Los tiempos‘ El argumento es bastante sólido, pero como ocurre con cualquier demanda, hay dos lados en cada historia.

En respuesta a la presentación de la demanda, OpenAI acusaría Los tiempos de informes incompletos en una publicación titulada OpenAI y periodismo publicado en su sitio web en enero de 2024, que decía: “Apoyamos el periodismo, nos asociamos con organizaciones de noticias y creemos en el New York Times La demanda no tiene mérito.”

Sobre el tema de las obras con derechos de autor que aparecen en ChatGPT, OpenAI ofreció información afirmando: “[The New York Times] había mencionado haber visto cierta regurgitación de su contenido, pero repetidamente se negó a compartir ningún ejemplo, a pesar de nuestro compromiso de investigar y solucionar cualquier problema”.

Al explorar estas “regurgitaciones”, el nombre dado a un error encontrado por los modelos de OpenAI cuando ofrecen datos de entrenamiento como parte de una respuesta, Open AI afirma: “Curiosamente, las regurgitaciones inducidas por The New York Times parecen ser de hace años”. artículos que han proliferado en múltiples sitios web de terceros.

“Parece que manipularon intencionalmente las indicaciones, que a menudo incluían largos extractos de artículos, para que nuestro modelo regurgitara”.

Desde la perspectiva de OpenAI, Los tiempos‘ Las afirmaciones son el resultado de intentos de “jailbreaking” para obligar a ChatGPT a revelar datos de entrenamiento. Como lo expresa la compañía, “este uso indebido no es una actividad típica ni permitida del usuario… continuamente hacemos que nuestros sistemas sean más resistentes a ataques adversarios para regurgitar datos de entrenamiento, y ya hemos logrado muchos avances en nuestros modelos recientes”.

Reforzando la postura de su empresa, el director ejecutivo de OpenAI, Sam Altman, comentó sobre la demanda en la reciente Dealbook Summit 2024 en diciembre, afirmando: “Creo que New York Times está en el lado equivocado de la historia en muchos sentidos”.

Mirar

Un caso que no es tan blanco o negro

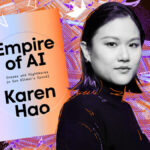

No es sólo la infracción de derechos de autor lo que está sobre la mesa en estas demandas históricas sobre IA; en casos de infracción de derechos de autor en particular, los resultados podrían remodelar completamente la forma en que se entrenan los modelos de IA en el futuro.

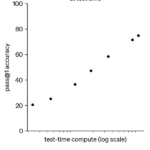

Para algunos, los LLM como ChatGPT simplemente están arrojando fragmentos de información previamente aprendida a los usuarios, extraída de los materiales de capacitación que recibieron inicialmente, lo que hace sonar las alarmas sobre cuánta de esta “nueva” información contiene el trabajo de otra persona.

Sin embargo, los desarrolladores de IA afirman que modelos como ChatGPT no funcionan de esa manera. Para ellos, incluso si un modelo está entrenado con datos protegidos por derechos de autor, no es diferente a que alguien aprenda a tocar la guitarra tocando riffs de sus bandas favoritas. Si esta persona continuara creando su propia música, no estaría violando los derechos de autor simplemente por haber aprendido a hacerlo escuchando y aprendiendo de otros que ya podían hacerlo.

Aún no se sabe qué lado del argumento prevalecerá en el tribunal, y ambas partes presentan argumentos sólidos.

Sin embargo, tal vez la excelencia de ChatGPT en la entrega de contenido tan humano sea su perdición, similar al malentendido de la cita ampliamente atribuida de Pablo Picasso (que, irónicamente, también posiblemente esté mal atribuida): “Los buenos artistas copian, los grandes artistas roban. “

Si es desde un entusiasta de la IA hasta un experto promedio en IA (o simplemente está buscando algunas de las funciones adicionales que se ofrecen a través de las PC con Windows Copilot+ o Apple Intelligence en las Mac), entonces necesitará una computadora portátil potente y de alto rendimiento para mantenerse al día. velocidad con sus necesidades.

En Revista portátilrevisamos las computadoras portátiles durante todo el año para asegurarnos de brindarle recomendaciones actualizadas y respaldadas por expertos sobre cuál es la computadora portátil adecuada para usted. Cuando se trata de mejor PC con IA En esta categoría, nuestras mejores opciones son el excelente Asus Zenbook S 14 (UX5406) para usuarios de Windows y el impresionante Apple Macbook Air M3 para quienes ejecutan macOS.

Entonces, si está comprando una computadora portátil nueva y desea invertir en una PC con IA (o simplemente en una excelente computadora portátil en general), consulte nuestras selecciones actuales de primer nivel a continuación.

La mejor Mac para IA

La mejor Mac para IA

Nos encanta el MacBook Air 13 M3. Desde solo $1,099 (MSRP), con un precio educativo que baja a $999 (MSRP), la Air es una computadora portátil que podemos recomendar para casi cualquier propósito. Es asequible, especialmente para los estándares de Apple, y cuenta con un teclado excelente, un rendimiento fantástico y una resistencia excepcional (más de 15 horas de duración de la batería), lo que la convierte en una excelente computadora portátil para las necesidades de casi cualquier persona, especialmente aquellos interesados en familiarizarse con todas las funciones más recientes de Apple Intelligence.

La mejor PC con Windows AI

La mejor PC con Windows AI

El Asus Zenbook S 14 (UX5406) se ha convertido rápidamente en nuestro portátil con IA favorito del año, y ofrece todas las características de una gran compra, incluido un rendimiento y una duración de batería excepcionales. Esta computadora portátil es una de las primeras en contar con un procesador Intel Core Ultra serie 200V y por solo $1,499 (MSRP), obtienes un fantástico equilibrio de potencia, una impresionante pantalla OLED de 14 pulgadas, multitarea sin esfuerzo y rendimiento mejorado por NPU para tareas de IA. y todas las funciones adicionales de Copilot+ disponibles con Windows 11.