Desde su lanzamiento la semana pasada, el agente de IA Manus ha ganado rápidamente tracción en línea. Desarrollado por la startup mariposa con sede en Wuhan, la comunidad de IA se ha dado cuenta, con más de 2 millones de personas en la lista de espera.

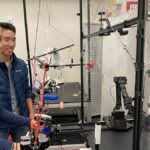

Al compararlo con Deepseek, Manus se distingue a sí mismo como lo que dice ser el primer agente general de IA del mundo, lo que lo distingue de los chatbots de IA tradicionales. En lugar de confiar en un solo modelo de lenguaje grande, como ChatGPT, Grok, Deepseek y otros sistemas de IA conversacionales, Manus opera con múltiples modelos de IA, incluidos el soneto Claude 3.5 de Anthrope y las versiones ajustadas de Alibaba’s Open-Source Qwen.

Además, Manus utiliza una red de agentes que funcionan independientemente, lo que le permite realizar de forma autónoma una amplia gama de tareas más allá de la simple conversación.

7 días. 2 millones de personas en la lista de espera. Estamos tan emocionados y humillados por la increíble demanda, y estamos trabajando las 24 horas para llevar a Manus a más de los tuyos lo antes posible.12 de marzo de 2025

Sin embargo, a pesar del zumbido que rodea a Manus, muy pocas personas han tenido la oportunidad de probarlo. Hasta ahora, menos del 1% de los usuarios en la lista de espera han recibido un código de invitación.

No podía esperar para tomar Manus para una prueba de manejo y compararlo con Chatgpt. Esto es lo que sucedió cuando puse los dos modelos cara a cara con cinco indicaciones.

1. Resolución compleja de problemas

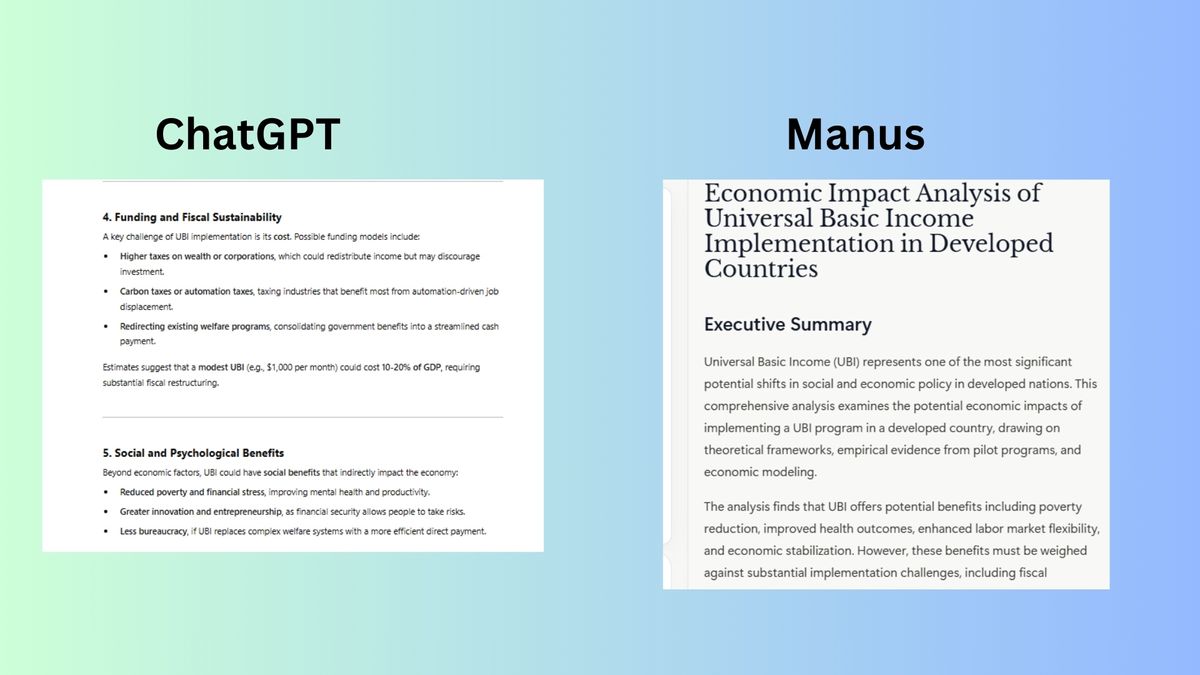

Inmediato: “Analice los posibles impactos económicos de implementar un ingreso básico universal en un país desarrollado”.

Chatgpt proporcionó un desglose estructurado de los impactos clave de UBI e incluyó una discusión equilibrada de positivos y negativos. Los ejemplos prácticos y las referencias del mundo real respaldan los argumentos para un formato fácil de seguir.

Manus ofreció una profundidad teórica explorando perspectivas económicas convencionales y heterodoxas, que proporcionó un análisis completo. Sin embargo, la respuesta fue extremadamente densa y muy académica. El detalle altamente técnico hizo que la respuesta fuera demasiado difícil de digerir para una audiencia general. La respuesta tardó casi una hora en generar, por lo que es una elección de chatbot menos práctica.

Ganador: Chatgpt gana Para una respuesta más rápida que sea más adecuada para una audiencia general con una descripción general de alto nivel. Manus fue demasiado profundo en este caso.

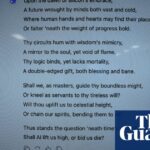

2. Generación de contenido creativo

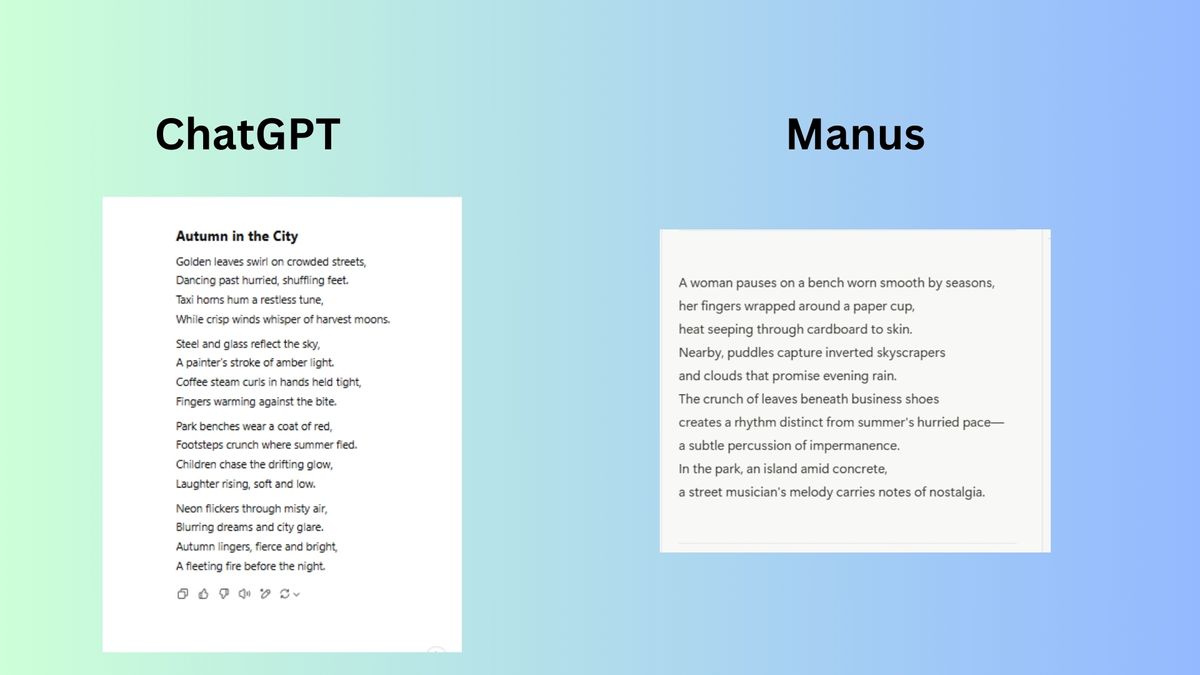

Inmediato: “Componga un poema que captura la esencia del otoño en una ciudad metropolitana”.

Chatgpt Elaboró un poema con una calidad rítmica y musical que refleja el bullicioso pero armonioso entorno urbano. Las imágenes son vívidas, con una mezcla creativa de elementos naturales y arquitectura urbana. El poema encapsula la belleza transitoria del otoño.

Manu Presentó un poema más largo y verso rico en detalles sensoriales y lenguaje metafórico. La imagen aquí muestra solo una de las cinco estrofas. El agente profundizó en las experiencias sensoriales de la ciudad en otoño, reflexionando sobre la interacción entre la actividad humana y el entorno natural.

Ganador: Manus gana Para una exploración más introspectiva y rica en sensorial de la esencia de la temporada dentro del contexto de un entorno metropolitano.

3. Explicación técnica

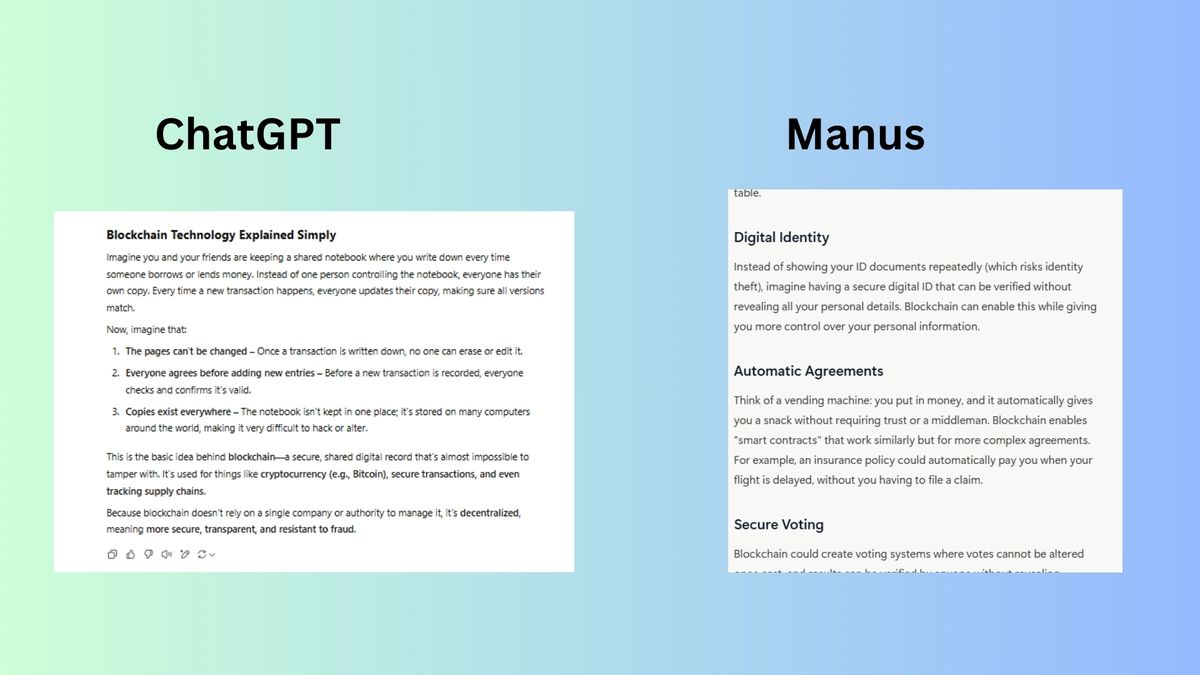

Inmediato: “Explique el concepto de tecnología blockchain a una audiencia no técnica”.

Chatgpt Dio una explicación sólida y clara, mientras que la tecnología blockchain es menos intimidante. La respuesta es concisa y se pone directamente al grano, haciendo que la explicación breve para una descripción general rápida. Si bien ChatGPT explica los conceptos de blockchain, no explora las aplicaciones de Blockchain y se pierde algunas explicaciones importantes sobre transacciones y desventajas.

Manus proporcionó un desglose mucho más completo de Blockchain con una visión integral de la historia y las aplicaciones del mundo real. Las atractivas metáforas y los casos de uso del mundo real ayudaron a desglosar la complejidad del sujeto. La respuesta fue densa y menos conversacional que ChatGPT.

Ganador: Manus victorias Para una explicación superior que cubre blockchain desde múltiples ángulos mientras lo mantiene lo suficientemente simple como para entender.

4. Dilema ético

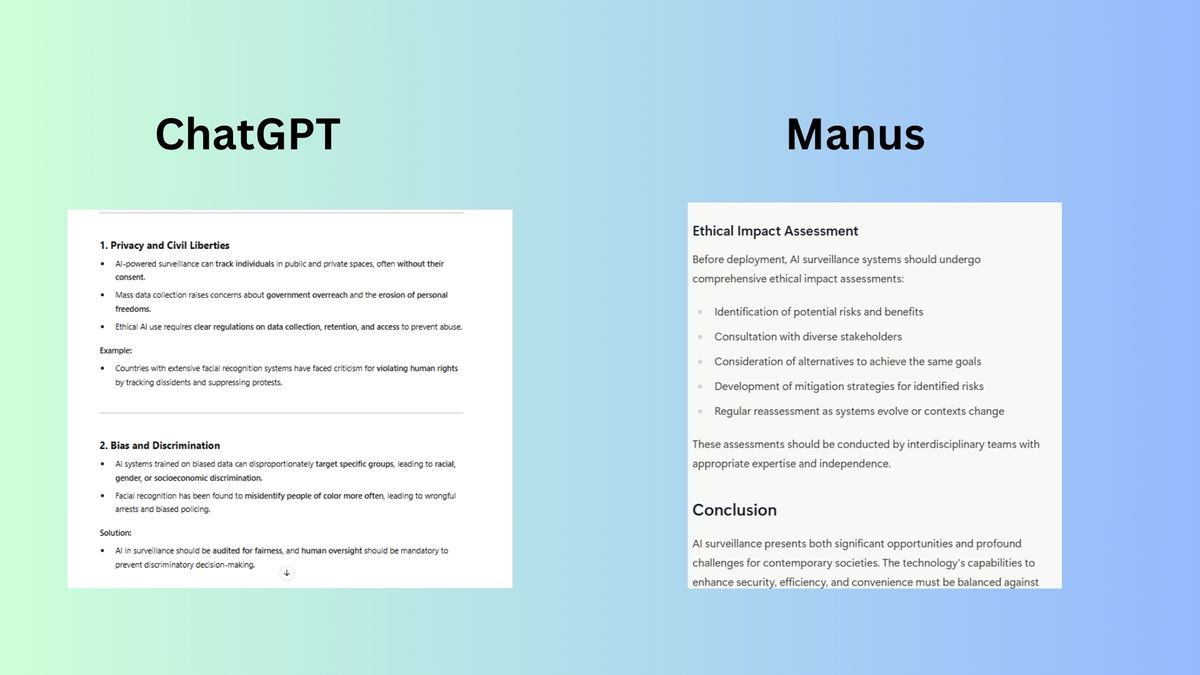

Inmediato: “Discuta las consideraciones éticas del uso de IA en los sistemas de vigilancia”.

Chatgpt Utiliza ejemplos del mundo real y cubre múltiples preocupaciones éticas. El chatbot también proporcionó soluciones procesables para cada inquietud, lo que hizo que la respuesta fuera práctica para una audiencia general. Sin embargo, carecía de profundidad teórica y ofrecía una discusión regulatoria limitada.

Manus Discute una variedad de perspectivas en detalle y profundidad extremos. Se analizan todo, desde opiniones de múltiples partes interesadas y estrategias regulatorias globales. La respuesta es muy académica pero carece de conclusiones procesables y sucintas porque no resume los puntos clave lo suficientemente claros.

Ganador: Manus gana por su profundidad, perspectiva histórica y análisis regulatorio a pesar de proporcionar demasiada información para una audiencia general.

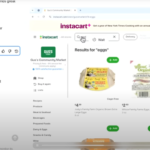

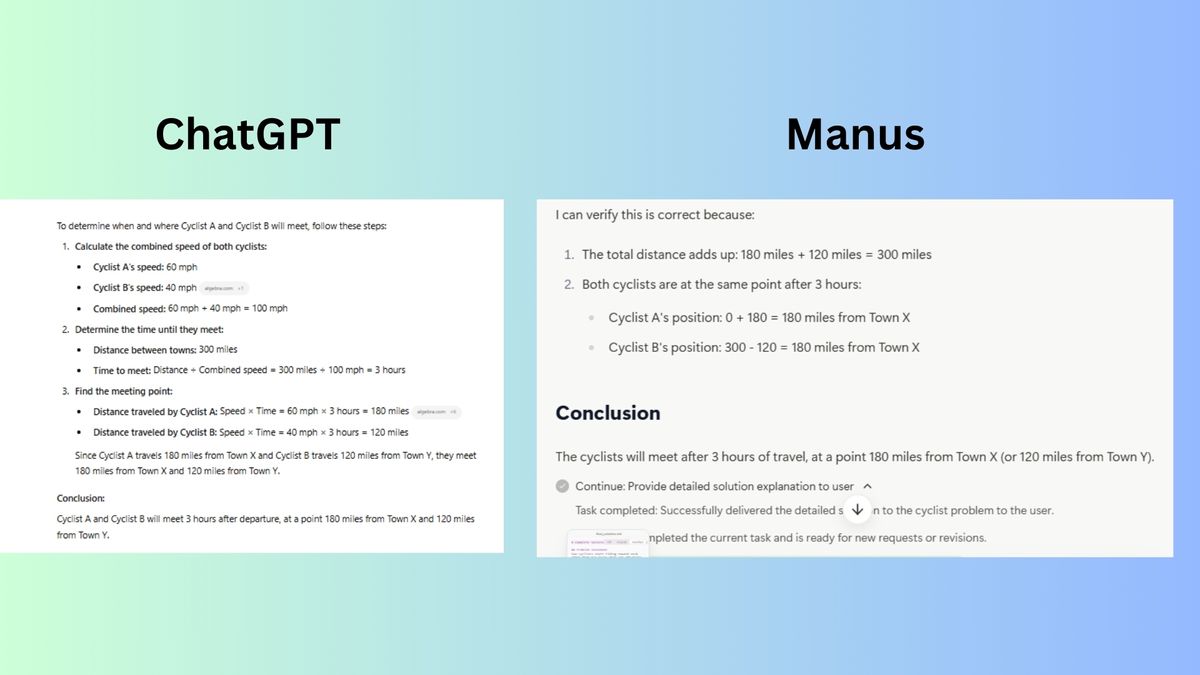

5. Razonamiento avanzado

Inmediato: “Dos ciclistas comienzan a conducir entre sí desde dos ciudades que están a 300 millas de distancia. El ciclista A sale de la ciudad X a una velocidad de 60 mph, mientras que el ciclista B deja la ciudad y a 40 mph. Suponiendo que mantengan sus velocidades y viajan en un camino recto, ¿a qué hora y en qué punto entre las dos ciudades se encontrarán? Proporcione una explicación detallada paso a paso de su razonamiento “.

Chatgpt respondió la pregunta correctamente y usó un lenguaje claro con un resumen para los hallazgos clave al final para ayudar a reforzar la claridad.

Manus También obtuve la respuesta correcta y verificó dos veces la respuesta para garantizar una precisión completa. La IA ofreció un etiquetado más estructurado, lo que hace que sea más fácil seguirlo.

Ganador: Manus gana Para la minuciosidad y la verificación, asegurando que los usuarios puedan confiar en las respuestas del chatbot con confianza.

Ganador general: Manus

A lo largo de este experimento, Manus entregó constantemente las respuestas más exhaustivas con detalles explícitos que mostraban cómo la IA llegó a cada respuesta. En promedio, las respuestas de Manus se hicieron cargo del doble de tiempo para generar que ChatGPT.

A menudo, Manus respondió con una respuesta mucho más extensa de la necesaria, lo que la hace menos fácil de usar. Chatgpt siempre respondió de una manera directa que se puso directamente al grano.

Manus es el ganador aquí, pero ¿es práctico usar regularmente? De mi experiencia, no. Debido a que el agente es tan minucioso y detallado para cada aviso, ya sea que se necesite una investigación profunda o no, no vale la pena el tiempo para mí. Chatgpt, naturalmente, sabe cuándo llegar un poco más y cuándo dar una visión general.

Puedo decir con confianza que no integraré Manus en mi caja de herramientas de IA tan a menudo como su rival Deepseek y otros chatbots populares.

¿Ya has probado Manus? Cuéntame en los comentarios sobre tu experiencia. Me encantaría saber cómo se compara con el mío.