tHace dos años, el 30 de noviembre, OpenAI puso a disposición del público su software generador de texto ChatGPT. El 1 de diciembre, millones de estudiantes en todo el mundo dejaron de hacer sus tareas. ¿Por qué pasarían horas en tareas sin sentido cuando podrían pedirle al chatbot altamente sofisticado que lo hiciera por ellos?

Me di cuenta del hecho de que mis alumnos estaban usando IA desde el principio. Creé una cuenta OpenAI y comencé a incluir las indicaciones de mis ensayos para ver qué podía hacer. Lo miré con diversión y horror: escupió ensayos de nivel C en segundos.

La llegada de ChatGPT creó una crisis en la educación. En el juego del gato y el ratón de la escuela moderna, los ratones obtuvieron una enorme ventaja. Los viejos detectores de plagio, tan expertos en señalar trabajos de copiar y pegar, no reconocerían el texto infinitamente variable generado por IA. La crisis se volvió existencial; el atlántico Incluso argumentó que ChatGPT auguraba “el fin del inglés en la escuela secundaria”.

Mientras tanto, muchas escuelas y universidades intentaron hacer una tregua con la nueva tecnología. Actualmente, la Universidad de Harvard aconseja a los estudiantes de secundaria en su programa de verano que pueden utilizar la IA para “proponer ideas para ensayos”. Por ejemplo, ingrese indicaciones específicas, como: “Por favor, dame cinco ideas para ensayos que pueda escribir sobre temas relacionados con la Segunda Guerra Mundial”. . . . Luego, utilice lo que proporciona como punto de partida para su investigación original”.

Una vez que se genera una idea, los estudiantes pueden “usar ChatGPT para ayudar [them] crear un esquema para un ensayo. Pregúntele: ‘¿Puede crear un esquema para un ensayo de cinco párrafos basado en el siguiente tema?’ y creará un esquema con una introducción, párrafos principales, una conclusión y una declaración de tesis sugerida”. Pero, afirma Harvard, aquí es donde debe detenerse el uso de la IA. Con la idea generada por IA y el esquema en mano, los estudiantes deben “ampliar el esquema con su propia investigación y pensamiento original”.

Pero, ¿por qué el uso de la IA debería limitarse a crear la idea y el esquema? En un revoltijo de contradicciones, Harvard les dice a sus estudiantes que “escribir un ensayo usted mismo significa que está desarrollando sus propios pensamientos, opiniones y preguntas sobre el tema, y luego prueba, prueba y defiende esos pensamientos”. Sin embargo, si la IA generó sus ideas y sus esquemas, los estudiantes se encontrarán “probando, demostrando y defendiendo” los “pensamientos” de un robot. ¿Y por qué alguien debería interesarse en “probar, probar o defender” cualquier pensamiento, pensamiento humano genuino o la apariencia de pensamiento generada por IA? Porque “construir una base de pensamiento e ideas originales ahora le ayudará a forjar su trayectoria profesional única en el futuro”. Y una dependencia excesiva de la IA perjudicará la capacidad de los estudiantes para desarrollar “habilidades de pensamiento crítico”, que “no sólo son necesarias en la escuela: son habilidades que aplicarás a lo largo de tu carrera y de tu vida”. En última instancia, según Harvard, el mejor argumento contra el uso de la IA para escribir un ensayo completo se basa en preservar la capacidad de los estudiantes para forjar una carrera en nuestra economía tecnocrática que, sin embargo, se está volviendo cada vez más dependiente de la aplicación de la IA.

Tanto la histeria del “fin del inglés” como los ridículos argumentos representados por Harvard sobre cómo y cómo no utilizar la IA malinterpretan la naturaleza de la educación. Presuponen que el propósito de la educación reside en lo que un estudiante puede producir. En este marco materialista, la calidad de la educación se juzga por la calidad de lo que se produce. Si esto fuera cierto, la IA plantearía una grave amenaza a la noción misma de educación. Porque si una máquina puede producir las mismas cosas que yo, y el propósito de mi educación es aumentar mi capacidad para producir cosas, ¿por qué molestarse en educarme?

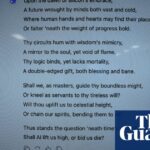

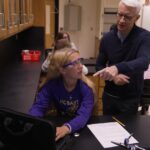

Una educación no debería tener nada que ver con negociar nuestra parte de trabajo con robots, por muy necesaria que sea la tarea en el mundo del trabajo. Sin embargo, la educación no es trabajo; es una búsqueda espiritual. Su objetivo es cultivar y nutrir nuestra vida interior. Como esfuerzo exclusivamente humano, debería refinar nuestras capacidades para pensar racionalmente, contemplar la realidad, apreciar la belleza y sentir gratitud. Para cultivar verdaderamente estas capacidades, las escuelas deben salvaguardar y fomentar lo que Josef Pieper llama “ocio”.

en su obra maestra Ocio: la base de la culturaPieper explica que el ocio no es pereza o mero descanso, sino “una condición del alma. . . una forma de esa quietud que es la preparación necesaria para aceptar la realidad”, no sólo para recibir la realidad sino para hacerlo con un “espíritu de celebración”. El hombre en su tiempo libre “sigue siendo capaz de asimilar el mundo como un todo y, por tanto, de realizarse como un ser orientado hacia la totalidad de la existencia”. Alcanzar esta condición del alma requiere un verdadero conocimiento: conocimiento de uno mismo en relación con el cosmos. Este conocimiento es verdaderamente “libre” porque es bueno en sí mismo, lo más elevado y noble que uno puede conocer y no puede subordinarse a ningún otro fin. Es fruto de las artes “liberales”.

Fomentar esta condición del alma es la única preocupación de la educación. Pieper nos recuerda, después de todo, que “La palabra griega para ocio… . . es el origen del latín escuela”, de donde derivamos nuestra palabra “escuela”.

Las escuelas deberían dejar de funcionar como burocracias de control de productos, donde los estudiantes son sometidos a “estrategias de enseñanza efectivas” diseñadas para extraer “evidencias de aprendizaje” que “cumplen o superan” los “estándares” académicos. Al operar según este paradigma de “aprendizaje basado en estándares”, las escuelas anteponen el carro al caballo. Es una metafísica desordenada donde la materia determina la forma y el hacer precede al ser. En realidad, la forma determina la materia y el ser precede al hacer.

La vida interior es de naturaleza cualitativa; sin embargo, las escuelas se ocupan exclusivamente de lo cuantitativo. Este error de categoría explica la repulsión intuitiva que sienten la mayoría de los profesores al emitir calificaciones y administrar pruebas estandarizadas. La burocracia exige números, y por eso les sacamos números a nuestros estudiantes para apaciguarla.

Dado que los números arbitrarios utilizados para cuantificar el trabajo de un estudiante se tratan con tanta importancia, también son destructivos. Las escuelas están predisponiendo a sus estudiantes a convertirse en lo que Pieper llama “proletarios”, cuya vida interior ha sido tan empobrecida que “una acción significativa que no sea trabajo ya no es posible o siquiera imaginable”. Así, las escuelas modernas equiparan el “ocio” con no hacer nada, y cultivarlo significaría abandonar a los estudiantes al analfabetismo tecnológico y al desempleo.

Muchas almas atrapadas en este mundo de “trabajo total” mantienen una vaga sensación de que algo anda mal y se rebelan contra ello de diversas maneras. Pero los proletarios aceptan la racionalización de que la vida no puede ser de otra manera. Aceptan el trabajo total incluso cuando éste los mata. Las escuelas los han habituado a una vida de servidumbre mientras sus “partituras” fabricadas se utilizan para justificar la expansión del complejo industrial educativo.

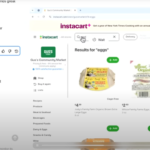

Sin una vida interior rica, los proletarios llenan el vacío de su mente con entretenimiento rápido, barato y accesible. Habiendo sido esclavos de Big Ed, se convierten en esclavos voluntariosos de Big Tech, cuyos algoritmos están diseñados para la adicción. Una vez adictos, se convierten en consumidores pasivos de cualquier producto u opinión que les venda el algoritmo.

Atribuir enteramente la desaparición de la vida interior a las escuelas sería engañoso. La guerra contra la vida interior tiene un alcance civilizacional. Georges Bernanos nos enseñó incluso en 1947 en su tratado no traducido La Francia contra los robots (Francia contra los robots) que “la civilización moderna. . . Es una conspiración que lo abarca todo contra toda forma de vida interior”.

Las escuelas son actores clave en esta gran conspiración, por lo que no debería sorprender que en los próximos años hagan más y más concesiones a la IA. Habiendo abandonado cualquier noción de ocio y vida interior, sólo queda un camino lógico: enseñar a los estudiantes a utilizar más tecnología para hacer más y producir más.

Las verdaderas escuelas de la era moderna deben rebelarse contra la conspiración. Deben convertirse en lugares de ocio, humanizando a sus estudiantes en nuestra cultura deshumanizadora.

SA Dance es profesora y escritora en el norte de California.

Primeras cosas depende de sus suscriptores y seguidores. Únase a la conversación y haga una contribución hoy.

Haga clic aquí para hacer una donación.

haga clic aquí suscribirse a Primeras cosas.

Imagen por John Singer Sargenta través del dominio público. Imagen recortada.