Noticias

OpenAI se enfrenta a una multa de 15 millones de euros mientras la garantía italiana ataca de nuevo – Nueva tecnología

Published

1 año agoon

Resumen

Una vez más, OpenAI se encuentra bajo un intenso escrutinio por parte de la autoridad italiana de protección de datos, Garante Per La Protezione Dei Dati Personali (Garantia), después de que su investigación revelara varias violaciones de protección de datos en relación con su gestión de la herramienta de inteligencia artificial insignia de la compañía, ChatGPT. Las violaciones incluyeron el entrenamiento de ChatGPT “sin tener una base legal adecuada“y no cumplir con”obligaciones de información hacia los usuarios“. Además de imponer una multa de 15 millones de euros, OpenAI también tendrá que llevar a cabo una campaña de información durante un período de seis meses en las plataformas de medios italianas. Esta decisión es una de las acciones más importantes tomadas contra la potencia tecnológica y subraya la creciente demanda de Responsabilidad y transparencia con el procesamiento de datos en inteligencia artificial (AI) sistemas.

Los orígenes de la investigación.

La investigación de Garante sobre OpenAI comenzó en marzo de 2023, con un enfoque particular en ChatGPT, en medio de crecientes preocupaciones sobre su recopilación y procesamiento de datos personales. La investigación se intensificó rápidamente y Garante tomó una medida sin precedentes al imponer una “limitación temporal inmediata” sobre el uso de ChatGPT, citando varias violaciones de privacidad, incluidas:

- “recopilación y almacenamiento masivo de datos personales con el fin de “entrenar” los algoritmos“;

- falta de informe “un error en una biblioteca de código abierto“exponer el historial de conversaciones de los usuarios; y

- falta de mecanismos apropiados de verificación de la edad exponiendo a los menores a “respuestas absolutamente inadecuadas en comparación con su grado de desarrollo y conciencia“.

Sin embargo, la restricción duró poco. En menos de un mes, se levantó la prohibición y se restableció el uso de ChatGPT después de que OpenAI aceptara tomar medidas correctivas para cumplir con las obligaciones de protección de datos. Estos incluyeron:

- aclarando la explicación de “las actividades de recolección y procesamiento“de datos de usuario”con fines de entrenamiento de algoritmos, la forma de procesamiento, la lógica detrás del procesamiento necesario para el funcionamiento del servicio, los derechos de los interesados y cualquier otra información requerida…“;

- cambiando la base legal para el tratamiento de los datos personales de los usuarios a “consentimiento o interés legítimo” para cumplir con el “principio de responsabilidad“; y

- introducir mecanismos de verificación de edad para excluir el acceso al servicio a usuarios menores de 13 años.

Revelando violaciones de privacidad en curso

A pesar de los esfuerzos de OpenAI para abordar las preocupaciones iniciales sobre privacidad, Garante continuó con una revisión de amplio alcance de ChatGPT que concluyó con su decisión el 20 de diciembre de 2024. A partir de su investigación, Garante observó numerosas violaciones de protección de datos, entre ellas:

- la ausencia de un “base legal apropiada“para procesar datos personales utilizados para entrenar ChatGPT;

- incumplimiento de las obligaciones de transparencia, tal y como exige el Reglamento (UE) 2016/679 (Reglamento general de protección de datos (RGPD)), a sus usuarios; y

- falta de medidas suficientes de verificación de la edad para proteger a los menores.

Según Garante, OpenAI había procesado datos de usuarios “entrenar ChatGPT sin identificar primero una base legal adecuada“, violando directamente el principio de transparencia del RGPD y su obligación de informar a los usuarios. Específicamente, determinaron que el procesamiento de datos personales se había producido antes del lanzamiento público de ChatGPT el 30 de noviembre de 2022. En su opinión, “al menos en esa fecha“Si no antes, OpenAI tenía la obligación de haber identificado una base legal, cuya ausencia significaba que había una violación ya que no había base legal “antes del inicio del procesamiento“.

Pero eso no es todo. La Garante también rechazó los intentos de OpenAI de defender sus acciones basándose en la evaluación de impacto de la protección de datos (EIPD) y evaluación del interés legítimo (LIA), ninguno de los cuales logró convencer a las autoridades. Según Garante, la DPIA y la LIA, presentadas el 19 de mayo y el 20 de noviembre de 2023 respectivamente, no eran “decisivo” al establecer que existía una base legal para el procesamiento antes del lanzamiento del servicio, haciéndolo “imposible“para los interesados”para ejercer sus derechos” violando directamente el “principio de responsabilidad“. En particular:

- la DPIA, que señaló “intereses legítimos“como base para el procesamiento, no se ha acreditado que se haya realizado una evaluación de adecuación pertinente antes del 30 de noviembre de 2022; y

- se produjo el LIA “sólo por petición expresa” del Garante y no proporcionó pruebas de que “la identificación de una de las bases jurídicas tuvo lugar antes del 30 de marzo de 2023“.

El fallo de Garante subrayó una cuestión fundamental: OpenAI había carecido de las salvaguardias legales necesarias desde el principio. Al tomar su decisión, Garante también citó el reciente dictamen del Consejo Europeo de Protección de Datos, emitido apenas unos días antes, sobre el uso legal de datos personales para el “diseño, desarrollo y despliegue” de los sistemas de IA.

La investigación también descubrió que OpenAI no había cumplido con el requisito de implementar mecanismos de verificación de edad, cuya ausencia colocaba a los menores de 13 años en riesgo de estar expuestos a contenido inapropiado generado por IA.

Para aumentar el peso de su decisión final, Garante también culpó a OpenAI por no informar a Garante, como exige el artículo 33 del RGPD, de una infracción que experimentó el 20 de marzo de 2023. La infracción, provocada por un error de seguridad interno en lugar de que un ataque externo, expuso datos personales, específicamente historiales de chat e información de pago de los suscriptores de ChatGPT Plus que estuvieron activos durante “una ventana específica de nueve horas“. Este fallo de seguridad comprometió la confidencialidad de los interesados. La Garante señaló que OpenAI debería haber notificado “todas las autoridades europeas de protección de datos cuyos interesados hayan estado involucrados en la violación de datos. Dado que los documentos de la investigación mostraron que el evento afectó a 440 usuarios italianos, OpenAI debería haber notificado la violación de datos directamente a la Autoridad.“. No hacerlo socavó aún más la confianza en el compromiso de la empresa con sus obligaciones de transparencia.

Imposición de medidas correctoras y sanciones económicas

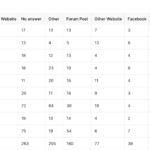

OpenAI se ha enfrentado a una fuerte sanción después de que la serie de acciones equivalieran colectivamente a varias violaciones de la protección de datos. La Garante no se ha quedado atrás, imponiendo una multa de 15 millones de euros equivalentes a aproximadamente el 1,58% del “Volumen de negocios anual total a nivel mundial para el ejercicio 2023“. El monto total se determinó con base en las siguientes proporciones:

- 9.000.000 € por infracciones relacionadas con el tratamiento ilícito de datos personales;

- 320.000 € por no informar al Garante de una violación de datos personales; y

- 5.680.000,00 € por el incumplimiento de las medidas correctoras impuestas por la Garantía en 2023.

Al determinar la multa, Garante concluyó que el cálculo representa un “eficaz, proporcionada y disuasoria” sanción. Este enfoque no solo refleja la gravedad de las violaciones, sino que también envía un recordatorio crucial a las organizaciones para que prioricen los derechos de privacidad dentro de sus sistemas de inteligencia artificial.

Garante también invocó la autoridad que le otorga el artículo 166, párrafo 7 del Código de Privacidad, instruyendo a OpenAI a realizar un período de seis meses “campaña de comunicación institucional” en todos los medios de comunicación, incluidas cadenas de televisión, estaciones de radio y periódicos. El objetivo de la campaña es “promover la comprensión y la conciencia pública sobre el funcionamiento de ChatGPT“, particularmente con el “recopilación de datos de usuarios y no usuarios“con el fin de entrenar sistemas de IA y delinear derechos”ejercitable por los interesados“incluido el derecho a oponerse, rectificar y eliminar sus datos personales.

Esta doble acción de sanción financiera y educación pública sirve como un claro recordatorio del creciente enfoque regulatorio en el desarrollo y despliegue legal de sistemas de IA.

La respuesta de OpenAI: retroceso y cooperación

Como era de esperar, OpenAI ha expresado su intención de apelar la sentencia de Garante, calificándola de “desproporcionado“. En una declaración pública, la compañía enfatizó sus esfuerzos de colaboración con los reguladores de privacidad, particularmente después de la prohibición temporal de 2023 – “cuando Garante nos ordenó dejar de ofrecer ChatGPT en Italia en 2023, trabajamos con ellos para restablecerlo un mes después… desde entonces han reconocido nuestro enfoque líder en la industria para proteger la privacidad en la IA, sin embargo, esta multa es casi 20 veces mayor. los ingresos que obtuvimos en Italia durante el período relevante“.

A pesar de esto, OpenAI ha reafirmado su compromiso de trabajar con las autoridades de privacidad para garantizar que ofrecen “IA beneficiosa que respeta los derechos de privacidad“.

Una perspectiva más amplia sobre la responsabilidad de la IA

La decisión de Garante marca un paso significativo en la regulación de la IA, mostrando un enfoque asertivo para hacer cumplir las disposiciones del GDPR, que incluyen especificar la base legal para el procesamiento, promover la privacidad del usuario, desarrollar prácticas transparentes para garantizar la responsabilidad y salvaguardar los derechos de los interesados. También envía un mensaje claro a la comunidad mundial de IA:

eso es – el cumplimiento de las leyes de protección de datos no es negociable.

Por lo tanto, los desarrolladores de IA deben asegurarse de incorporar principios de privacidad desde el diseño en el núcleo de los sistemas de IA para respaldar el desarrollo y la implementación responsable de modelos de IA. Se anima a las empresas a:

- Garantice el cumplimiento del RGPD: Implementar o desarrollar sistemas de IA que cumplan con lo establecido en el RGPD.

- Adopte un enfoque de privacidad primero: Proteja los datos personales de forma predeterminada incorporando un enfoque de privacidad desde el diseño dentro de los sistemas de inteligencia artificial.

- Establecer una base legal: Evaluar, definir y documentar cuidadosamente la base legal para el procesamiento de datos personales. Recuerde que la base legal debe establecerse antes del procesamiento y no puede aplicarse retroactivamente.

- Transparencia y rendición de cuentas: Actualizar las políticas de privacidad con información detallada y transparente sobre el uso de datos personales dentro de los sistemas de IA. Proporcionar a los usuarios orientación y mecanismos claros sobre cómo ejercer sus derechos, incluida la oposición al procesamiento de datos con fines de capacitación y la solicitud de eliminación de datos. La transparencia genera confianza.

- EIPD: Completar una EIPD antes de la implementación del sistema de IA y en cada etapa del ciclo de vida de la IA. Sea proactivo, no reactivo, cuando se trata de riesgos de privacidad.

- Revisar y actualizar: Revisar las prácticas organizativas y actualizar la documentación técnica para garantizar el cumplimiento de las prácticas de protección de datos y los estándares en evolución. Esto no solo cumplirá con los requisitos mínimos, sino que también incorporará activamente una estrategia de protección de datos en los sistemas de inteligencia artificial.

Una llamada de atención global

La multa contra OpenAI no es sólo una sanción, sino que puede ser el comienzo de una nueva era de responsabilidad en el mundo de la IA. Lo que está claro es que debe existir una base legal antes del procesamiento, ya que los sistemas de inteligencia artificial no deben ir en detrimento de la privacidad del usuario.

A medida que la IA se integre cada vez más en la vida diaria, los reguladores deberán colaborar para lograr un equilibrio entre la innovación y la protección de los derechos fundamentales. Los desafíos de OpenAI en Italia probablemente sean solo el comienzo, a medida que se intensifica la conversación global sobre una IA responsable.

El contenido de este artículo pretende proporcionar una guía general sobre el tema. Se debe buscar asesoramiento especializado sobre sus circunstancias específicas.

You may like

Noticias

Revivir el compromiso en el aula de español: un desafío musical con chatgpt – enfoque de la facultad

Published

10 meses agoon

6 junio, 2025

A mitad del semestre, no es raro notar un cambio en los niveles de energía de sus alumnos (Baghurst y Kelley, 2013; Kumari et al., 2021). El entusiasmo inicial por aprender un idioma extranjero puede disminuir a medida que otros cursos con tareas exigentes compitan por su atención. Algunos estudiantes priorizan las materias que perciben como más directamente vinculadas a su especialidad o carrera, mientras que otros simplemente sienten el peso del agotamiento de mediados de semestre. En la primavera, los largos meses de invierno pueden aumentar esta fatiga, lo que hace que sea aún más difícil mantener a los estudiantes comprometidos (Rohan y Sigmon, 2000).

Este es el momento en que un instructor de idiomas debe pivotar, cambiando la dinámica del aula para reavivar la curiosidad y la motivación. Aunque los instructores se esfuerzan por incorporar actividades que se adapten a los cinco estilos de aprendizaje preferidos (Felder y Henriques, 1995)-Visual (aprendizaje a través de imágenes y comprensión espacial), auditivo (aprendizaje a través de la escucha y discusión), lectura/escritura (aprendizaje a través de interacción basada en texto), Kinesthetic (aprendizaje a través de movimiento y actividades prácticas) y multimodal (una combinación de múltiples estilos)-its is beneficiales). Estructurado y, después de un tiempo, clases predecibles con actividades que rompen el molde. La introducción de algo inesperado y diferente de la dinámica del aula establecida puede revitalizar a los estudiantes, fomentar la creatividad y mejorar su entusiasmo por el aprendizaje.

La música, en particular, ha sido durante mucho tiempo un aliado de instructores que enseñan un segundo idioma (L2), un idioma aprendido después de la lengua nativa, especialmente desde que el campo hizo la transición hacia un enfoque más comunicativo. Arraigado en la interacción y la aplicación del mundo real, el enfoque comunicativo prioriza el compromiso significativo sobre la memorización de memoria, ayudando a los estudiantes a desarrollar fluidez de formas naturales e inmersivas. La investigación ha destacado constantemente los beneficios de la música en la adquisición de L2, desde mejorar la pronunciación y las habilidades de escucha hasta mejorar la retención de vocabulario y la comprensión cultural (DeGrave, 2019; Kumar et al. 2022; Nuessel y Marshall, 2008; Vidal y Nordgren, 2024).

Sobre la base de esta tradición, la actividad que compartiremos aquí no solo incorpora música sino que también integra inteligencia artificial, agregando una nueva capa de compromiso y pensamiento crítico. Al usar la IA como herramienta en el proceso de aprendizaje, los estudiantes no solo se familiarizan con sus capacidades, sino que también desarrollan la capacidad de evaluar críticamente el contenido que genera. Este enfoque los alienta a reflexionar sobre el lenguaje, el significado y la interpretación mientras participan en el análisis de texto, la escritura creativa, la oratoria y la gamificación, todo dentro de un marco interactivo y culturalmente rico.

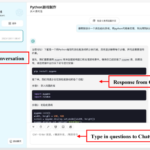

Descripción de la actividad: Desafío musical con Chatgpt: “Canta y descubre”

Objetivo:

Los estudiantes mejorarán su comprensión auditiva y su producción escrita en español analizando y recreando letras de canciones con la ayuda de ChatGPT. Si bien las instrucciones se presentan aquí en inglés, la actividad debe realizarse en el idioma de destino, ya sea que se enseñe el español u otro idioma.

Instrucciones:

1. Escuche y decodifique

- Divida la clase en grupos de 2-3 estudiantes.

- Elija una canción en español (por ejemplo, La Llorona por chavela vargas, Oye CÓMO VA por Tito Puente, Vivir mi Vida por Marc Anthony).

- Proporcione a cada grupo una versión incompleta de la letra con palabras faltantes.

- Los estudiantes escuchan la canción y completan los espacios en blanco.

2. Interpretar y discutir

- Dentro de sus grupos, los estudiantes analizan el significado de la canción.

- Discuten lo que creen que transmiten las letras, incluidas las emociones, los temas y cualquier referencia cultural que reconocan.

- Cada grupo comparte su interpretación con la clase.

- ¿Qué crees que la canción está tratando de comunicarse?

- ¿Qué emociones o sentimientos evocan las letras para ti?

- ¿Puedes identificar alguna referencia cultural en la canción? ¿Cómo dan forma a su significado?

- ¿Cómo influye la música (melodía, ritmo, etc.) en su interpretación de la letra?

- Cada grupo comparte su interpretación con la clase.

3. Comparar con chatgpt

- Después de formar su propio análisis, los estudiantes preguntan a Chatgpt:

- ¿Qué crees que la canción está tratando de comunicarse?

- ¿Qué emociones o sentimientos evocan las letras para ti?

- Comparan la interpretación de ChatGPT con sus propias ideas y discuten similitudes o diferencias.

4. Crea tu propio verso

- Cada grupo escribe un nuevo verso que coincide con el estilo y el ritmo de la canción.

- Pueden pedirle ayuda a ChatGPT: “Ayúdanos a escribir un nuevo verso para esta canción con el mismo estilo”.

5. Realizar y cantar

- Cada grupo presenta su nuevo verso a la clase.

- Si se sienten cómodos, pueden cantarlo usando la melodía original.

- Es beneficioso que el profesor tenga una versión de karaoke (instrumental) de la canción disponible para que las letras de los estudiantes se puedan escuchar claramente.

- Mostrar las nuevas letras en un monitor o proyector permite que otros estudiantes sigan y canten juntos, mejorando la experiencia colectiva.

6. Elección – El Grammy va a

Los estudiantes votan por diferentes categorías, incluyendo:

- Mejor adaptación

- Mejor reflexión

- Mejor rendimiento

- Mejor actitud

- Mejor colaboración

7. Reflexión final

- ¿Cuál fue la parte más desafiante de comprender la letra?

- ¿Cómo ayudó ChatGPT a interpretar la canción?

- ¿Qué nuevas palabras o expresiones aprendiste?

Pensamientos finales: música, IA y pensamiento crítico

Un desafío musical con Chatgpt: “Canta y descubre” (Desafío Musical Con Chatgpt: “Cantar y Descubrir”) es una actividad que he encontrado que es especialmente efectiva en mis cursos intermedios y avanzados. Lo uso cuando los estudiantes se sienten abrumados o distraídos, a menudo alrededor de los exámenes parciales, como una forma de ayudarlos a relajarse y reconectarse con el material. Sirve como un descanso refrescante, lo que permite a los estudiantes alejarse del estrés de las tareas y reenfocarse de una manera divertida e interactiva. Al incorporar música, creatividad y tecnología, mantenemos a los estudiantes presentes en la clase, incluso cuando todo lo demás parece exigir su atención.

Más allá de ofrecer una pausa bien merecida, esta actividad provoca discusiones atractivas sobre la interpretación del lenguaje, el contexto cultural y el papel de la IA en la educación. A medida que los estudiantes comparan sus propias interpretaciones de las letras de las canciones con las generadas por ChatGPT, comienzan a reconocer tanto el valor como las limitaciones de la IA. Estas ideas fomentan el pensamiento crítico, ayudándoles a desarrollar un enfoque más maduro de la tecnología y su impacto en su aprendizaje.

Agregar el elemento de karaoke mejora aún más la experiencia, dando a los estudiantes la oportunidad de realizar sus nuevos versos y divertirse mientras practica sus habilidades lingüísticas. Mostrar la letra en una pantalla hace que la actividad sea más inclusiva, lo que permite a todos seguirlo. Para hacerlo aún más agradable, seleccionando canciones que resuenen con los gustos de los estudiantes, ya sea un clásico como La Llorona O un éxito contemporáneo de artistas como Bad Bunny, Selena, Daddy Yankee o Karol G, hace que la actividad se sienta más personal y atractiva.

Esta actividad no se limita solo al aula. Es una gran adición a los clubes españoles o eventos especiales, donde los estudiantes pueden unirse a un amor compartido por la música mientras practican sus habilidades lingüísticas. Después de todo, ¿quién no disfruta de una buena parodia de su canción favorita?

Mezclar el aprendizaje de idiomas con música y tecnología, Desafío Musical Con Chatgpt Crea un entorno dinámico e interactivo que revitaliza a los estudiantes y profundiza su conexión con el lenguaje y el papel evolutivo de la IA. Convierte los momentos de agotamiento en oportunidades de creatividad, exploración cultural y entusiasmo renovado por el aprendizaje.

Angela Rodríguez Mooney, PhD, es profesora asistente de español y la Universidad de Mujeres de Texas.

Referencias

Baghurst, Timothy y Betty C. Kelley. “Un examen del estrés en los estudiantes universitarios en el transcurso de un semestre”. Práctica de promoción de la salud 15, no. 3 (2014): 438-447.

DeGrave, Pauline. “Música en el aula de idiomas extranjeros: cómo y por qué”. Revista de Enseñanza e Investigación de Lenguas 10, no. 3 (2019): 412-420.

Felder, Richard M. y Eunice R. Henriques. “Estilos de aprendizaje y enseñanza en la educación extranjera y de segundo idioma”. Anales de idiomas extranjeros 28, no. 1 (1995): 21-31.

Nuessel, Frank y April D. Marshall. “Prácticas y principios para involucrar a los tres modos comunicativos en español a través de canciones y música”. Hispania (2008): 139-146.

Kumar, Tribhuwan, Shamim Akhter, Mehrunnisa M. Yunus y Atefeh Shamsy. “Uso de la música y las canciones como herramientas pedagógicas en la enseñanza del inglés como contextos de idiomas extranjeros”. Education Research International 2022, no. 1 (2022): 1-9

Noticias

5 indicaciones de chatgpt que pueden ayudar a los adolescentes a lanzar una startup

Published

10 meses agoon

5 junio, 2025

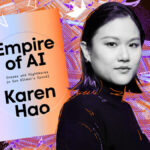

Teen emprendedor que usa chatgpt para ayudarlo con su negocio

El emprendimiento adolescente sigue en aumento. Según Junior Achievement Research, el 66% de los adolescentes estadounidenses de entre 13 y 17 años dicen que es probable que considere comenzar un negocio como adultos, con el monitor de emprendimiento global 2023-2024 que encuentra que el 24% de los jóvenes de 18 a 24 años son actualmente empresarios. Estos jóvenes fundadores no son solo soñando, están construyendo empresas reales que generan ingresos y crean un impacto social, y están utilizando las indicaciones de ChatGPT para ayudarlos.

En Wit (lo que sea necesario), la organización que fundó en 2009, hemos trabajado con más de 10,000 jóvenes empresarios. Durante el año pasado, he observado un cambio en cómo los adolescentes abordan la planificación comercial. Con nuestra orientación, están utilizando herramientas de IA como ChatGPT, no como atajos, sino como socios de pensamiento estratégico para aclarar ideas, probar conceptos y acelerar la ejecución.

Los emprendedores adolescentes más exitosos han descubierto indicaciones específicas que los ayudan a pasar de una idea a otra. Estas no son sesiones genéricas de lluvia de ideas: están utilizando preguntas específicas que abordan los desafíos únicos que enfrentan los jóvenes fundadores: recursos limitados, compromisos escolares y la necesidad de demostrar sus conceptos rápidamente.

Aquí hay cinco indicaciones de ChatGPT que ayudan constantemente a los emprendedores adolescentes a construir negocios que importan.

1. El problema del primer descubrimiento chatgpt aviso

“Me doy cuenta de que [specific group of people]

luchar contra [specific problem I’ve observed]. Ayúdame a entender mejor este problema explicando: 1) por qué existe este problema, 2) qué soluciones existen actualmente y por qué son insuficientes, 3) cuánto las personas podrían pagar para resolver esto, y 4) tres formas específicas en que podría probar si este es un problema real que vale la pena resolver “.

Un adolescente podría usar este aviso después de notar que los estudiantes en la escuela luchan por pagar el almuerzo. En lugar de asumir que entienden el alcance completo, podrían pedirle a ChatGPT que investigue la deuda del almuerzo escolar como un problema sistémico. Esta investigación puede llevarlos a crear un negocio basado en productos donde los ingresos ayuden a pagar la deuda del almuerzo, lo que combina ganancias con el propósito.

Los adolescentes notan problemas de manera diferente a los adultos porque experimentan frustraciones únicas, desde los desafíos de las organizaciones escolares hasta las redes sociales hasta las preocupaciones ambientales. Según la investigación de Square sobre empresarios de la Generación de la Generación Z, el 84% planea ser dueños de negocios dentro de cinco años, lo que los convierte en candidatos ideales para las empresas de resolución de problemas.

2. El aviso de chatgpt de chatgpt de chatgpt de realidad de la realidad del recurso

“Soy [age] años con aproximadamente [dollar amount] invertir y [number] Horas por semana disponibles entre la escuela y otros compromisos. Según estas limitaciones, ¿cuáles son tres modelos de negocio que podría lanzar de manera realista este verano? Para cada opción, incluya costos de inicio, requisitos de tiempo y los primeros tres pasos para comenzar “.

Este aviso se dirige al elefante en la sala: la mayoría de los empresarios adolescentes tienen dinero y tiempo limitados. Cuando un empresario de 16 años emplea este enfoque para evaluar un concepto de negocio de tarjetas de felicitación, puede descubrir que pueden comenzar con $ 200 y escalar gradualmente. Al ser realistas sobre las limitaciones por adelantado, evitan el exceso de compromiso y pueden construir hacia objetivos de ingresos sostenibles.

Según el informe de Gen Z de Square, el 45% de los jóvenes empresarios usan sus ahorros para iniciar negocios, con el 80% de lanzamiento en línea o con un componente móvil. Estos datos respaldan la efectividad de la planificación basada en restricciones: cuando funcionan los adolescentes dentro de las limitaciones realistas, crean modelos comerciales más sostenibles.

3. El aviso de chatgpt del simulador de voz del cliente

“Actúa como un [specific demographic] Y dame comentarios honestos sobre esta idea de negocio: [describe your concept]. ¿Qué te excitaría de esto? ¿Qué preocupaciones tendrías? ¿Cuánto pagarías de manera realista? ¿Qué necesitaría cambiar para que se convierta en un cliente? “

Los empresarios adolescentes a menudo luchan con la investigación de los clientes porque no pueden encuestar fácilmente a grandes grupos o contratar firmas de investigación de mercado. Este aviso ayuda a simular los comentarios de los clientes haciendo que ChatGPT adopte personas específicas.

Un adolescente que desarrolla un podcast para atletas adolescentes podría usar este enfoque pidiéndole a ChatGPT que responda a diferentes tipos de atletas adolescentes. Esto ayuda a identificar temas de contenido que resuenan y mensajes que se sienten auténticos para el público objetivo.

El aviso funciona mejor cuando se vuelve específico sobre la demografía, los puntos débiles y los contextos. “Actúa como un estudiante de último año de secundaria que solicita a la universidad” produce mejores ideas que “actuar como un adolescente”.

4. El mensaje mínimo de diseñador de prueba viable chatgpt

“Quiero probar esta idea de negocio: [describe concept] sin gastar más de [budget amount] o más de [time commitment]. Diseñe tres experimentos simples que podría ejecutar esta semana para validar la demanda de los clientes. Para cada prueba, explique lo que aprendería, cómo medir el éxito y qué resultados indicarían que debería avanzar “.

Este aviso ayuda a los adolescentes a adoptar la metodología Lean Startup sin perderse en la jerga comercial. El enfoque en “This Week” crea urgencia y evita la planificación interminable sin acción.

Un adolescente que desea probar un concepto de línea de ropa podría usar este indicador para diseñar experimentos de validación simples, como publicar maquetas de diseño en las redes sociales para evaluar el interés, crear un formulario de Google para recolectar pedidos anticipados y pedirles a los amigos que compartan el concepto con sus redes. Estas pruebas no cuestan nada más que proporcionar datos cruciales sobre la demanda y los precios.

5. El aviso de chatgpt del generador de claridad de tono

“Convierta esta idea de negocio en una clara explicación de 60 segundos: [describe your business]. La explicación debe incluir: el problema que resuelve, su solución, a quién ayuda, por qué lo elegirían sobre las alternativas y cómo se ve el éxito. Escríbelo en lenguaje de conversación que un adolescente realmente usaría “.

La comunicación clara separa a los empresarios exitosos de aquellos con buenas ideas pero una ejecución deficiente. Este aviso ayuda a los adolescentes a destilar conceptos complejos a explicaciones convincentes que pueden usar en todas partes, desde las publicaciones en las redes sociales hasta las conversaciones con posibles mentores.

El énfasis en el “lenguaje de conversación que un adolescente realmente usaría” es importante. Muchas plantillas de lanzamiento comercial suenan artificiales cuando se entregan jóvenes fundadores. La autenticidad es más importante que la jerga corporativa.

Más allá de las indicaciones de chatgpt: estrategia de implementación

La diferencia entre los adolescentes que usan estas indicaciones de manera efectiva y aquellos que no se reducen a seguir. ChatGPT proporciona dirección, pero la acción crea resultados.

Los jóvenes empresarios más exitosos con los que trabajo usan estas indicaciones como puntos de partida, no de punto final. Toman las sugerencias generadas por IA e inmediatamente las prueban en el mundo real. Llaman a clientes potenciales, crean prototipos simples e iteran en función de los comentarios reales.

Investigaciones recientes de Junior Achievement muestran que el 69% de los adolescentes tienen ideas de negocios, pero se sienten inciertos sobre el proceso de partida, con el miedo a que el fracaso sea la principal preocupación para el 67% de los posibles empresarios adolescentes. Estas indicaciones abordan esa incertidumbre al desactivar los conceptos abstractos en los próximos pasos concretos.

La imagen más grande

Los emprendedores adolescentes que utilizan herramientas de IA como ChatGPT representan un cambio en cómo está ocurriendo la educación empresarial. Según la investigación mundial de monitores empresariales, los jóvenes empresarios tienen 1,6 veces más probabilidades que los adultos de querer comenzar un negocio, y son particularmente activos en la tecnología, la alimentación y las bebidas, la moda y los sectores de entretenimiento. En lugar de esperar clases de emprendimiento formales o programas de MBA, estos jóvenes fundadores están accediendo a herramientas de pensamiento estratégico de inmediato.

Esta tendencia se alinea con cambios más amplios en la educación y la fuerza laboral. El Foro Económico Mundial identifica la creatividad, el pensamiento crítico y la resiliencia como las principales habilidades para 2025, la capacidad de las capacidades que el espíritu empresarial desarrolla naturalmente.

Programas como WIT brindan soporte estructurado para este viaje, pero las herramientas en sí mismas se están volviendo cada vez más accesibles. Un adolescente con acceso a Internet ahora puede acceder a recursos de planificación empresarial que anteriormente estaban disponibles solo para empresarios establecidos con presupuestos significativos.

La clave es usar estas herramientas cuidadosamente. ChatGPT puede acelerar el pensamiento y proporcionar marcos, pero no puede reemplazar el arduo trabajo de construir relaciones, crear productos y servir a los clientes. La mejor idea de negocio no es la más original, es la que resuelve un problema real para personas reales. Las herramientas de IA pueden ayudar a identificar esas oportunidades, pero solo la acción puede convertirlos en empresas que importan.

Noticias

Chatgpt vs. gemini: he probado ambos, y uno definitivamente es mejor

Published

10 meses agoon

5 junio, 2025

Precio

ChatGPT y Gemini tienen versiones gratuitas que limitan su acceso a características y modelos. Los planes premium para ambos también comienzan en alrededor de $ 20 por mes. Las características de chatbot, como investigaciones profundas, generación de imágenes y videos, búsqueda web y más, son similares en ChatGPT y Gemini. Sin embargo, los planes de Gemini pagados también incluyen el almacenamiento en la nube de Google Drive (a partir de 2TB) y un conjunto robusto de integraciones en las aplicaciones de Google Workspace.

Los niveles de más alta gama de ChatGPT y Gemini desbloquean el aumento de los límites de uso y algunas características únicas, pero el costo mensual prohibitivo de estos planes (como $ 200 para Chatgpt Pro o $ 250 para Gemini Ai Ultra) los pone fuera del alcance de la mayoría de las personas. Las características específicas del plan Pro de ChatGPT, como el modo O1 Pro que aprovecha el poder de cálculo adicional para preguntas particularmente complicadas, no son especialmente relevantes para el consumidor promedio, por lo que no sentirá que se está perdiendo. Sin embargo, es probable que desee las características que son exclusivas del plan Ai Ultra de Gemini, como la generación de videos VEO 3.

Ganador: Géminis

Plataformas

Puede acceder a ChatGPT y Gemini en la web o a través de aplicaciones móviles (Android e iOS). ChatGPT también tiene aplicaciones de escritorio (macOS y Windows) y una extensión oficial para Google Chrome. Gemini no tiene aplicaciones de escritorio dedicadas o una extensión de Chrome, aunque se integra directamente con el navegador.

(Crédito: OpenAI/PCMAG)

Chatgpt está disponible en otros lugares, Como a través de Siri. Como se mencionó, puede acceder a Gemini en las aplicaciones de Google, como el calendario, Documento, ConducirGmail, Mapas, Mantener, FotosSábanas, y Música de YouTube. Tanto los modelos de Chatgpt como Gemini también aparecen en sitios como la perplejidad. Sin embargo, obtiene la mayor cantidad de funciones de estos chatbots en sus aplicaciones y portales web dedicados.

Las interfaces de ambos chatbots son en gran medida consistentes en todas las plataformas. Son fáciles de usar y no lo abruman con opciones y alternar. ChatGPT tiene algunas configuraciones más para jugar, como la capacidad de ajustar su personalidad, mientras que la profunda interfaz de investigación de Gemini hace un mejor uso de los bienes inmuebles de pantalla.

Ganador: empate

Modelos de IA

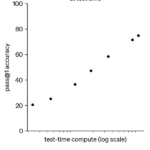

ChatGPT tiene dos series primarias de modelos, la serie 4 (su línea de conversación, insignia) y la Serie O (su compleja línea de razonamiento). Gemini ofrece de manera similar una serie Flash de uso general y una serie Pro para tareas más complicadas.

Los últimos modelos de Chatgpt son O3 y O4-Mini, y los últimos de Gemini son 2.5 Flash y 2.5 Pro. Fuera de la codificación o la resolución de una ecuación, pasará la mayor parte de su tiempo usando los modelos de la serie 4-Series y Flash. A continuación, puede ver cómo funcionan estos modelos en una variedad de tareas. Qué modelo es mejor depende realmente de lo que quieras hacer.

Ganador: empate

Búsqueda web

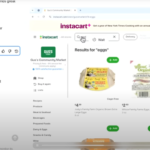

ChatGPT y Gemini pueden buscar información actualizada en la web con facilidad. Sin embargo, ChatGPT presenta mosaicos de artículos en la parte inferior de sus respuestas para una lectura adicional, tiene un excelente abastecimiento que facilita la vinculación de reclamos con evidencia, incluye imágenes en las respuestas cuando es relevante y, a menudo, proporciona más detalles en respuesta. Gemini no muestra nombres de fuente y títulos de artículos completos, e incluye mosaicos e imágenes de artículos solo cuando usa el modo AI de Google. El abastecimiento en este modo es aún menos robusto; Google relega las fuentes a los caretes que se pueden hacer clic que no resaltan las partes relevantes de su respuesta.

Como parte de sus experiencias de búsqueda en la web, ChatGPT y Gemini pueden ayudarlo a comprar. Si solicita consejos de compra, ambos presentan mosaicos haciendo clic en enlaces a los minoristas. Sin embargo, Gemini generalmente sugiere mejores productos y tiene una característica única en la que puede cargar una imagen tuya para probar digitalmente la ropa antes de comprar.

Ganador: chatgpt

Investigación profunda

ChatGPT y Gemini pueden generar informes que tienen docenas de páginas e incluyen más de 50 fuentes sobre cualquier tema. La mayor diferencia entre los dos se reduce al abastecimiento. Gemini a menudo cita más fuentes que CHATGPT, pero maneja el abastecimiento en informes de investigación profunda de la misma manera que lo hace en la búsqueda en modo AI, lo que significa caretas que se puede hacer clic sin destacados en el texto. Debido a que es más difícil conectar las afirmaciones en los informes de Géminis a fuentes reales, es más difícil creerles. El abastecimiento claro de ChatGPT con destacados en el texto es más fácil de confiar. Sin embargo, Gemini tiene algunas características de calidad de vida en ChatGPT, como la capacidad de exportar informes formateados correctamente a Google Docs con un solo clic. Su tono también es diferente. Los informes de ChatGPT se leen como publicaciones de foro elaboradas, mientras que los informes de Gemini se leen como documentos académicos.

Ganador: chatgpt

Generación de imágenes

La generación de imágenes de ChatGPT impresiona independientemente de lo que solicite, incluso las indicaciones complejas para paneles o diagramas cómicos. No es perfecto, pero los errores y la distorsión son mínimos. Gemini genera imágenes visualmente atractivas más rápido que ChatGPT, pero rutinariamente incluyen errores y distorsión notables. Con indicaciones complicadas, especialmente diagramas, Gemini produjo resultados sin sentido en las pruebas.

Arriba, puede ver cómo ChatGPT (primera diapositiva) y Géminis (segunda diapositiva) les fue con el siguiente mensaje: “Genere una imagen de un estudio de moda con una decoración simple y rústica que contrasta con el espacio más agradable. Incluya un sofá marrón y paredes de ladrillo”. La imagen de ChatGPT limita los problemas al detalle fino en las hojas de sus plantas y texto en su libro, mientras que la imagen de Gemini muestra problemas más notables en su tubo de cordón y lámpara.

Ganador: chatgpt

¡Obtenga nuestras mejores historias!

Toda la última tecnología, probada por nuestros expertos

Regístrese en el boletín de informes de laboratorio para recibir las últimas revisiones de productos de PCMAG, comprar asesoramiento e ideas.

Al hacer clic en Registrarme, confirma que tiene más de 16 años y acepta nuestros Términos de uso y Política de privacidad.

¡Gracias por registrarse!

Su suscripción ha sido confirmada. ¡Esté atento a su bandeja de entrada!

Generación de videos

La generación de videos de Gemini es la mejor de su clase, especialmente porque ChatGPT no puede igualar su capacidad para producir audio acompañante. Actualmente, Google bloquea el último modelo de generación de videos de Gemini, VEO 3, detrás del costoso plan AI Ultra, pero obtienes más videos realistas que con ChatGPT. Gemini también tiene otras características que ChatGPT no, como la herramienta Flow Filmmaker, que le permite extender los clips generados y el animador AI Whisk, que le permite animar imágenes fijas. Sin embargo, tenga en cuenta que incluso con VEO 3, aún necesita generar videos varias veces para obtener un gran resultado.

En el ejemplo anterior, solicité a ChatGPT y Gemini a mostrarme un solucionador de cubos de Rubik Rubik que resuelva un cubo. La persona en el video de Géminis se ve muy bien, y el audio acompañante es competente. Al final, hay una buena atención al detalle con el marco que se desplaza, simulando la detención de una grabación de selfies. Mientras tanto, Chatgpt luchó con su cubo, distorsionándolo en gran medida.

Ganador: Géminis

Procesamiento de archivos

Comprender los archivos es una fortaleza de ChatGPT y Gemini. Ya sea que desee que respondan preguntas sobre un manual, editen un currículum o le informen algo sobre una imagen, ninguno decepciona. Sin embargo, ChatGPT tiene la ventaja sobre Gemini, ya que ofrece un reconocimiento de imagen ligeramente mejor y respuestas más detalladas cuando pregunta sobre los archivos cargados. Ambos chatbots todavía a veces inventan citas de documentos proporcionados o malinterpretan las imágenes, así que asegúrese de verificar sus resultados.

Ganador: chatgpt

Escritura creativa

Chatgpt y Gemini pueden generar poemas, obras, historias y más competentes. CHATGPT, sin embargo, se destaca entre los dos debido a cuán únicas son sus respuestas y qué tan bien responde a las indicaciones. Las respuestas de Gemini pueden sentirse repetitivas si no calibra cuidadosamente sus solicitudes, y no siempre sigue todas las instrucciones a la carta.

En el ejemplo anterior, solicité ChatGPT (primera diapositiva) y Gemini (segunda diapositiva) con lo siguiente: “Sin hacer referencia a nada en su memoria o respuestas anteriores, quiero que me escriba un poema de verso gratuito. Preste atención especial a la capitalización, enjambment, ruptura de línea y puntuación. Dado que es un verso libre, no quiero un medidor familiar o un esquema de retiro de la rima, pero quiero que tenga un estilo de coohes. ChatGPT logró entregar lo que pedí en el aviso, y eso era distinto de las generaciones anteriores. Gemini tuvo problemas para generar un poema que incorporó cualquier cosa más allá de las comas y los períodos, y su poema anterior se lee de manera muy similar a un poema que generó antes.

Recomendado por nuestros editores

Ganador: chatgpt

Razonamiento complejo

Los modelos de razonamiento complejos de Chatgpt y Gemini pueden manejar preguntas de informática, matemáticas y física con facilidad, así como mostrar de manera competente su trabajo. En las pruebas, ChatGPT dio respuestas correctas un poco más a menudo que Gemini, pero su rendimiento es bastante similar. Ambos chatbots pueden y le darán respuestas incorrectas, por lo que verificar su trabajo aún es vital si está haciendo algo importante o tratando de aprender un concepto.

Ganador: chatgpt

Integración

ChatGPT no tiene integraciones significativas, mientras que las integraciones de Gemini son una característica definitoria. Ya sea que desee obtener ayuda para editar un ensayo en Google Docs, comparta una pestaña Chrome para hacer una pregunta, pruebe una nueva lista de reproducción de música de YouTube personalizada para su gusto o desbloquee ideas personales en Gmail, Gemini puede hacer todo y mucho más. Es difícil subestimar cuán integrales y poderosas son realmente las integraciones de Géminis.

Ganador: Géminis

Asistentes de IA

ChatGPT tiene GPT personalizados, y Gemini tiene gemas. Ambos son asistentes de IA personalizables. Tampoco es una gran actualización sobre hablar directamente con los chatbots, pero los GPT personalizados de terceros agregan una nueva funcionalidad, como el fácil acceso a Canva para editar imágenes generadas. Mientras tanto, terceros no pueden crear gemas, y no puedes compartirlas. Puede permitir que los GPT personalizados accedan a la información externa o tomen acciones externas, pero las GEM no tienen una funcionalidad similar.

Ganador: chatgpt

Contexto Windows y límites de uso

La ventana de contexto de ChatGPT sube a 128,000 tokens en sus planes de nivel superior, y todos los planes tienen límites de uso dinámicos basados en la carga del servidor. Géminis, por otro lado, tiene una ventana de contexto de 1,000,000 token. Google no está demasiado claro en los límites de uso exactos para Gemini, pero también son dinámicos dependiendo de la carga del servidor. Anecdóticamente, no pude alcanzar los límites de uso usando los planes pagados de Chatgpt o Gemini, pero es mucho más fácil hacerlo con los planes gratuitos.

Ganador: Géminis

Privacidad

La privacidad en Chatgpt y Gemini es una bolsa mixta. Ambos recopilan cantidades significativas de datos, incluidos todos sus chats, y usan esos datos para capacitar a sus modelos de IA de forma predeterminada. Sin embargo, ambos le dan la opción de apagar el entrenamiento. Google al menos no recopila y usa datos de Gemini para fines de capacitación en aplicaciones de espacio de trabajo, como Gmail, de forma predeterminada. ChatGPT y Gemini también prometen no vender sus datos o usarlos para la orientación de anuncios, pero Google y OpenAI tienen historias sórdidas cuando se trata de hacks, filtraciones y diversos fechorías digitales, por lo que recomiendo no compartir nada demasiado sensible.

Ganador: empate

Related posts

Trending

-

Startups2 años ago

Startups2 años agoRemove.bg: La Revolución en la Edición de Imágenes que Debes Conocer

-

Tutoriales2 años ago

Tutoriales2 años agoCómo Comenzar a Utilizar ChatGPT: Una Guía Completa para Principiantes

-

Startups2 años ago

Startups2 años agoDeepgram: Revolucionando el Reconocimiento de Voz con IA

-

Startups2 años ago

Startups2 años agoStartups de IA en EE.UU. que han recaudado más de $100M en 2024

-

Recursos2 años ago

Recursos2 años agoCómo Empezar con Popai.pro: Tu Espacio Personal de IA – Guía Completa, Instalación, Versiones y Precios

-

Recursos2 años ago

Recursos2 años agoPerplexity aplicado al Marketing Digital y Estrategias SEO

-

Estudiar IA2 años ago

Estudiar IA2 años agoCurso de Inteligencia Artificial Aplicada de 4Geeks Academy 2024

-

Noticias2 años ago

Noticias2 años agoDos periodistas octogenarios deman a ChatGPT por robar su trabajo