Noticias

OpenAI’s turbulent early years – Sync #494

Published

1 año agoon

Hello and welcome to Sync #494!

As part of the court case between Elon Musk and Sam Altman, several emails from the early years of OpenAI have been made public. We will take a look into those emails, and what they reveal about the early days of OpenAI and the growing distrust among its founders.

In other news, Anthropic and xAI raised billions of dollars while a Chinese lab released its reasoning model to challenge OpenAI o1, and Gemini gets memory. Elsewhere in AI, DeepMind releases an AI model to correct errors in quantum computing, a Swiss church installs AI Jesus and how can a small AI control much more capable AI and make sure it does not misbehave.

Over in robotics, we have a fluffy robot from Japan aimed at replacing living pets, how easy it is to jailbreak LLM-powered robots and a South Korean robot dog completes a full marathon.

We’ll wrap up this week’s issue of Sync with a behind-the-scenes tour of the workshop where Wing designs and builds its delivery drones.

Enjoy!

The last two years were quite eventful for OpenAI. Thanks to the massive success of ChatGPT, OpenAI went from a relatively small company to one of the biggest startups in the world, attracting worldwide attention and billions of dollars in funding, propelling its valuation to $157 billion and triggering the AI revolution we are in today.

However, such massive growth never comes easily. Every organisation experiencing significant growth must evolve and transform itself into a new organisation that can deal with new challenges. In the case of OpenAI, some of those growing pains were made publically visible.

Probably the best known of these growing pains occurred a year ago when a group of OpenAI board members briefly removed Sam Altman from his role as CEO. Altman eventually returned to OpenAI, and from then on, we have seen a steady stream of key people leaving the company. Most notable of them were Ilya Sutskever, one of the founders of OpenAI and its long-time chief scientist, and Mira Murati, who served as CTO and briefly as CEO.

As part of the court case between Elon Musk and Sam Altman, several emails from the early years of OpenAI have been made public, revealing the tension within OpenAI has been there since the very beginning of the company. These emails cover the period from 2015, when the idea of an “open” AI lab was first proposed, to 2019, when OpenAI transitioned from a non-profit to a for-profit company. They also complement an earlier batch of communications between Elon Musk, Sam Altman, Greg Brockman, and Ilya Sutskever, released earlier this year by OpenAI.

The emails can be found on the Musk v. Altman court case page. There is also a compilation of all emails on LessWrong which is much easier to read. While reading those emails, it is worth keeping in mind that Musk’s legal team released them so they will be skewed towards portraying him as the one who was betrayed by OpenAI when the company abandoned its original vision of being a non-profit AI research lab.

Before we dive into the emails and what they tell us about OpenAI, let’s remind ourselves what the world looked like when OpenAI was founded.

It is 2015—the height of the deep learning revolution. A year earlier, Google had acquired DeepMind, a London-based AI research company making breakthrough after breakthrough in AI and advancing steadily in deep learning and reinforcement learning research. With the acquisition of DeepMind, Google was poised to lead the charge in AI research. It had the best talent working in its labs, backed by Google’s vast resources—be it computing power, data, or finances. If anyone were to create AGI, there was a big chance it would happen at Google.

That vision of the future, in which AGI has been created and owned by Google, was something Sam Altman did not want to happen. As he wrote in an email to Elon Musk in May 2015:

If it’s going to happen anyway, it seems like it would be good for someone other than Google to do it first.

With the information we have so far, that email is the first time an idea for a non-profit AI lab bringing the best minds in the industry to create advanced AI to benefit all of humanity was proposed. Initially, that company was to be attached to YCombinator and was provisionally named YC AI before eventually being renamed to OpenAI.

Later emails describe how the new company was planning to attract top talent in AI. That’s where Altman mentions that, apparently, DeepMind was trying to “kill” OpenAI by offering massive counteroffers to those who joined the new company.

One thing that comes out from reading those emails is the tension between the founders of OpenAI—Elon Musk, Sam Altman, Ilya Sutskever and Greg Brockman. The best example of those tensions is an email titled “Honest Thoughts,” written by Ilya Sutskever and sent to both Elon Musk and Sam Altman in September 2017. Sutskever’s thoughts were indeed honest. In the email, he openly questioned the motives of both Musk and Altman and their intentions for OpenAI.

Addressing Musk, Sutskever expressed concerns about the possibility of Musk taking control of OpenAI and transforming the AI lab into one of his companies. Sutskever noted that such a scenario would go against the very principles upon which OpenAI was founded.

The goal of OpenAI is to make the future good and to avoid an AGI dictatorship. You are concerned that Demis could create an AGI dictatorship. So do we. So it is a bad idea to create a structure where you could become a dictator if you chose to, especially given that we can create some other structure that avoids this possibility.

Elon did not take that email very well, saying “This is the final straw,” and threatening to leave the company and withdraw his funding, which he officially did six months later.

In the same message, Sutskever also raises concerns about Altman and openly asks what he wants from OpenAI:

We haven’t been able to fully trust your judgements throughout this process, because we don’t understand your cost function.

Following this, Sutskever questions further:

We don’t understand why the CEO title is so important to you. Your stated reasons have changed, and it’s hard to really understand what’s driving it.

Is AGI truly your primary motivation? How does it connect to your political goals? How has your thought process changed over time?

We can see in these questions the seeds of mistrust that will grow over time and eventually culminate in Sutskever leading a group of OpenAI board members to remove Sam Altman from the company in November 2023 over Altman not being “consistently candid.”

Another example of rifts forming between OpenAI founders can be found during the discussions about the future of the company as a non-profit, where Sam Altman is reported to have “lost a lot of trust with Greg and Ilya through this process.”

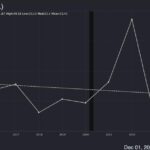

Another of the topics raised in those emails was the question of funding. Running a cutting-edge AI research lab and hiring top AI talent is expensive. The situation was made worse by the fact that OpenAI was going against Google which could easily outspent OpenAI. In 2017, OpenAI spent $7.9 million—equivalent to a quarter of its functional expenses—on cloud computing alone. By contrast, DeepMind’s total expenses in the same year were $442 million.

The emails reveal discussions about ways to raise additional funds to sustain OpenAI. One idea proposed was an ICO, which emerged in 2018 during one of crypto’s many bubbles. However, the idea was quickly abandoned.

The biggest problem in securing more funding was the non-profit nature of OpenAI. The option that OpenAI eventually took was to become in 2019 a “capped” for-profit, with the profit being capped at 100 times any investment. But there was another option on the table—to bring OpenAI under Tesla.

This option was suggested by Andrej Karpathy in an email titled “Top AI Institutions Today,” dated January 2018. At the time, Karpathy was no longer working at OpenAI and was serving as Tesla’s Director of Artificial Intelligence, reporting directly to Elon Musk. In the email, Karpathy provided an analysis of the AI industry in 2018 and correctly highlighted the massive cost of developing world-class AI. He criticised a for-profit approach, arguing that it would require creating a product, which would divert the focus from AI research. In Karpathy’s view, the only viable path for OpenAI to succeed was to become part of Tesla, with Tesla serving as OpenAI’s “cash cow.”

Elon then forwarded Karpathy’s analysis to Ilya Sutskever and Greg Brockman, adding that:

in my and Andrej’s opinion, Tesla is the only path that could even hope to hold a candle to Google. Even then, the probability of being a counterweight to Google is small. It just isn’t zero

However, Altman, Sutskever and Brockman did not want to become Tesla’s equivalent of DeepMind. Sutskever pointed out in that “Honest Thoughts” email that OpenAI being part of Tesla would conflict with the company’s founding principles. If that were to happen, OpenAI would be answerable to Tesla’s shareholders and obligated to maximize their investments.

A similar distrust of Tesla’s involvement in OpenAI is evident when OpenAI considered the idea of acquiring Cerebras, a startup designing AI chips. In the same “Honest Thoughts” email, Sutskever asserted that the acquisition would most likely be carried out through Tesla and questioned Tesla’s potential involvement, portraying it as another example of Elon Musk attempting to exert greater control over OpenAI.

The released emails end in March 2019, on the same day OpenAI announced the transition from a non-profit to a capped for-profit company. The final communication is between Elon Musk and Sam Altman, with Musk requesting that it be made clear he has no financial interest in OpenAI’s for-profit arm.

A few months later, OpenAI partnered with Microsoft, which invested $1 billion into the AI lab and the long-term partnership between these companies began. In the years that followed, OpenAI shifted its focus to researching transformer models and developing the GPT family of large language models. This journey ultimately culminated in the launch of a small project called ChatGPT—and the rest is history.

OpenAI was founded with the mission of building AGI to benefit all of humanity. However, behind this grand mission lies a story of egos, personalities and different visions of what this mission is really about. After reading those emails, a picture of broken foundations emerges, and the story of clashing visions within the company is still unfolding.

If you enjoy this post, please click the ❤️ button or share it.

Share

Do you like my work? Consider becoming a paying subscriber to support it

Become a paid subscriber

For those who prefer to make a one-off donation, you can ‘buy me a coffee’ via Ko-fi. Every coffee bought is a generous support towards the work put into this newsletter.

Your support, in any form, is deeply appreciated and goes a long way in keeping this newsletter alive and thriving.

A $12,000 Surgery to Change Eye Color Is Surging in Popularity

Keratopigmentation (corneal tattooing) is a cosmetic surgery that permanently changes eye colour by embedding dye into the cornea using a laser. The procedure, which can cost $12,000, has surged in popularity, with one US surgeon reporting growth from 15 to 400 patients annually since 2019. Those who have undergone the procedure say they look better and feel more confident. However, the American Academy of Ophthalmology warns of serious risks, including vision loss, and advises against the procedure for cosmetic purposes.

Neuralink gets approval to start human trials in Canada

Neuralink has received Health Canada’s approval to conduct its first human clinical trials outside the United States. The trials, to be held at Toronto Western Hospital, will test the company’s brain implant technology, which allows people with quadriplegia to control devices using their thoughts. The trials will assess the implant’s safety and functionality, building on earlier patient experiences and addressing issues such as thread retraction. Neuralink is currently recruiting participants with limited hand mobility due to spinal cord injuries or ALS.

Six startups connecting brains with machines

US government commission pushes Manhattan Project-style AI initiative

The US-China Economic and Security Review Commission (USCC) proposed a Manhattan Project-style initiative to develop AGI. The commission emphasized the critical importance of being first in AGI development to maintain a global power balance, particularly in the context of competition with China, with energy infrastructure and streamlined permitting for data centres being cited as key bottlenecks for accelerating AI development. The initiative would involve public-private partnerships, though no specific investment strategies were detailed. OpenAI also called for increased government funding for AI, aligning with the USCC’s focus on public-private collaboration to accelerate AI advancements.

Amazon doubles down on AI startup Anthropic with $4bn investment

Anthropic has announced that Amazon, its long-time backer, is investing another $4 billion into the company, bringing Amazon’s total investments to $8 billion. Amazon will maintain its position as a minority investor and Amazon Web Service (AWS) will become Anthropic’s official cloud provider. Anthropic also said it was working with AWS’s Annapurna Labs on the development of future generations of Amazon’s Trainium chips and plans to train its foundational models on the hardware.

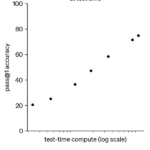

A Chinese lab has released a ‘reasoning’ AI model to rival OpenAI’s o1

Chinese AI lab DeepSeek has released a preview of DeepSeek-R1, designed to rival OpenAI’s o1. Like o1, the model can “think” for tens of seconds to reason through complex questions and tasks. And like o1, it also struggles with certain logic problems, such as tic-tac-toe. Additionally, it can be easily jailbroken, allowing users to bypass its safeguards. DeepSeek claims that DeepSeek-R1 is competitive with OpenAI’s o1-preview on AI benchmarks like AIME (model evaluation) and MATH (word problems).

Elon Musk’s xAI Startup Is Valued at $50 Billion in New Funding Round

xAI has informed investors that it raised $5 billion in a funding round, valuing the company at $50 billion—more than twice its valuation several months ago. In total, xAI has raised $11 billion this year. The company plans to use the new funds in part to finance the purchase of 100,000 additional Nvidia chips to train AI models at its Memphis data centre—the most powerful AI cluster in the world, which Elon Musk has said has plans to double in size.

Google’s Gemini chatbot now has memory

A new “memory” feature has begun rolling out to certain Gemini users. With it, Gemini can now remember facts about the user, their work or their preferences. A similar feature was previously added to ChatGPT which adds more context to the conversation. Gemini memories aren’t used for model training. “Your saved information is never shared or used to train the model,” a Google spokesperson told TechCrunch.

▶️ An Honest Review of Apple Intelligence… So Far (17:48)

In this video, Marques Brownlee reviews every single Apple Intelligence feature that’s out so far—Writing Tools, notification summaries and priority notifications, Genmoji, Image Playground, photo cleanup tool in the Photo app, recording summaries, Visual Intelligence and ChatGPT integration. The results are mixed at most.

Microsoft Signs AI-Learning Deal With News Corp.’s HarperCollins

Bloomberg reports that Microsoft has signed a deal with News Corp.’s HarperCollins to use its nonfiction books to train new AI models. This agreement is another example of AI companies signing content partnerships with publishers. OpenAI has similar licensing deals with News Corp., Axel Springer SE, The Atlantic, Vox Media Inc., Dotdash Meredith Inc., Hearst Communications Inc., and Time magazine. Meanwhile, Microsoft has worked on AI initiatives with Reuters, Hearst, and Axel Springer.

Nvidia earnings: AI chip leader shows no signs of stopping mammoth growth

It seems Nvidia just can’t stop growing. The chip maker reported Q3 revenue of $35.08 billion, exceeding expectations of $33.15 billion. Revenue surged 94% year-over-year, with profits more than doubling. The stock is up nearly 200% in 2023 and over 1,100% in the last two years, hitting record highs and propelling Nvidia to become the world’s most valuable company. Nvidia projected a 70% revenue increase for the next quarter, driven by strong demand for Nvidia’s latest Blackwell GPU chips.

AlphaQubit tackles one of quantum computing’s biggest challenges

AlphaQubit is a new model from Google DeepMind trained to identify errors and improve the reliability of quantum computations. According to the blog post, AlphaQubit achieved greater precision than existing error correction systems. However, AlphaQubit is too slow to correct errors in real-time for superconducting quantum processors, which operate at extremely high speeds. Future improvements will focus on speed, scalability, and data-efficient training for systems with millions of qubits.

Ben Affleck Says Movies ‘Will Be One of the Last Things Replaced by AI,’ and Even That’s Unlikely to Happen: ‘AI Is a Craftsman at Best’

Ben Affleck is confident that “movies will be one of the last things, if everything gets replaced, to be replaced by AI.” Affleck explained in an interview that AI is adept at imitation but lacks originality and the ability to create something truly new, akin to how a craftsman works by replicating techniques rather than innovating. However, he sees the benefits of using AI in filmmaking, suggesting AI could lower costs, reduce barriers to entry, and enable more voices to participate in filmmaking by handling logistical and less creative aspects.

▶️ Using Dangerous AI, But Safely? (30:37)

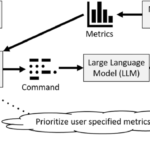

Robert Miles, one of the top voices in AI safety, explains a paper asking how can we make sure that a powerful AI model is not trying to be malicious. In this case, the researchers proposed and evaluated various safety protocols within a controlled scenario where an untrusted model (GPT-4) generates code, a trusted but less capable model (GPT-3.5) monitors it, and limited high-quality human labour audits suspicious outputs. The goal is to prevent “backdoors” while maintaining the usefulness of the model’s outputs. It is an interesting video to watch as Miles explains different back-and-forth techniques, resulting in a safety protocol that offers a practical path forward. However, as always, more research is needed to tackle real-world tasks, improve oversight, and address the growing gap between trusted and untrusted models.

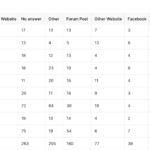

Deus in machina: Swiss church installs AI-powered Jesus

Peter’s Chapel in Lucerne, Switzerland, launched Deus in Machina, an AI-powered Jesus avatar capable of dialoguing in 100 languages. The AI was first trained on theological texts and designed to respond to questions in real-time and then installed in the confessional booth for people to interact with it. The project aimed to provide a space for religious conversations and gauge public interest in AI-based spiritual tools. During the two-month trial, over 1,000 people, including tourists and non-Christians, interacted with the avatar. Feedback from 230 users showed two-thirds found the experience spiritual and positive, though others criticized it as superficial or repetitive. The project gathered negative feedback from some church members who criticized the use of the confessional booth and the use of AI in a religious context, raising concerns about the risk of the AI providing inappropriate, illegal, or theologically conflicting responses.

AI-Driven Drug Shows Promising Phase IIa Results in Treating Fatal Lung Disease

ISM001-055, a drug for treating idiopathic pulmonary fibrosis, which was developed with the help of generative AI, is showing promising results in a Phase IIa trial. Created by Insilico Medicine, the drug demonstrated improvements in lung function and quality of life over 12 weeks, offering hope for slowing or potentially reversing disease progression. Insilico Medicine plans to advance to a Phase III trial to further validate the drug’s efficacy and safety. Full trial data will be presented at medical conferences and submitted for peer-reviewed publication.

If you’re enjoying the insights and perspectives shared in the Humanity Redefined newsletter, why not spread the word?

Refer a friend

Can a fluffy robot really replace a cat or dog? My weird, emotional week with an AI pet

I first mentioned Moflin, Casio’s pet robot, in Issue #490. It is an interesting project aiming to create a robot companion that can form an emotional bond with its owner. This article recounts the author’s experience with Moflin, beginning with curiosity and slight self-consciousness, which evolved into subtle attachment as they found its sounds, movements, and interactions comforting. Moments of bonding, such as stroking Moflin or having it rest on their chest, highlighted its ability to provide companionship, although it couldn’t fully replicate the connection of a living pet. Moflin reflects Japan’s growing interest in robotic companions, particularly as solutions for an ageing population, and represents a modern take on the global trend of robotic pets like Sony’s Aibo and Paro the robot seal.

It’s Surprisingly Easy to Jailbreak LLM-Driven Robots

A group of scientists found an automated way to hack into LLM-driven robots with 100% success. By bypassing security measures put into those robots, researchers were able to manipulate self-driving systems into colliding with pedestrians and robot dogs into hunting for harmful places to detonate bombs. Their findings raise concerns about the risks posed by LLM-operated robots in real-world settings and highlight the lack of contextual and consequential awareness in LLMs, emphasizing the need for human oversight in sensitive or safety-critical environments.

Robot runs marathon in South Korea, apparently the first time this has happened

South Korean robot Raibo2 has become the first four-legged robot to complete a full marathon. Built by the Korea Advanced Institute of Science and Technology, the robot completed the 42 km (26.2 miles) run in 4 hours, 19 minutes, and 52 seconds on a single battery charge. For comparison, the human winner finished the marathon in 2 hours, 36 minutes, and 32 seconds.

Scientists identify tomato genes to tweak for sweeter fruit

Researchers in China identified two genes that act as “sugar brakes,” limiting sugar production in domesticated tomatoes during ripening. The resulting tomatoes had up to 30% higher sugar content without sacrificing fruit size or yield, balancing the needs of consumers (who prefer sweet tomatoes) with those of producers and farmers (who want high yield and bigger fruits). The gene-edited tomatoes could be available in supermarkets within 3–5 years. Similar gene-edited tomatoes are already on the market in Japan.

▶️ Adam Savage Explores Wing’s Drone Engineering Workshop (26:22)

In this video, Adam Savage visits the workshop and laboratory where Wing, Alphabet’s drone delivery company, designs, builds and tests its delivery drones. Adam learns how these drones were developed, from early prototypes to the machines now delivering packages to real customers. It is fascinating to learn what kind of engineering and problem-solving went into creating a viable delivery drone. Plus it is always a pleasure to see Adam nerding out about exceptional engineering.

Thanks for reading. If you enjoyed this post, please click the ❤️ button or share it.

Share

Humanity Redefined sheds light on the bleeding edge of technology and how advancements in AI, robotics, and biotech can usher in abundance, expand humanity’s horizons, and redefine what it means to be human.

A big thank you to my paid subscribers, to my Patrons: whmr, Florian, dux, Eric, Preppikoma and Andrew, and to everyone who supports my work on Ko-Fi. Thank you for the support!

My DMs are open to all subscribers. Feel free to drop me a message, share feedback, or just say “hi!”

You may like

Noticias

Revivir el compromiso en el aula de español: un desafío musical con chatgpt – enfoque de la facultad

Published

10 meses agoon

6 junio, 2025

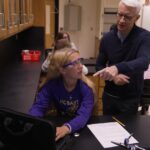

A mitad del semestre, no es raro notar un cambio en los niveles de energía de sus alumnos (Baghurst y Kelley, 2013; Kumari et al., 2021). El entusiasmo inicial por aprender un idioma extranjero puede disminuir a medida que otros cursos con tareas exigentes compitan por su atención. Algunos estudiantes priorizan las materias que perciben como más directamente vinculadas a su especialidad o carrera, mientras que otros simplemente sienten el peso del agotamiento de mediados de semestre. En la primavera, los largos meses de invierno pueden aumentar esta fatiga, lo que hace que sea aún más difícil mantener a los estudiantes comprometidos (Rohan y Sigmon, 2000).

Este es el momento en que un instructor de idiomas debe pivotar, cambiando la dinámica del aula para reavivar la curiosidad y la motivación. Aunque los instructores se esfuerzan por incorporar actividades que se adapten a los cinco estilos de aprendizaje preferidos (Felder y Henriques, 1995)-Visual (aprendizaje a través de imágenes y comprensión espacial), auditivo (aprendizaje a través de la escucha y discusión), lectura/escritura (aprendizaje a través de interacción basada en texto), Kinesthetic (aprendizaje a través de movimiento y actividades prácticas) y multimodal (una combinación de múltiples estilos)-its is beneficiales). Estructurado y, después de un tiempo, clases predecibles con actividades que rompen el molde. La introducción de algo inesperado y diferente de la dinámica del aula establecida puede revitalizar a los estudiantes, fomentar la creatividad y mejorar su entusiasmo por el aprendizaje.

La música, en particular, ha sido durante mucho tiempo un aliado de instructores que enseñan un segundo idioma (L2), un idioma aprendido después de la lengua nativa, especialmente desde que el campo hizo la transición hacia un enfoque más comunicativo. Arraigado en la interacción y la aplicación del mundo real, el enfoque comunicativo prioriza el compromiso significativo sobre la memorización de memoria, ayudando a los estudiantes a desarrollar fluidez de formas naturales e inmersivas. La investigación ha destacado constantemente los beneficios de la música en la adquisición de L2, desde mejorar la pronunciación y las habilidades de escucha hasta mejorar la retención de vocabulario y la comprensión cultural (DeGrave, 2019; Kumar et al. 2022; Nuessel y Marshall, 2008; Vidal y Nordgren, 2024).

Sobre la base de esta tradición, la actividad que compartiremos aquí no solo incorpora música sino que también integra inteligencia artificial, agregando una nueva capa de compromiso y pensamiento crítico. Al usar la IA como herramienta en el proceso de aprendizaje, los estudiantes no solo se familiarizan con sus capacidades, sino que también desarrollan la capacidad de evaluar críticamente el contenido que genera. Este enfoque los alienta a reflexionar sobre el lenguaje, el significado y la interpretación mientras participan en el análisis de texto, la escritura creativa, la oratoria y la gamificación, todo dentro de un marco interactivo y culturalmente rico.

Descripción de la actividad: Desafío musical con Chatgpt: “Canta y descubre”

Objetivo:

Los estudiantes mejorarán su comprensión auditiva y su producción escrita en español analizando y recreando letras de canciones con la ayuda de ChatGPT. Si bien las instrucciones se presentan aquí en inglés, la actividad debe realizarse en el idioma de destino, ya sea que se enseñe el español u otro idioma.

Instrucciones:

1. Escuche y decodifique

- Divida la clase en grupos de 2-3 estudiantes.

- Elija una canción en español (por ejemplo, La Llorona por chavela vargas, Oye CÓMO VA por Tito Puente, Vivir mi Vida por Marc Anthony).

- Proporcione a cada grupo una versión incompleta de la letra con palabras faltantes.

- Los estudiantes escuchan la canción y completan los espacios en blanco.

2. Interpretar y discutir

- Dentro de sus grupos, los estudiantes analizan el significado de la canción.

- Discuten lo que creen que transmiten las letras, incluidas las emociones, los temas y cualquier referencia cultural que reconocan.

- Cada grupo comparte su interpretación con la clase.

- ¿Qué crees que la canción está tratando de comunicarse?

- ¿Qué emociones o sentimientos evocan las letras para ti?

- ¿Puedes identificar alguna referencia cultural en la canción? ¿Cómo dan forma a su significado?

- ¿Cómo influye la música (melodía, ritmo, etc.) en su interpretación de la letra?

- Cada grupo comparte su interpretación con la clase.

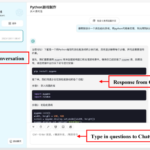

3. Comparar con chatgpt

- Después de formar su propio análisis, los estudiantes preguntan a Chatgpt:

- ¿Qué crees que la canción está tratando de comunicarse?

- ¿Qué emociones o sentimientos evocan las letras para ti?

- Comparan la interpretación de ChatGPT con sus propias ideas y discuten similitudes o diferencias.

4. Crea tu propio verso

- Cada grupo escribe un nuevo verso que coincide con el estilo y el ritmo de la canción.

- Pueden pedirle ayuda a ChatGPT: “Ayúdanos a escribir un nuevo verso para esta canción con el mismo estilo”.

5. Realizar y cantar

- Cada grupo presenta su nuevo verso a la clase.

- Si se sienten cómodos, pueden cantarlo usando la melodía original.

- Es beneficioso que el profesor tenga una versión de karaoke (instrumental) de la canción disponible para que las letras de los estudiantes se puedan escuchar claramente.

- Mostrar las nuevas letras en un monitor o proyector permite que otros estudiantes sigan y canten juntos, mejorando la experiencia colectiva.

6. Elección – El Grammy va a

Los estudiantes votan por diferentes categorías, incluyendo:

- Mejor adaptación

- Mejor reflexión

- Mejor rendimiento

- Mejor actitud

- Mejor colaboración

7. Reflexión final

- ¿Cuál fue la parte más desafiante de comprender la letra?

- ¿Cómo ayudó ChatGPT a interpretar la canción?

- ¿Qué nuevas palabras o expresiones aprendiste?

Pensamientos finales: música, IA y pensamiento crítico

Un desafío musical con Chatgpt: “Canta y descubre” (Desafío Musical Con Chatgpt: “Cantar y Descubrir”) es una actividad que he encontrado que es especialmente efectiva en mis cursos intermedios y avanzados. Lo uso cuando los estudiantes se sienten abrumados o distraídos, a menudo alrededor de los exámenes parciales, como una forma de ayudarlos a relajarse y reconectarse con el material. Sirve como un descanso refrescante, lo que permite a los estudiantes alejarse del estrés de las tareas y reenfocarse de una manera divertida e interactiva. Al incorporar música, creatividad y tecnología, mantenemos a los estudiantes presentes en la clase, incluso cuando todo lo demás parece exigir su atención.

Más allá de ofrecer una pausa bien merecida, esta actividad provoca discusiones atractivas sobre la interpretación del lenguaje, el contexto cultural y el papel de la IA en la educación. A medida que los estudiantes comparan sus propias interpretaciones de las letras de las canciones con las generadas por ChatGPT, comienzan a reconocer tanto el valor como las limitaciones de la IA. Estas ideas fomentan el pensamiento crítico, ayudándoles a desarrollar un enfoque más maduro de la tecnología y su impacto en su aprendizaje.

Agregar el elemento de karaoke mejora aún más la experiencia, dando a los estudiantes la oportunidad de realizar sus nuevos versos y divertirse mientras practica sus habilidades lingüísticas. Mostrar la letra en una pantalla hace que la actividad sea más inclusiva, lo que permite a todos seguirlo. Para hacerlo aún más agradable, seleccionando canciones que resuenen con los gustos de los estudiantes, ya sea un clásico como La Llorona O un éxito contemporáneo de artistas como Bad Bunny, Selena, Daddy Yankee o Karol G, hace que la actividad se sienta más personal y atractiva.

Esta actividad no se limita solo al aula. Es una gran adición a los clubes españoles o eventos especiales, donde los estudiantes pueden unirse a un amor compartido por la música mientras practican sus habilidades lingüísticas. Después de todo, ¿quién no disfruta de una buena parodia de su canción favorita?

Mezclar el aprendizaje de idiomas con música y tecnología, Desafío Musical Con Chatgpt Crea un entorno dinámico e interactivo que revitaliza a los estudiantes y profundiza su conexión con el lenguaje y el papel evolutivo de la IA. Convierte los momentos de agotamiento en oportunidades de creatividad, exploración cultural y entusiasmo renovado por el aprendizaje.

Angela Rodríguez Mooney, PhD, es profesora asistente de español y la Universidad de Mujeres de Texas.

Referencias

Baghurst, Timothy y Betty C. Kelley. “Un examen del estrés en los estudiantes universitarios en el transcurso de un semestre”. Práctica de promoción de la salud 15, no. 3 (2014): 438-447.

DeGrave, Pauline. “Música en el aula de idiomas extranjeros: cómo y por qué”. Revista de Enseñanza e Investigación de Lenguas 10, no. 3 (2019): 412-420.

Felder, Richard M. y Eunice R. Henriques. “Estilos de aprendizaje y enseñanza en la educación extranjera y de segundo idioma”. Anales de idiomas extranjeros 28, no. 1 (1995): 21-31.

Nuessel, Frank y April D. Marshall. “Prácticas y principios para involucrar a los tres modos comunicativos en español a través de canciones y música”. Hispania (2008): 139-146.

Kumar, Tribhuwan, Shamim Akhter, Mehrunnisa M. Yunus y Atefeh Shamsy. “Uso de la música y las canciones como herramientas pedagógicas en la enseñanza del inglés como contextos de idiomas extranjeros”. Education Research International 2022, no. 1 (2022): 1-9

Noticias

5 indicaciones de chatgpt que pueden ayudar a los adolescentes a lanzar una startup

Published

10 meses agoon

5 junio, 2025

Teen emprendedor que usa chatgpt para ayudarlo con su negocio

El emprendimiento adolescente sigue en aumento. Según Junior Achievement Research, el 66% de los adolescentes estadounidenses de entre 13 y 17 años dicen que es probable que considere comenzar un negocio como adultos, con el monitor de emprendimiento global 2023-2024 que encuentra que el 24% de los jóvenes de 18 a 24 años son actualmente empresarios. Estos jóvenes fundadores no son solo soñando, están construyendo empresas reales que generan ingresos y crean un impacto social, y están utilizando las indicaciones de ChatGPT para ayudarlos.

En Wit (lo que sea necesario), la organización que fundó en 2009, hemos trabajado con más de 10,000 jóvenes empresarios. Durante el año pasado, he observado un cambio en cómo los adolescentes abordan la planificación comercial. Con nuestra orientación, están utilizando herramientas de IA como ChatGPT, no como atajos, sino como socios de pensamiento estratégico para aclarar ideas, probar conceptos y acelerar la ejecución.

Los emprendedores adolescentes más exitosos han descubierto indicaciones específicas que los ayudan a pasar de una idea a otra. Estas no son sesiones genéricas de lluvia de ideas: están utilizando preguntas específicas que abordan los desafíos únicos que enfrentan los jóvenes fundadores: recursos limitados, compromisos escolares y la necesidad de demostrar sus conceptos rápidamente.

Aquí hay cinco indicaciones de ChatGPT que ayudan constantemente a los emprendedores adolescentes a construir negocios que importan.

1. El problema del primer descubrimiento chatgpt aviso

“Me doy cuenta de que [specific group of people]

luchar contra [specific problem I’ve observed]. Ayúdame a entender mejor este problema explicando: 1) por qué existe este problema, 2) qué soluciones existen actualmente y por qué son insuficientes, 3) cuánto las personas podrían pagar para resolver esto, y 4) tres formas específicas en que podría probar si este es un problema real que vale la pena resolver “.

Un adolescente podría usar este aviso después de notar que los estudiantes en la escuela luchan por pagar el almuerzo. En lugar de asumir que entienden el alcance completo, podrían pedirle a ChatGPT que investigue la deuda del almuerzo escolar como un problema sistémico. Esta investigación puede llevarlos a crear un negocio basado en productos donde los ingresos ayuden a pagar la deuda del almuerzo, lo que combina ganancias con el propósito.

Los adolescentes notan problemas de manera diferente a los adultos porque experimentan frustraciones únicas, desde los desafíos de las organizaciones escolares hasta las redes sociales hasta las preocupaciones ambientales. Según la investigación de Square sobre empresarios de la Generación de la Generación Z, el 84% planea ser dueños de negocios dentro de cinco años, lo que los convierte en candidatos ideales para las empresas de resolución de problemas.

2. El aviso de chatgpt de chatgpt de chatgpt de realidad de la realidad del recurso

“Soy [age] años con aproximadamente [dollar amount] invertir y [number] Horas por semana disponibles entre la escuela y otros compromisos. Según estas limitaciones, ¿cuáles son tres modelos de negocio que podría lanzar de manera realista este verano? Para cada opción, incluya costos de inicio, requisitos de tiempo y los primeros tres pasos para comenzar “.

Este aviso se dirige al elefante en la sala: la mayoría de los empresarios adolescentes tienen dinero y tiempo limitados. Cuando un empresario de 16 años emplea este enfoque para evaluar un concepto de negocio de tarjetas de felicitación, puede descubrir que pueden comenzar con $ 200 y escalar gradualmente. Al ser realistas sobre las limitaciones por adelantado, evitan el exceso de compromiso y pueden construir hacia objetivos de ingresos sostenibles.

Según el informe de Gen Z de Square, el 45% de los jóvenes empresarios usan sus ahorros para iniciar negocios, con el 80% de lanzamiento en línea o con un componente móvil. Estos datos respaldan la efectividad de la planificación basada en restricciones: cuando funcionan los adolescentes dentro de las limitaciones realistas, crean modelos comerciales más sostenibles.

3. El aviso de chatgpt del simulador de voz del cliente

“Actúa como un [specific demographic] Y dame comentarios honestos sobre esta idea de negocio: [describe your concept]. ¿Qué te excitaría de esto? ¿Qué preocupaciones tendrías? ¿Cuánto pagarías de manera realista? ¿Qué necesitaría cambiar para que se convierta en un cliente? “

Los empresarios adolescentes a menudo luchan con la investigación de los clientes porque no pueden encuestar fácilmente a grandes grupos o contratar firmas de investigación de mercado. Este aviso ayuda a simular los comentarios de los clientes haciendo que ChatGPT adopte personas específicas.

Un adolescente que desarrolla un podcast para atletas adolescentes podría usar este enfoque pidiéndole a ChatGPT que responda a diferentes tipos de atletas adolescentes. Esto ayuda a identificar temas de contenido que resuenan y mensajes que se sienten auténticos para el público objetivo.

El aviso funciona mejor cuando se vuelve específico sobre la demografía, los puntos débiles y los contextos. “Actúa como un estudiante de último año de secundaria que solicita a la universidad” produce mejores ideas que “actuar como un adolescente”.

4. El mensaje mínimo de diseñador de prueba viable chatgpt

“Quiero probar esta idea de negocio: [describe concept] sin gastar más de [budget amount] o más de [time commitment]. Diseñe tres experimentos simples que podría ejecutar esta semana para validar la demanda de los clientes. Para cada prueba, explique lo que aprendería, cómo medir el éxito y qué resultados indicarían que debería avanzar “.

Este aviso ayuda a los adolescentes a adoptar la metodología Lean Startup sin perderse en la jerga comercial. El enfoque en “This Week” crea urgencia y evita la planificación interminable sin acción.

Un adolescente que desea probar un concepto de línea de ropa podría usar este indicador para diseñar experimentos de validación simples, como publicar maquetas de diseño en las redes sociales para evaluar el interés, crear un formulario de Google para recolectar pedidos anticipados y pedirles a los amigos que compartan el concepto con sus redes. Estas pruebas no cuestan nada más que proporcionar datos cruciales sobre la demanda y los precios.

5. El aviso de chatgpt del generador de claridad de tono

“Convierta esta idea de negocio en una clara explicación de 60 segundos: [describe your business]. La explicación debe incluir: el problema que resuelve, su solución, a quién ayuda, por qué lo elegirían sobre las alternativas y cómo se ve el éxito. Escríbelo en lenguaje de conversación que un adolescente realmente usaría “.

La comunicación clara separa a los empresarios exitosos de aquellos con buenas ideas pero una ejecución deficiente. Este aviso ayuda a los adolescentes a destilar conceptos complejos a explicaciones convincentes que pueden usar en todas partes, desde las publicaciones en las redes sociales hasta las conversaciones con posibles mentores.

El énfasis en el “lenguaje de conversación que un adolescente realmente usaría” es importante. Muchas plantillas de lanzamiento comercial suenan artificiales cuando se entregan jóvenes fundadores. La autenticidad es más importante que la jerga corporativa.

Más allá de las indicaciones de chatgpt: estrategia de implementación

La diferencia entre los adolescentes que usan estas indicaciones de manera efectiva y aquellos que no se reducen a seguir. ChatGPT proporciona dirección, pero la acción crea resultados.

Los jóvenes empresarios más exitosos con los que trabajo usan estas indicaciones como puntos de partida, no de punto final. Toman las sugerencias generadas por IA e inmediatamente las prueban en el mundo real. Llaman a clientes potenciales, crean prototipos simples e iteran en función de los comentarios reales.

Investigaciones recientes de Junior Achievement muestran que el 69% de los adolescentes tienen ideas de negocios, pero se sienten inciertos sobre el proceso de partida, con el miedo a que el fracaso sea la principal preocupación para el 67% de los posibles empresarios adolescentes. Estas indicaciones abordan esa incertidumbre al desactivar los conceptos abstractos en los próximos pasos concretos.

La imagen más grande

Los emprendedores adolescentes que utilizan herramientas de IA como ChatGPT representan un cambio en cómo está ocurriendo la educación empresarial. Según la investigación mundial de monitores empresariales, los jóvenes empresarios tienen 1,6 veces más probabilidades que los adultos de querer comenzar un negocio, y son particularmente activos en la tecnología, la alimentación y las bebidas, la moda y los sectores de entretenimiento. En lugar de esperar clases de emprendimiento formales o programas de MBA, estos jóvenes fundadores están accediendo a herramientas de pensamiento estratégico de inmediato.

Esta tendencia se alinea con cambios más amplios en la educación y la fuerza laboral. El Foro Económico Mundial identifica la creatividad, el pensamiento crítico y la resiliencia como las principales habilidades para 2025, la capacidad de las capacidades que el espíritu empresarial desarrolla naturalmente.

Programas como WIT brindan soporte estructurado para este viaje, pero las herramientas en sí mismas se están volviendo cada vez más accesibles. Un adolescente con acceso a Internet ahora puede acceder a recursos de planificación empresarial que anteriormente estaban disponibles solo para empresarios establecidos con presupuestos significativos.

La clave es usar estas herramientas cuidadosamente. ChatGPT puede acelerar el pensamiento y proporcionar marcos, pero no puede reemplazar el arduo trabajo de construir relaciones, crear productos y servir a los clientes. La mejor idea de negocio no es la más original, es la que resuelve un problema real para personas reales. Las herramientas de IA pueden ayudar a identificar esas oportunidades, pero solo la acción puede convertirlos en empresas que importan.

Noticias

Chatgpt vs. gemini: he probado ambos, y uno definitivamente es mejor

Published

10 meses agoon

5 junio, 2025

Precio

ChatGPT y Gemini tienen versiones gratuitas que limitan su acceso a características y modelos. Los planes premium para ambos también comienzan en alrededor de $ 20 por mes. Las características de chatbot, como investigaciones profundas, generación de imágenes y videos, búsqueda web y más, son similares en ChatGPT y Gemini. Sin embargo, los planes de Gemini pagados también incluyen el almacenamiento en la nube de Google Drive (a partir de 2TB) y un conjunto robusto de integraciones en las aplicaciones de Google Workspace.

Los niveles de más alta gama de ChatGPT y Gemini desbloquean el aumento de los límites de uso y algunas características únicas, pero el costo mensual prohibitivo de estos planes (como $ 200 para Chatgpt Pro o $ 250 para Gemini Ai Ultra) los pone fuera del alcance de la mayoría de las personas. Las características específicas del plan Pro de ChatGPT, como el modo O1 Pro que aprovecha el poder de cálculo adicional para preguntas particularmente complicadas, no son especialmente relevantes para el consumidor promedio, por lo que no sentirá que se está perdiendo. Sin embargo, es probable que desee las características que son exclusivas del plan Ai Ultra de Gemini, como la generación de videos VEO 3.

Ganador: Géminis

Plataformas

Puede acceder a ChatGPT y Gemini en la web o a través de aplicaciones móviles (Android e iOS). ChatGPT también tiene aplicaciones de escritorio (macOS y Windows) y una extensión oficial para Google Chrome. Gemini no tiene aplicaciones de escritorio dedicadas o una extensión de Chrome, aunque se integra directamente con el navegador.

(Crédito: OpenAI/PCMAG)

Chatgpt está disponible en otros lugares, Como a través de Siri. Como se mencionó, puede acceder a Gemini en las aplicaciones de Google, como el calendario, Documento, ConducirGmail, Mapas, Mantener, FotosSábanas, y Música de YouTube. Tanto los modelos de Chatgpt como Gemini también aparecen en sitios como la perplejidad. Sin embargo, obtiene la mayor cantidad de funciones de estos chatbots en sus aplicaciones y portales web dedicados.

Las interfaces de ambos chatbots son en gran medida consistentes en todas las plataformas. Son fáciles de usar y no lo abruman con opciones y alternar. ChatGPT tiene algunas configuraciones más para jugar, como la capacidad de ajustar su personalidad, mientras que la profunda interfaz de investigación de Gemini hace un mejor uso de los bienes inmuebles de pantalla.

Ganador: empate

Modelos de IA

ChatGPT tiene dos series primarias de modelos, la serie 4 (su línea de conversación, insignia) y la Serie O (su compleja línea de razonamiento). Gemini ofrece de manera similar una serie Flash de uso general y una serie Pro para tareas más complicadas.

Los últimos modelos de Chatgpt son O3 y O4-Mini, y los últimos de Gemini son 2.5 Flash y 2.5 Pro. Fuera de la codificación o la resolución de una ecuación, pasará la mayor parte de su tiempo usando los modelos de la serie 4-Series y Flash. A continuación, puede ver cómo funcionan estos modelos en una variedad de tareas. Qué modelo es mejor depende realmente de lo que quieras hacer.

Ganador: empate

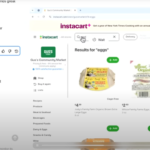

Búsqueda web

ChatGPT y Gemini pueden buscar información actualizada en la web con facilidad. Sin embargo, ChatGPT presenta mosaicos de artículos en la parte inferior de sus respuestas para una lectura adicional, tiene un excelente abastecimiento que facilita la vinculación de reclamos con evidencia, incluye imágenes en las respuestas cuando es relevante y, a menudo, proporciona más detalles en respuesta. Gemini no muestra nombres de fuente y títulos de artículos completos, e incluye mosaicos e imágenes de artículos solo cuando usa el modo AI de Google. El abastecimiento en este modo es aún menos robusto; Google relega las fuentes a los caretes que se pueden hacer clic que no resaltan las partes relevantes de su respuesta.

Como parte de sus experiencias de búsqueda en la web, ChatGPT y Gemini pueden ayudarlo a comprar. Si solicita consejos de compra, ambos presentan mosaicos haciendo clic en enlaces a los minoristas. Sin embargo, Gemini generalmente sugiere mejores productos y tiene una característica única en la que puede cargar una imagen tuya para probar digitalmente la ropa antes de comprar.

Ganador: chatgpt

Investigación profunda

ChatGPT y Gemini pueden generar informes que tienen docenas de páginas e incluyen más de 50 fuentes sobre cualquier tema. La mayor diferencia entre los dos se reduce al abastecimiento. Gemini a menudo cita más fuentes que CHATGPT, pero maneja el abastecimiento en informes de investigación profunda de la misma manera que lo hace en la búsqueda en modo AI, lo que significa caretas que se puede hacer clic sin destacados en el texto. Debido a que es más difícil conectar las afirmaciones en los informes de Géminis a fuentes reales, es más difícil creerles. El abastecimiento claro de ChatGPT con destacados en el texto es más fácil de confiar. Sin embargo, Gemini tiene algunas características de calidad de vida en ChatGPT, como la capacidad de exportar informes formateados correctamente a Google Docs con un solo clic. Su tono también es diferente. Los informes de ChatGPT se leen como publicaciones de foro elaboradas, mientras que los informes de Gemini se leen como documentos académicos.

Ganador: chatgpt

Generación de imágenes

La generación de imágenes de ChatGPT impresiona independientemente de lo que solicite, incluso las indicaciones complejas para paneles o diagramas cómicos. No es perfecto, pero los errores y la distorsión son mínimos. Gemini genera imágenes visualmente atractivas más rápido que ChatGPT, pero rutinariamente incluyen errores y distorsión notables. Con indicaciones complicadas, especialmente diagramas, Gemini produjo resultados sin sentido en las pruebas.

Arriba, puede ver cómo ChatGPT (primera diapositiva) y Géminis (segunda diapositiva) les fue con el siguiente mensaje: “Genere una imagen de un estudio de moda con una decoración simple y rústica que contrasta con el espacio más agradable. Incluya un sofá marrón y paredes de ladrillo”. La imagen de ChatGPT limita los problemas al detalle fino en las hojas de sus plantas y texto en su libro, mientras que la imagen de Gemini muestra problemas más notables en su tubo de cordón y lámpara.

Ganador: chatgpt

¡Obtenga nuestras mejores historias!

Toda la última tecnología, probada por nuestros expertos

Regístrese en el boletín de informes de laboratorio para recibir las últimas revisiones de productos de PCMAG, comprar asesoramiento e ideas.

Al hacer clic en Registrarme, confirma que tiene más de 16 años y acepta nuestros Términos de uso y Política de privacidad.

¡Gracias por registrarse!

Su suscripción ha sido confirmada. ¡Esté atento a su bandeja de entrada!

Generación de videos

La generación de videos de Gemini es la mejor de su clase, especialmente porque ChatGPT no puede igualar su capacidad para producir audio acompañante. Actualmente, Google bloquea el último modelo de generación de videos de Gemini, VEO 3, detrás del costoso plan AI Ultra, pero obtienes más videos realistas que con ChatGPT. Gemini también tiene otras características que ChatGPT no, como la herramienta Flow Filmmaker, que le permite extender los clips generados y el animador AI Whisk, que le permite animar imágenes fijas. Sin embargo, tenga en cuenta que incluso con VEO 3, aún necesita generar videos varias veces para obtener un gran resultado.

En el ejemplo anterior, solicité a ChatGPT y Gemini a mostrarme un solucionador de cubos de Rubik Rubik que resuelva un cubo. La persona en el video de Géminis se ve muy bien, y el audio acompañante es competente. Al final, hay una buena atención al detalle con el marco que se desplaza, simulando la detención de una grabación de selfies. Mientras tanto, Chatgpt luchó con su cubo, distorsionándolo en gran medida.

Ganador: Géminis

Procesamiento de archivos

Comprender los archivos es una fortaleza de ChatGPT y Gemini. Ya sea que desee que respondan preguntas sobre un manual, editen un currículum o le informen algo sobre una imagen, ninguno decepciona. Sin embargo, ChatGPT tiene la ventaja sobre Gemini, ya que ofrece un reconocimiento de imagen ligeramente mejor y respuestas más detalladas cuando pregunta sobre los archivos cargados. Ambos chatbots todavía a veces inventan citas de documentos proporcionados o malinterpretan las imágenes, así que asegúrese de verificar sus resultados.

Ganador: chatgpt

Escritura creativa

Chatgpt y Gemini pueden generar poemas, obras, historias y más competentes. CHATGPT, sin embargo, se destaca entre los dos debido a cuán únicas son sus respuestas y qué tan bien responde a las indicaciones. Las respuestas de Gemini pueden sentirse repetitivas si no calibra cuidadosamente sus solicitudes, y no siempre sigue todas las instrucciones a la carta.

En el ejemplo anterior, solicité ChatGPT (primera diapositiva) y Gemini (segunda diapositiva) con lo siguiente: “Sin hacer referencia a nada en su memoria o respuestas anteriores, quiero que me escriba un poema de verso gratuito. Preste atención especial a la capitalización, enjambment, ruptura de línea y puntuación. Dado que es un verso libre, no quiero un medidor familiar o un esquema de retiro de la rima, pero quiero que tenga un estilo de coohes. ChatGPT logró entregar lo que pedí en el aviso, y eso era distinto de las generaciones anteriores. Gemini tuvo problemas para generar un poema que incorporó cualquier cosa más allá de las comas y los períodos, y su poema anterior se lee de manera muy similar a un poema que generó antes.

Recomendado por nuestros editores

Ganador: chatgpt

Razonamiento complejo

Los modelos de razonamiento complejos de Chatgpt y Gemini pueden manejar preguntas de informática, matemáticas y física con facilidad, así como mostrar de manera competente su trabajo. En las pruebas, ChatGPT dio respuestas correctas un poco más a menudo que Gemini, pero su rendimiento es bastante similar. Ambos chatbots pueden y le darán respuestas incorrectas, por lo que verificar su trabajo aún es vital si está haciendo algo importante o tratando de aprender un concepto.

Ganador: chatgpt

Integración

ChatGPT no tiene integraciones significativas, mientras que las integraciones de Gemini son una característica definitoria. Ya sea que desee obtener ayuda para editar un ensayo en Google Docs, comparta una pestaña Chrome para hacer una pregunta, pruebe una nueva lista de reproducción de música de YouTube personalizada para su gusto o desbloquee ideas personales en Gmail, Gemini puede hacer todo y mucho más. Es difícil subestimar cuán integrales y poderosas son realmente las integraciones de Géminis.

Ganador: Géminis

Asistentes de IA

ChatGPT tiene GPT personalizados, y Gemini tiene gemas. Ambos son asistentes de IA personalizables. Tampoco es una gran actualización sobre hablar directamente con los chatbots, pero los GPT personalizados de terceros agregan una nueva funcionalidad, como el fácil acceso a Canva para editar imágenes generadas. Mientras tanto, terceros no pueden crear gemas, y no puedes compartirlas. Puede permitir que los GPT personalizados accedan a la información externa o tomen acciones externas, pero las GEM no tienen una funcionalidad similar.

Ganador: chatgpt

Contexto Windows y límites de uso

La ventana de contexto de ChatGPT sube a 128,000 tokens en sus planes de nivel superior, y todos los planes tienen límites de uso dinámicos basados en la carga del servidor. Géminis, por otro lado, tiene una ventana de contexto de 1,000,000 token. Google no está demasiado claro en los límites de uso exactos para Gemini, pero también son dinámicos dependiendo de la carga del servidor. Anecdóticamente, no pude alcanzar los límites de uso usando los planes pagados de Chatgpt o Gemini, pero es mucho más fácil hacerlo con los planes gratuitos.

Ganador: Géminis

Privacidad

La privacidad en Chatgpt y Gemini es una bolsa mixta. Ambos recopilan cantidades significativas de datos, incluidos todos sus chats, y usan esos datos para capacitar a sus modelos de IA de forma predeterminada. Sin embargo, ambos le dan la opción de apagar el entrenamiento. Google al menos no recopila y usa datos de Gemini para fines de capacitación en aplicaciones de espacio de trabajo, como Gmail, de forma predeterminada. ChatGPT y Gemini también prometen no vender sus datos o usarlos para la orientación de anuncios, pero Google y OpenAI tienen historias sórdidas cuando se trata de hacks, filtraciones y diversos fechorías digitales, por lo que recomiendo no compartir nada demasiado sensible.

Ganador: empate

Related posts

Trending

-

Startups2 años ago

Startups2 años agoRemove.bg: La Revolución en la Edición de Imágenes que Debes Conocer

-

Tutoriales2 años ago

Tutoriales2 años agoCómo Comenzar a Utilizar ChatGPT: Una Guía Completa para Principiantes

-

Startups2 años ago

Startups2 años agoDeepgram: Revolucionando el Reconocimiento de Voz con IA

-

Startups2 años ago

Startups2 años agoStartups de IA en EE.UU. que han recaudado más de $100M en 2024

-

Recursos2 años ago

Recursos2 años agoCómo Empezar con Popai.pro: Tu Espacio Personal de IA – Guía Completa, Instalación, Versiones y Precios

-

Recursos2 años ago

Recursos2 años agoPerplexity aplicado al Marketing Digital y Estrategias SEO

-

Estudiar IA2 años ago

Estudiar IA2 años agoCurso de Inteligencia Artificial Aplicada de 4Geeks Academy 2024

-

Noticias2 años ago

Noticias2 años agoDos periodistas octogenarios deman a ChatGPT por robar su trabajo