OpenAI, la empresa de inteligencia artificial que desarrolló el popular chatbot ChatGPT y el programa de conversión de texto a arte Dall-E, se encuentra en una encrucijada. El 2 de octubre de 2024, anunció que había obtenido 6.600 millones de dólares en nueva financiación de inversores y que el negocio valía un valor estimado de 157.000 millones de dólares, lo que la convierte en la segunda startup valorada en más de 100.000 millones de dólares.

A diferencia de otras grandes empresas de tecnología, OpenAI es una organización sin fines de lucro con una subsidiaria con fines de lucro supervisada por una junta directiva sin fines de lucro. Desde su fundación en 2015, la misión oficial de OpenAI ha sido “construir inteligencia artificial general (AGI) que sea segura y beneficie a toda la humanidad”.

A finales de septiembre de 2024, The Associated Press, Reuters, The Wall Street Journal y muchos otros medios de comunicación informaron que OpenAI planea descartar su condición de organización sin fines de lucro y convertirse en una empresa tecnológica con fines de lucro administrada por inversores. Todas estas historias han citado fuentes anónimas. El New York Times, haciendo referencia a documentos de la reciente ronda de financiación, informó que a menos que este cambio se produzca dentro de dos años, los 6.600 millones de dólares en capital se convertirían en deuda con los inversores que proporcionaron esa financiación.

The Conversation US pidió a Alnoor Ebrahim, un académico de gestión de la Universidad de Tufts, que explicara por qué los planes informados por los líderes de OpenAI para cambiar su estructura serían significativos y potencialmente problemáticos.

¿Cómo han respondido sus altos ejecutivos y miembros de la junta directiva?

Ha habido mucha agitación en el liderazgo en OpenAI. Los desacuerdos estallaron en noviembre de 2023, cuando su junta directiva destituyó brevemente a Sam Altman, su director ejecutivo. Recuperó su puesto en menos de una semana y luego tres miembros de la junta dimitieron. Los directores salientes abogaron por construir barandillas más fuertes y alentar la regulación para proteger a la humanidad de los posibles daños que plantea la IA.

Más de una docena de miembros del personal de alto nivel han renunciado desde entonces, incluidos varios otros cofundadores y ejecutivos responsables de supervisar las políticas y prácticas de seguridad de OpenAI. Al menos dos de ellos se han unido a Anthropic, un rival fundado por un ex ejecutivo de OpenAI responsable de la seguridad de la IA. Algunos de los ejecutivos salientes dicen que Altman ha presionado a la empresa para que lance productos prematuramente.

La seguridad “ha pasado a un segundo plano frente a los productos brillantes”, dijo el exlíder del equipo de seguridad de OpenAI, Jan Leike, quien renunció en mayo de 2024.

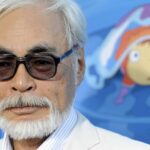

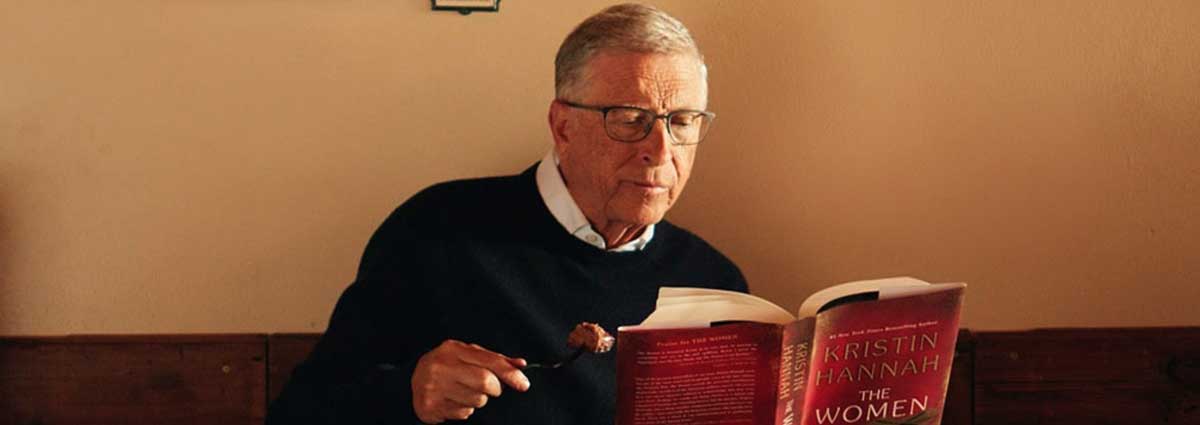

Bryan R. Smith/Foto de piscina vía AP

¿Por qué cambiaría la estructura de OpenAI?

Los inversores con mucho dinero de OpenAI no pueden poseer acciones de la organización bajo su estructura de gobierno sin fines de lucro existente, ni pueden obtener un asiento en su junta directiva. Esto se debe a que OpenAI está incorporada como una organización sin fines de lucro cuyo propósito es beneficiar a la sociedad y no a los intereses privados. Hasta ahora, todas las rondas de inversiones, incluido un total reportado de 13 mil millones de dólares de Microsoft, se han canalizado a través de una subsidiaria con fines de lucro que pertenece a la organización sin fines de lucro.

La estructura actual permite a OpenAI aceptar dinero de inversores privados a cambio de una parte futura de sus ganancias. Pero esos inversores no obtienen un asiento con derecho a voto en la junta directiva y sus ganancias están “limitadas”. Según información hecha pública anteriormente, los inversores originales de OpenAI no pueden ganar más de 100 veces el dinero que aportaron. El objetivo de este modelo de gobernanza híbrida es equilibrar las ganancias con la misión centrada en la seguridad de OpenAI.

Convertirse en una empresa con fines de lucro permitiría a sus inversores adquirir participaciones en OpenAI y ya no tener que enfrentar un límite a sus ganancias potenciales. En el futuro, OpenAI también podría salir a bolsa y recaudar capital en el mercado de valores.

Según se informa, Altman busca adquirir personalmente una participación accionaria del 7% en OpenAI, según un artículo de Bloomberg que cita fuentes anónimas.

Ese acuerdo no está permitido para ejecutivos de organizaciones sin fines de lucro, según BoardSource, una asociación de ejecutivos y miembros de juntas directivas de organizaciones sin fines de lucro. En cambio, explica la asociación, las organizaciones sin fines de lucro “deben reinvertir los excedentes en la organización y su propósito de exención de impuestos”.

¿En qué tipo de empresa podría convertirse OpenAI?

El Washington Post y otros medios de comunicación han informado, citando también fuentes anónimas, que OpenAI podría convertirse en una “corporación de beneficio público”, una empresa que apunta a beneficiar a la sociedad y obtener ganancias.

Ejemplos de empresas con este estatus, conocidas como B Corps., incluyen la empresa de ropa y equipos para actividades al aire libre Patagonia y el fabricante de gafas Warby Parker.

Es más típico que una empresa con fines de lucro –no una organización sin fines de lucro– se convierta en una corporación benéfica, según B Lab, una red que establece estándares y ofrece certificación para las Empresas B. Es inusual que una organización sin fines de lucro haga esto porque su gobernanza ya requiere que esos grupos beneficien a la sociedad.

Los directorios de empresas con esta personalidad jurídica son libres de considerar los intereses de la sociedad, el medio ambiente y las personas que no son sus accionistas, pero eso no es obligatorio. La junta aún puede optar por hacer de las ganancias una máxima prioridad y puede abandonar su estatus de beneficios para satisfacer a sus inversores. Eso es lo que hizo el mercado de artesanía en línea Etsy en 2017, dos años después de convertirse en una empresa que cotiza en bolsa.

En mi opinión, cualquier intento de convertir una organización sin fines de lucro en una corporación de beneficio público es un claro alejamiento de centrarse en la misión de la organización sin fines de lucro. Y existirá el riesgo de que convertirse en una corporación benéfica sea simplemente una estratagema para enmascarar un cambio hacia el crecimiento de los ingresos y las ganancias de los inversores.

Muchos juristas y otros expertos predicen que OpenAI no eliminará por completo su modelo de propiedad híbrida debido a las restricciones legales sobre la colocación de activos sin fines de lucro en manos privadas.

Pero creo que OpenAI tiene una posible solución: podría intentar diluir el control de la organización sin fines de lucro convirtiéndola en un accionista minoritario en una nueva estructura con fines de lucro. Esto eliminaría efectivamente el poder de la junta directiva de la organización sin fines de lucro para responsabilizar a la empresa. Tal medida podría dar lugar a una investigación por parte de la oficina del fiscal general del estado correspondiente y potencialmente por parte del Servicio de Impuestos Internos.

¿Qué podría pasar si OpenAI se convierte en una empresa con fines de lucro?

Hay mucho en juego para la sociedad.

Los daños potenciales de la IA son muy diversos y algunos ya son evidentes, como las campañas políticas engañosas y los prejuicios en la atención sanitaria.

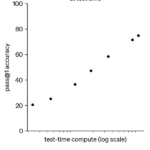

Si OpenAI, un líder de la industria, comienza a centrarse más en obtener ganancias que en garantizar la seguridad de la IA, creo que estos peligros podrían empeorar. Geoffrey Hinton, que ganó el Premio Nobel de Física 2024 por su investigación sobre inteligencia artificial, advirtió que la IA puede exacerbar la desigualdad al reemplazar “muchos trabajos mundanos”. Él cree que hay un 50% de probabilidad “de que tengamos que enfrentar el problema de que la IA intente tomar el relevo” de la humanidad.

E incluso si OpenAI retuviera a los miembros de la junta directiva para quienes la seguridad es una de las principales preocupaciones, el único denominador común para los miembros de su nueva junta corporativa sería su obligación de proteger los intereses de los accionistas de la empresa, quienes esperarían obtener ganancias. Si bien tales expectativas son comunes en una junta con fines de lucro, constituyen un conflicto de intereses en una junta sin fines de lucro donde la misión debe ser lo primero y los miembros de la junta no pueden beneficiarse financieramente del trabajo de la organización.

Sin duda, el acuerdo complacería a los inversores de OpenAI. ¿Pero sería bueno para la sociedad? El propósito del control de una organización sin fines de lucro sobre una subsidiaria con fines de lucro es garantizar que las ganancias no interfieran con la misión de la organización sin fines de lucro. Sin barreras de seguridad que garanticen que la junta busca limitar el daño que la IA causa a la humanidad, habría pocas razones para impedir que la empresa maximice sus ganancias, incluso si sus chatbots y otros productos de IA ponen en peligro a la sociedad.

Independientemente de lo que haga OpenAI, la mayoría de las empresas de inteligencia artificial ya son empresas con fines de lucro. Entonces, en mi opinión, la única manera de gestionar los daños potenciales es a través de mejores estándares y regulaciones industriales que están comenzando a tomar forma.

El gobernador de California vetó un proyecto de ley de este tipo en septiembre de 2024 con el argumento de que frenaría la innovación, pero creo que frenarla es exactamente lo que se necesita, dados los peligros que la IA ya representa para la sociedad.