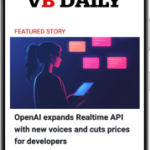

ohEl director ejecutivo de penAI, Sam Altman, publicó recientemente una publicación en su blog personal en la que reflexiona sobre el progreso de la IA y sus predicciones sobre cómo la tecnología afectará el futuro de la humanidad. “Ahora estamos seguros de que sabemos cómo construir AGI [artificial general intelligence] como lo hemos entendido tradicionalmente”, escribió Altman. Añadió que OpenAI, la empresa detrás de ChatGPT, está empezando a centrar su atención en la superinteligencia.

Si bien no existe una definición universalmente aceptada de AGI, OpenAI lo ha definido históricamente como “un sistema altamente autónomo que supera a los humanos en la mayoría de los trabajos económicamente valiosos”. Aunque los sistemas de IA ya superan a los humanos en dominios limitados, como el ajedrez, la clave para la AGI es la generalidad. Un sistema de este tipo podría, por ejemplo, gestionar un proyecto de codificación complejo de principio a fin, aprovechar conocimientos de la biología para resolver problemas de ingeniería o escribir una novela digna del Pulitzer. OpenAI dice que su misión es “garantizar que AGI beneficie a toda la humanidad”.

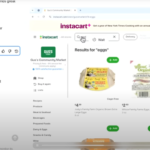

Altman indicó en su publicación que los avances en la tecnología podrían conducir a una adopción más notable de la IA en el lugar de trabajo durante el próximo año, en forma de agentes de IA: sistemas autónomos que pueden realizar tareas específicas sin intervención humana, potencialmente tomando acciones durante días al mismo tiempo. un tiempo. “En 2025, es posible que veamos a los primeros agentes de IA ‘unirse a la fuerza laboral’ y cambiar materialmente la producción de las empresas”, escribió.

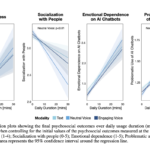

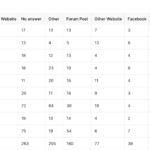

En una entrevista reciente con Bloomberg, Altman dijo que cree que “AGI probablemente se desarrollará durante [Trump’s] término”, aunque señaló su creencia de que AGI “se ha convertido en un término muy descuidado”. Los competidores también piensan que AGI está cerca: Elon Musk, cofundador de OpenAI, que dirige la startup de IA xAI, y Dario Amodei, director ejecutivo de Anthropic, dijeron que creen que los sistemas de IA podrían ser más astutos que los humanos para 2026. Investigadores hasta la fecha, que incluyeron a más de 2700 participantes, estimaron colectivamente que hay un 10% de posibilidades de que los sistemas de inteligencia artificial puedan superar a los humanos en la mayoría de las tareas para 2027, suponiendo que la ciencia continúe progresando. sin interrupción.

Otros son más escépticos. Gary Marcus, un destacado comentarista de IA, no está de acuerdo con Altman en que AGI es “básicamente un problema resuelto”, mientras que Mustafa Suleyman, CEO de Microsoft AI, ha dicho, con respecto a si se puede lograr AGI en el hardware actual, “la incertidumbre en torno a esto es tan alto, que cualquier declaración categórica me parece un poco infundada y exagerada”, citando los desafíos de la robótica como una de las causas de su escepticismo.

Microsoft y OpenAI, que tienen una asociación desde 2019, también tienen una definición financiera de AGI. Microsoft es el proveedor exclusivo de nube de OpenAI y su mayor patrocinador, habiendo invertido más de 13 mil millones de dólares en la empresa hasta la fecha. Las empresas tienen un acuerdo de que Microsoft perderá el acceso a los modelos de OpenAI una vez que se logre AGI. Según este acuerdo, que no se ha divulgado públicamente, se dice que el AGI se logra cuando un sistema de inteligencia artificial es capaz de generar las ganancias totales máximas a las que tienen derecho sus primeros inversores: una cifra que actualmente asciende a 100 mil millones de dólares. Sin embargo, en última instancia, la declaración de “AGI suficiente” queda a la “discreción razonable” de la junta directiva de OpenAI, según un informe de The Information.

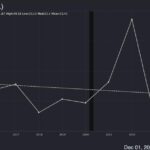

En la actualidad, OpenAI está muy lejos de ser rentable. Actualmente, la compañía pierde miles de millones de dólares al año y, según se informa, ha proyectado que sus pérdidas anuales podrían triplicarse a 14 mil millones de dólares para 2026. No espera obtener sus primeras ganancias hasta 2029, cuando espera que sus ingresos anuales puedan alcanzar los 100 mil millones de dólares. Incluso el último plan de la compañía, ChatGPT Pro, que cuesta $200 por mes y brinda a los usuarios acceso a los modelos más avanzados de la compañía, está perdiendo dinero, escribió Altman en una publicación en X. Aunque Altman no dijo explícitamente por qué la compañía está perdiendo dinero. , ejecutar modelos de IA es muy costoso y requiere inversiones en centros de datos y electricidad para proporcionar la potencia informática necesaria.

Búsqueda de superinteligencia

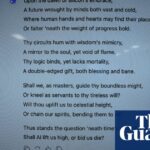

OpenAI ha dicho que AGI “podría ayudarnos a elevar a la humanidad aumentando la abundancia, impulsando la economía global y ayudando en el descubrimiento de nuevos conocimientos científicos que cambien los límites de las posibilidades”. Pero los comentarios recientes de Altman han sido algo más moderados. “Creo que alcanzaremos el AGI antes de lo que la mayoría de la gente en el mundo piensa y importará mucho menos”, dijo en diciembre. “AGI se puede construir, el mundo sigue prácticamente de la misma manera, las cosas crecen más rápido, pero luego hay una larga continuación desde lo que llamamos AGI hasta lo que llamamos superinteligencia”.

En su publicación más reciente, Altman escribió: “Estamos comenzando a llevar nuestro objetivo más allá [AGI]a la superinteligencia en el verdadero sentido de la palabra. Amamos nuestros productos actuales, pero estamos aquí para un futuro glorioso”.

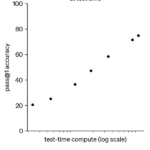

Añadió que “las herramientas superinteligentes podrían acelerar enormemente el descubrimiento científico y la innovación mucho más allá de lo que somos capaces de hacer por nuestra cuenta y, a su vez, aumentar enormemente la abundancia y la prosperidad”. Esta capacidad de acelerar el descubrimiento científico es un factor distintivo clave entre AGI y superinteligencia, al menos para Altman, quien anteriormente escribió que “es posible que tengamos superinteligencia en unos pocos miles de días”.

El concepto de superinteligencia fue popularizado por el filósofo Nick Bostrom, quien en 2014 escribió un libro superventas:Superinteligencia: caminos, peligros, estrategias—que Altman ha llamado “lo mejor [he’s] visto sobre el tema”. Bostrom define la superinteligencia como “cualquier intelecto que excede en gran medida el desempeño cognitivo de los humanos en prácticamente todos los dominios de interés” (como la AGI, pero más). “La primera AGI será sólo un punto en un continuo de inteligencia”, dijo OpenAI en una publicación de blog de 2023. “Un AGI superinteligente desalineado podría causar un daño grave al mundo; un régimen autocrático con una superinteligencia decisiva podría hacer lo mismo”.

Estos daños son inextricables de la idea de superinteligencia, porque los expertos actualmente no saben cómo alinear estos sistemas hipotéticos con los valores humanos. Tanto los sistemas AGI como los superinteligentes podrían causar daño, no necesariamente debido a intenciones maliciosas, sino simplemente porque los humanos no pueden especificar adecuadamente lo que quieren que haga el sistema. Como dijo el profesor Stuart Russell a TIME en 2024, la preocupación es que “lo que parecen ser objetivos razonables, como arreglar el cambio climático, conduzcan a consecuencias catastróficas, como eliminar a la raza humana como una forma de arreglar el cambio climático”. En su ensayo de 2015, Altman escribió que “el desarrollo de inteligencia artificial sobrehumana es probablemente la mayor amenaza para la existencia continua de la humanidad”.

Leer más: Nuevas pruebas revelan la capacidad de engaño de la IA

OpenAI ha escrito anteriormente que no sabe “cómo dirigir y controlar de forma fiable sistemas de IA sobrehumanos”. El equipo creado para liderar el trabajo de dirección de sistemas superinteligentes para la seguridad de los humanos se disolvió el año pasado, después de que sus dos codirectores abandonaran la empresa. En ese momento, uno de los codirectores, Jan Leike, escribió en X que “en los últimos años, la cultura y los procesos de seguridad han pasado a un segundo plano frente a los productos brillantes”. En la actualidad, la empresa cuenta con tres órganos de seguridad: un grupo asesor de seguridad interno, un comité de seguridad, que forma parte de la junta, y la junta de seguridad de implementación, que cuenta con miembros tanto de OpenAI como de Microsoft, y aprueba el despliegue de modelos. por encima de un cierto nivel de capacidad. Altman ha dicho que están trabajando para optimizar sus procesos de seguridad.

Leer más: Los modelos de IA son cada vez más inteligentes. Nuevas pruebas corren para ponerse al día

Cuando se le preguntó en X si cree que se debería preguntar al público si quiere superinteligencia, Altman respondió: “Sí, realmente quiero; Espero que podamos iniciar mucho más debate público muy pronto sobre cómo abordar esto”. OpenAI ha enfatizado anteriormente que la misión de la compañía es construir AGI, no superinteligencia, pero la reciente publicación de Altman sugiere que esa postura podría haber cambiado.

Al discutir los riesgos de la IA en la reciente entrevista de Bloomberg, Altman dijo que todavía espera “que en materia de ciberseguridad y biotecnología, veamos problemas serios, o potencialmente serios, a corto plazo que necesitan mitigación”, y que los riesgos a largo plazo son más difíciles. imaginar precisamente. “Puedo pensar simultáneamente que estos riesgos son reales y también creer que la única forma de abordarlos adecuadamente es enviar productos y aprender”, dijo.

Aprendizajes de su breve derrocamiento

Al reflexionar sobre los últimos años, Altman escribió que “han sido los años más gratificantes, divertidos, mejores, interesantes, agotadores, estresantes y, particularmente durante los dos últimos, desagradables de mi vida hasta ahora”.

Profundizando en su breve destitución en noviembre de 2023 como director ejecutivo por parte de la junta directiva de OpenAI y su posterior regreso a la empresa, Altman calificó el evento como “un gran fracaso de la gobernanza por parte de personas bien intencionadas, incluido yo mismo”, y señaló que deseaba haber hecho las cosas. diferentemente. En su reciente entrevista con Bloomberg, amplió esto y dijo que se arrepiente inicialmente de haber dicho que solo regresaría a la empresa si toda la junta directiva renunciara. También dijo que hubo un “verdadero engaño” por parte de la junta, que lo acusó de no ser “consistentemente sincero” en sus tratos con ellos. Helen Toner y Tasha McCauley, miembros de la junta directiva en ese momento, escribieron más tarde que los altos directivos de la empresa se habían acercado a ellos con la preocupación de que Altman hubiera cultivado una “cultura tóxica de la mentira” y se hubiera involucrado en un comportamiento que podría llamarse “abuso psicológico”. .”

Los actuales miembros de la junta directiva, Bret Taylor y Larry Summers, rechazaron las afirmaciones de Toner y McCauley y señalaron una investigación del despido por parte del bufete de abogados WilmerHale en nombre de la empresa. Escribieron en un artículo de opinión que “encontraron al señor Altman muy comunicativo en todos los temas relevantes y consistentemente colegiado con su equipo directivo”.

La revisión atribuyó la destitución de Altman a “una ruptura en la relación y pérdida de confianza entre la Junta anterior y el Sr. Altman”, en lugar de preocupaciones sobre la seguridad del producto o el ritmo de desarrollo. Al comentar sobre el período posterior a su regreso como director ejecutivo, Altman le dijo a Bloomberg: “Fue como otra investigación del gobierno, otro antiguo miembro de la junta filtrando noticias falsas a la prensa. Y todas esas personas que siento que realmente me jodieron y jodieron a la compañía se habían ido, y ahora tenía que limpiar su desastre”. No especificó qué quiso decir con “noticias falsas”.

Al escribir sobre lo que le enseñó la experiencia, Altman dijo que había “aprendido la importancia de una junta con puntos de vista diversos y amplia experiencia en la gestión de un conjunto complejo de desafíos. La buena gobernanza requiere mucha confianza y credibilidad”.

Desde finales de 2023, muchos de los principales investigadores de las empresas, incluido su cofundador y entonces científico jefe, Ilya Sutskever, su directora de tecnología, Mira Murati, y Alec Radford, autor principal del artículo fundamental que introdujo GPT, han abandonado la empresa.

Leer más: Cronología de las recientes acusaciones formuladas contra OpenAI, Sam Altman

En diciembre, OpenAI anunció planes para reestructurarse como una corporación de beneficio público, lo que eliminaría a la empresa del control de la organización sin fines de lucro que intentó despedir a Altman. La organización sin fines de lucro recibiría acciones de la nueva empresa, aunque el valor aún se está negociando.

Reconociendo que algunos podrían considerar la discusión sobre superinteligencia como “una locura”, Altman escribió: “Estamos bastante seguros de que en los próximos años todos verán lo que nosotros vemos, y que la necesidad de actuar con mucho cuidado, sin dejar de maximizar la amplitud beneficio y empoderamiento es muy importante”, y agrega: “Dadas las posibilidades de nuestro trabajo, OpenAI no puede ser una empresa normal”.