Si 2023 fue un año de maravillas sobre la inteligencia artificial, 2024 fue el año para intentar que esa maravilla haga algo útil sin arruinarse.

Hubo un “paso de producir modelos a construir productos”, dijo Arvind Narayanan, profesor de informática de la Universidad de Princeton y coautor del nuevo libro “AI Snake Oil: What Artificial Intelligence Can Do, What It Can’t, y Cómo notar la diferencia”.

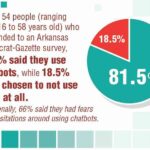

Los primeros 100 millones de personas que experimentaron con ChatGPT tras su lanzamiento hace dos años buscaron activamente el chatbot, encontrándolo increíblemente útil en algunas tareas o ridículamente mediocre en otras.

Ahora, esta tecnología de IA generativa está integrada en un número cada vez mayor de servicios tecnológicos, ya sea que la busquemos o no, por ejemplo, a través de las respuestas generadas por IA en los resultados de búsqueda de Google o nuevas técnicas de IA en las herramientas de edición de fotografías.

“El principal problema de la IA generativa el año pasado es que las empresas lanzaban estos modelos realmente potentes sin una manera concreta de que la gente pudiera utilizarlos”, afirmó Narayanan. “Lo que estamos viendo este año es la construcción gradual de estos productos que pueden aprovechar esas capacidades y hacer cosas útiles para las personas”.

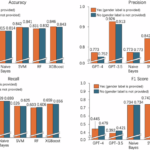

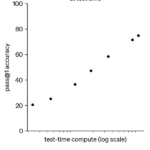

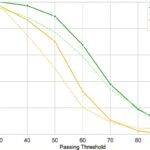

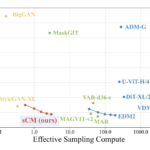

Al mismo tiempo, desde que OpenAI lanzó GPT-4 en marzo de 2023 y los competidores introdujeron modelos de lenguaje grande de IA con rendimiento similar, estos modelos han dejado de volverse significativamente “más grandes y cualitativamente mejores”, restableciendo expectativas exageradas de que la IA corría cada pocos meses hacia algún tipo. de inteligencia mejor que la humana, dijo Narayanan. Eso también significó que el discurso público ha cambiado de “¿nos va a matar la IA?”. a tratarla como una tecnología normal, dijo.

El impacto de la pegatina de la IA

En las llamadas trimestrales sobre resultados de este año, los ejecutivos de tecnología a menudo escucharon preguntas de analistas de Wall Street que buscaban garantías de beneficios futuros del enorme gasto en investigación y desarrollo de IA. Construir sistemas de IA detrás de herramientas de IA generativa como ChatGPT de OpenAI o Gemini de Google requiere invertir en sistemas informáticos que consumen mucha energía y se ejecutan en chips de IA potentes y costosos. Requieren tanta electricidad que los gigantes tecnológicos anunciaron acuerdos este año para aprovechar la energía nuclear para ayudar a operarlos.

“Estamos hablando de cientos de miles de millones de dólares de capital que se han invertido en esta tecnología”, dijo Kash Rangan, analista de Goldman Sachs.

Otro analista del banco de inversión de Nueva York llamó la atención durante el verano al argumentar que la IA no está resolviendo los problemas complejos que justificarían sus costos. También cuestionó si los modelos de IA, incluso cuando se entrenan con gran parte de los datos escritos y visuales producidos a lo largo de la historia humana, algún día podrán hacer lo que los humanos hacen tan bien. Rangan tiene una visión más optimista.

“Teníamos la fascinación de que esta tecnología iba a ser absolutamente revolucionaria, algo que no había sido en los dos años transcurridos desde la introducción de ChatGPT”, dijo Rangan. “Es más caro de lo que pensábamos y no es tan productivo como pensábamos”.

Rangan, sin embargo, sigue siendo optimista sobre su potencial y dice que las herramientas de inteligencia artificial ya están demostrando ser “absolutamente cada vez más productivas” en ventas, diseño y otras profesiones.

IA y tu trabajo

Algunos trabajadores se preguntan si las herramientas de IA se utilizarán para complementar su trabajo o para reemplazarlas a medida que la tecnología siga creciendo. La empresa de tecnología Borderless AI ha estado utilizando un chatbot de inteligencia artificial de Cohere para redactar contratos de trabajo para trabajadores en Turquía o India sin la ayuda de abogados o traductores externos.

Los artistas de videojuegos del Screen Actors Guild-American Federation of Television and Radio Artists que se declararon en huelga en julio dijeron que temían que la IA pudiera reducir o eliminar las oportunidades laborales porque podría usarse para replicar una actuación en varios otros movimientos sin su consentimiento. . Las preocupaciones sobre cómo los estudios de cine utilizarán la IA ayudaron a impulsar las huelgas de cine y televisión del año pasado por parte del sindicato, que duraron cuatro meses. Las empresas de juegos también firmaron acuerdos paralelos con el sindicato que codifican ciertas protecciones de la IA para seguir trabajando con los actores durante la huelga.

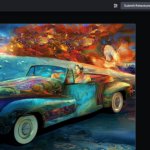

Músicos y autores han expresado preocupaciones similares sobre el hecho de que la IA esté raspando sus voces y sus libros. Pero la IA generativa todavía no puede crear trabajos únicos o “cosas completamente nuevas”, dijo Walid Saad, profesor de ingeniería eléctrica e informática y experto en IA en Virginia Tech.

“Podemos entrenarlo con más datos para que tenga más información. Pero tener más información no significa que seas más creativo”, afirmó. “Como humanos, entendemos el mundo que nos rodea, ¿verdad? Entendemos la física. Entiendes que si lanzas una pelota al suelo, rebotará. Las herramientas de IA actualmente no entienden el mundo”.

Saad señaló un meme sobre la IA como ejemplo de esa deficiencia. Cuando alguien solicitó a un motor de IA que creara una imagen de un salmón nadando en un río, dijo, la IA creó una foto de un río con trozos de salmón cortados que se encuentran en las tiendas de comestibles.

“Lo que le falta a la IA hoy es el sentido común que tenemos los humanos, y creo que ese es el siguiente paso”, afirmó.

Un ‘futuro agente’

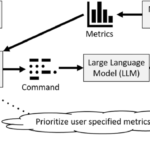

Ese tipo de razonamiento es una parte clave del proceso de hacer que las herramientas de IA sean más útiles para los consumidores, dijo Vijoy Pandey, vicepresidente senior de la división de innovación e incubación de Cisco, Outshift. Los desarrolladores de IA están presentando cada vez más la próxima ola de chatbots de IA generativa como “agentes” de IA que pueden hacer cosas más útiles en nombre de las personas.

Eso podría significar poder hacerle una pregunta ambigua a un agente de IA y hacer que el modelo sea capaz de razonar y planificar pasos para resolver un problema ambicioso, dijo Pandey. Mucha tecnología, afirmó, avanzará en esa dirección en 2025.

Pandey predice que, con el tiempo, los agentes de IA podrán unirse y realizar un trabajo de la misma manera que varias personas se unen y resuelven un problema como equipo, en lugar de simplemente realizar tareas como herramientas de IA individuales. Los agentes de IA del futuro trabajarán como un conjunto, afirmó.

El futuro software de Bitcoin, por ejemplo, probablemente dependerá del uso de agentes de software de inteligencia artificial, dijo Pandey. Cada uno de esos agentes tendrá una especialidad, dijo, con “agentes que verifican la corrección, agentes que verifican la seguridad, agentes que verifican la escala”.

“Estamos llegando a un futuro agente”, dijo. “Todos estos agentes serán muy buenos en ciertas habilidades, pero también tendrán un poco de carácter o color, porque así es como operamos”.

La IA logra avances en la medicina

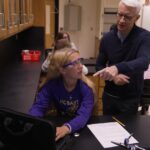

Las herramientas de inteligencia artificial también han simplificado, o en algunos casos prestado una ayuda literal, al campo médico. El Premio Nobel de Química de este año, uno de los dos Nobel otorgados a ciencias relacionadas con la IA, fue para un trabajo dirigido por Google que podría ayudar a descubrir nuevos medicamentos.

Saad, profesor de Virginia Tech, dijo que la IA ha ayudado a lograr diagnósticos más rápidos al brindarles a los médicos un punto de partida desde el cual comenzar a determinar la atención de un paciente. La IA no puede detectar enfermedades, dijo, pero puede digerir datos rápidamente y señalar áreas problemáticas potenciales para que las investigue un médico real. Sin embargo, como ocurre en otros ámbitos, plantea el riesgo de perpetuar falsedades.

El gigante tecnológico OpenAI ha promocionado su herramienta de transcripción Whisper, impulsada por IA, por tener una robustez y precisión casi “a nivel humano”, por ejemplo. Pero los expertos han dicho que Whisper tiene un defecto importante: es propenso a componer fragmentos de texto o incluso oraciones enteras.

Pandey, de Cisco, dijo que algunos de los clientes de la compañía que trabajan en productos farmacéuticos han notado que la IA ha ayudado a cerrar la brecha entre los “laboratorios húmedos”, en los que los humanos realizan investigaciones y experimentos físicos, y los “laboratorios secos”, donde las personas analizan datos y A menudo utilizamos ordenadores para modelar.

Cuando se trata de desarrollo farmacéutico, ese proceso de colaboración puede llevar varios años, dijo; con la IA, el proceso se puede reducir a unos pocos días.

“Ese, para mí, ha sido el uso más dramático”, dijo Pandey.