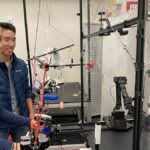

Nueva York (CNN) – ¿En la búsqueda de un nuevo trabajo? Construir tecnología de inteligencia artificial podría ser una opción segura.

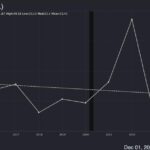

El mercado de empleos en el sector de la IA ha aumentado en los últimos dos años, según un análisis reciente de la Universidad de Maryland y la firma de seguimiento de empleo Linkup, lo último en una serie de estudios que indican que las habilidades de IA tienen una gran demanda.

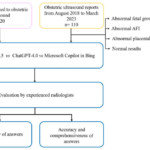

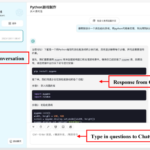

Anil Gupta, profesor de estrategia, globalización y emprendimiento en la Escuela de Negocios Smith de la Universidad de Maryland que fue co-liderada por la investigación, dijo que el análisis mostró un claro “efecto de chatgpt”, refiriéndose a cómo el lanzamiento de Chatbot desarrollado por OpenAI condujo al trabajo de trabajo, reemplazando muchas listas de trabajo relacionadas con TI.

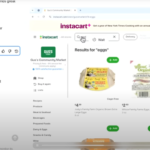

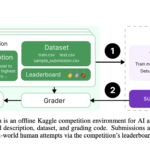

El análisis proviene de AIMAPS, una colaboración entre la Escuela de Negocios y Linkup de la Universidad de Maryland. El programa rastrea el crecimiento de los empleos de IA en diferentes sectores en los Estados Unidos, como la fabricación y el comercio minorista.

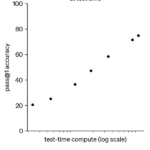

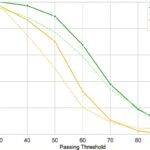

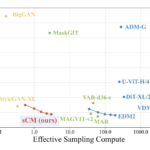

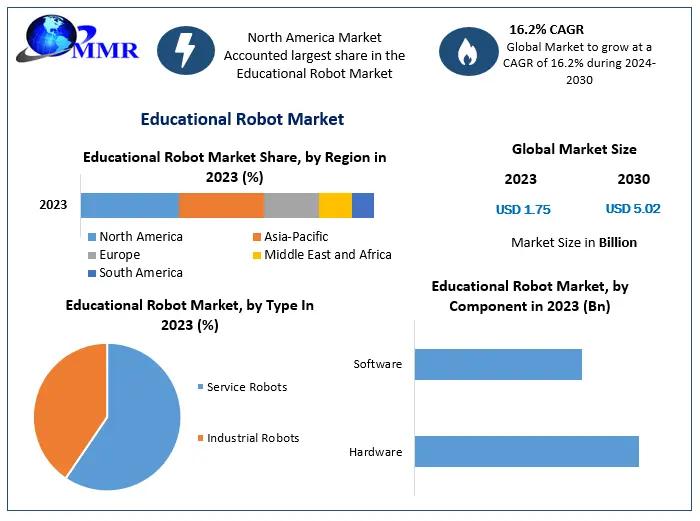

Las publicaciones de trabajo en los campos de IA han aumentado el 68% en los Estados Unidos desde finales de 2022, mientras que los registros generales de trabajo han disminuido un 17% en el mismo período, según los datos de AIMAPS. Según los datos ZipRecruiter proporcionados a CNN, las publicaciones de trabajo de IA en el sitio crecieron un 124% desde 2023 hasta el final de 2024.

En enero, LinkedIn enumeró el ingeniero de IA y el consultor de IA como los trabajos de más rápido crecimiento en los EE. UU., Y PwC encontró el año pasado que los trabajos que requirieron habilidades de IA estaban creciendo más de tres veces más rápido que todos los trabajos.

Por otro lado, las publicaciones de trabajo (incluidos los que escriben programas no relacionados con la IA) también han disminuido un 27% desde finales de 2022, según Gupta.

Si bien la IA ha resultado en algunos nuevos tipos de empleos, los gigantes tecnológicos también han reducido sus fuerzas laborales después de anunciar grandes inversiones en tecnología de IA, aunque no todos los despidos se debieron a que la IA reemplazó a los trabajadores humanos. El año pasado, Google despidió a los trabajadores en sus divisiones de asistente de Google y de hardware unos meses después de anunciar una inversión multimillonaria en la startup de IA antrópica. Y una encuesta del Foro Económico Mundial el mes pasado encontró que el 41% de los empleadores tienen la intención de reducir su fuerza laboral a favor de la IA para 2030.

“Ya sabemos que GitHub Copilot y otras herramientas de IA pueden hacer el 60-70% de la codificación”, dijo Gupta. “Cuatro personas pueden hacer el trabajo de 10”.

Ai en ascenso

La carrera global de IA solo está comenzando, como lo demuestra el reciente lanzamiento de Deepseek, una startup china que sacudió el mercado con un modelo de IA, según los informes, se desarrolló a una fracción del costo de competidores estadounidenses como ChatGPT.

Gupta dijo que el enfoque de código abierto de Deepseek, lo que significa que su arquitectura está disponible públicamente para que otras compañías lo usen y se adapten, podría acelerar el crecimiento de la industria de IA.

“Esto conducirá a un despliegue aún más rápido de la tecnología de IA en todas las industrias, ya sea desarrollo de software, servicios técnicos, banca, seguros, fabricación o agricultura”, escribió su equipo en su análisis.

Durante dos años desde que ChatGPT ayudó a provocar un boom de IA, los gigantes tecnológicos estadounidenses todavía están haciendo inversiones fuertes en sus programas de IA. En enero, Microsoft anunció planes para invertir alrededor de $ 80 mil millones en el año fiscal 2025 en los centros de datos de IA, y el presidente Donald Trump anunció la creación de Stargate, una colaboración entre OpenAi, Softbank y Oracle que planea invertir hasta $ 500 mil millones en infraestructura de IA en los próximos años.

Los trabajos de inteligencia artificial tienen una demanda especialmente alta en el sector de consultoría, dijo Gupta, ya que las empresas que no son AI generalmente contratan empresas de consultoría como Accenture y Bain para ayudar a desarrollar herramientas de IA, por ejemplo, un ingeniero de aprendizaje automático o un gerente de productos para una herramienta de IA generativa. La firma de contabilidad Ernst & Young informó en diciembre que el 97% de los líderes empresariales cuyas organizaciones invirtieron en IA vieron rendimientos positivos de la inversión.

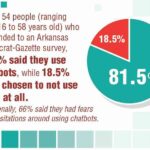

Pero muchas empresas aún pueden tardar en adoptar la tecnología en medio de posibles riesgos de privacidad y seguridad, dijo Julia Pollak, economista principal de Ziprecruiter.

Las preocupaciones de eficiencia son lo más importante para las empresas

El crecimiento del empleo de IA está ocurriendo junto con una desaceleración de los primeros en la contratación en todo el mercado laboral. Las empresas buscan cada vez más “hacer más con menos”, dijo Lisa Simon, economista jefe de Revelio Labs, que rastrea los datos de la fuerza laboral disponible públicamente.

“Han estado centralizando funciones, erradicando roles innecesarios, revisando todas las funciones y reduciendo las capas de gestión, centrándose muy estrechamente en el control de costos”, dijo Pollak de Ziprecruiter. “Ese ha sido un resultado directo de altas tasas de interés y un acceso reducido al crédito”.

A pesar de la mayor demanda de trabajos de IA, es demasiado pronto para saber cómo el auge de la IA está afectando trabajos específicos, agregó Pollak. Ella especula que los planes de contratación pueden ser “más delgados” ahora porque las herramientas de IA han hecho que algunos campos, como la escritura de contenido, sean más eficientes.

“Creemos que los trabajos que están adoptando en particular la IA están viendo disminuciones de contratación más grandes”, dijo Simon.

Los esfuerzos de las empresas para “hacer más con menos” se extienden más allá del uso de IA en el lugar de trabajo, con Revelio Labs informando la semana pasada de que las compañías estadounidenses están contratando cada vez más puestos calificados en el extranjero, especialmente aquellos que son adecuados para el trabajo remoto.

“La comprensión de que las empresas ya no necesitan contratar consultores o ingenieros de software en la ubicación más cara han hecho de una opción atractiva y de ahorro de costos en la planificación de la fuerza laboral”, dice el informe.

La industria tecnológica experimentó un rápido crecimiento durante la pandemia, ya que las empresas en persona hicieron la transición a los bienes y servicios en línea. Pero el comportamiento del consumidor y la actividad económica han vuelto a los patrones pre-pandémicos, según los datos de la Oficina de Estadísticas Laborales.

Los trabajos en el sector editorial de software crecieron un 30% desde marzo de 2020 hasta septiembre de 2022, pero se redujeron un 1% entre septiembre de 2022 y diciembre de 2024, según datos de la Oficina de Estadísticas Laborales. A nivel nacional, el crecimiento posterior a la pandemia ha sido más estable, con un aumento del 2% en los empleos entre marzo de 2020 y septiembre de 2022 y un aumento del 4% desde entonces.

En cuanto a los temores de que AI conduzca al desempleo masivo, Gupta ofreció una visión más optimista, diciendo que cree que el mundo corporativo se adaptará a la eficiencia habilitada por la tecnología.

“Hubo un momento en que una semana laboral de seis días era la norma, y ahora (tenemos una) semana laboral de cinco días”, dijo Gupta. “¿Podría ser que en 10-20 años, es una semana laboral de cuatro días? Creo que las perspectivas de eso son muy, muy altas “.

Cable

™ & © 2025 Cable News Network, Inc., una compañía de descubrimiento de Warner Bros. Reservados todos los derechos.