Chatgpt y otros chatbots de IA basados en modelos de idiomas grandes se sabe que ocasionalmente inventa cosas, incluidas las citas científicas y legales. Resulta que medir cuán precisas son las citas de un modelo AI es una buena manera de evaluar las habilidades de razonamiento del modelo.

Un modelo de IA “razones” descomponiendo una consulta en pasos y trabajando a través de ellos en orden. Piense en cómo aprendió a resolver problemas de palabras matemáticas en la escuela.

Idealmente, para generar citas, un modelo de IA comprendería los conceptos clave en un documento, generaría una lista clasificada de documentos relevantes para citar y proporcionaría un razonamiento convincente sobre cómo cada documento sugerido respalda el texto correspondiente. Destacará las conexiones específicas entre el texto y la investigación citada, aclarando por qué cada fuente importa.

La pregunta es, ¿se puede confiar en los modelos de hoy para hacer estas conexiones y proporcionar un razonamiento claro que justifique sus elecciones de origen? La respuesta va más allá de la precisión de las citas para abordar cuán útiles y precisos son los modelos de lenguaje grande para cualquier propósito de recuperación de información.

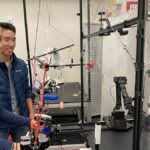

Soy un informático. Mis colegas, investigadores del Instituto AI de la Universidad de Carolina del Sur, la Universidad Estatal de Ohio y el Condado de Baltimore del Condado de Baltimore, y he desarrollado las razones de referencia para probar qué tan bien modelos de idiomas pueden generar automáticamente citas de investigación y proporcionar un razonamiento comprensible.

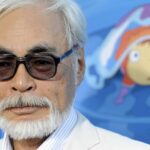

Utilizamos el punto de referencia para comparar el rendimiento de dos modelos de razonamiento de IA populares, Deepseek’s R1 y OpenAI’s O1. Aunque Deepseek fue en los titulares con su impresionante eficiencia y rentabilidad, el advenedizo chino tiene un camino por recorrer para que coincida con el rendimiento de razonamiento de OpenAI.

Oración específica

La precisión de las citas tiene mucho que ver con si el modelo AI está razonando sobre la información a nivel de oración en lugar del párrafo o a nivel de documentos. Se puede considerar que las citas a nivel de párrafo y a nivel de documentos arrojan una gran parte de la información a un modelo de idioma grande y le piden que proporcione muchas citas.

En este proceso, el modelo de lenguaje grande se generaliza e incorporan las oraciones individuales. El usuario termina con citas que explican todo el párrafo o documento, no la información de grano relativamente fino en la oración.

Además, el razonamiento sufre cuando le pide al modelo de idioma grande que lea un documento completo. Estos modelos se basan principalmente en memorizar patrones que típicamente son mejores para encontrar al principio y al final de los textos más largos que en el medio. Esto les dificulta comprender completamente toda la información importante a lo largo de un documento largo.

Los modelos de idiomas grandes se confunden porque los párrafos y documentos tienen mucha información, lo que afecta la generación de citas y el proceso de razonamiento. En consecuencia, el razonamiento de los modelos de idiomas grandes sobre los párrafos y los documentos se vuelve más como resumir o parafrasear.

Las razones por las que Benchmark aborde esta debilidad al examinar la generación y el razonamiento de las citas de los modelos de idiomas grandes.

https://www.youtube.com/watch?v=kqzzymhre0u

Prueba de citas y razonamiento

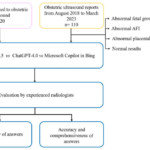

Tras el lanzamiento de Deepseek R1 en enero de 2025, queríamos examinar su precisión en la generación de citas y su calidad de razonamiento y compararlo con el modelo O1 de OpenAI. Creamos un párrafo que tenía oraciones de diferentes fuentes, dio a los modelos oraciones individuales de este párrafo y pedimos citas y razonamiento.

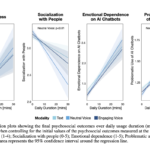

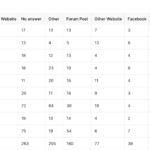

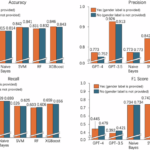

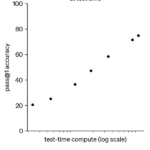

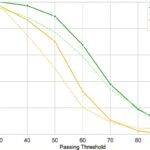

Para comenzar nuestra prueba, desarrollamos un pequeño lecho de prueba de aproximadamente 4,100 artículos de investigación alrededor de cuatro temas clave que están relacionados con el cerebro humano y la informática: neuronas y cognición, interacción humana-computadora, bases de datos e inteligencia artificial. Evaluamos los modelos utilizando dos medidas: la puntuación F-1, que mide cuán precisa es la cita proporcionada, y la tasa de alucinación, que mide cuán sonido es el razonamiento del modelo, es decir, con qué frecuencia produce una respuesta inexacta o engañosa.

Nuestras pruebas revelaron diferencias de rendimiento significativas entre OpenAI O1 y Deepseek R1 en diferentes dominios científicos. El O1 de OpenAI conectó bien la información entre los diferentes sujetos, como comprender cómo la investigación sobre neuronas y cognición se conecta con la interacción humana y la computadora y luego con los conceptos en inteligencia artificial, sin dejar de ser precisa. Sus métricas de rendimiento superaron constantemente a Deepseek R1 en todas las categorías de evaluación, especialmente para reducir las alucinaciones y completar con éxito las tareas asignadas.

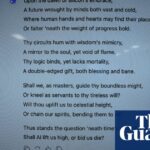

Operai O1 fue mejor para combinar ideas semánticamente, mientras que R1 se centró en asegurarse de que generara una respuesta para cada tarea de atribución, lo que a su vez aumentó la alucinación durante el razonamiento. Openai O1 tenía una tasa de alucinación de aproximadamente 35% en comparación con la tasa de Deepseek R1 de casi el 85% en la tarea de razonamiento basada en la atribución.

En términos de precisión y competencia lingüística, Openai O1 obtuvo alrededor de 0.65 en la prueba F-1, lo que significa que era correcto aproximadamente el 65% del tiempo al responder preguntas. También obtuvo alrededor de 0.70 en la prueba BLEU, que mide qué tan bien un modelo de lenguaje escribe en lenguaje natural. Estos son puntajes bastante buenos.

Deepseek R1 obtuvo un puntaje más bajo, con aproximadamente 0.35 en la prueba F-1, lo que significa que era correcto aproximadamente el 35% del tiempo. Sin embargo, su puntaje Bleu fue solo alrededor de 0.2, lo que significa que su escritura no era tan natural como la O1 de OpenAI. Esto muestra que O1 fue mejor al presentar esa información en un lenguaje claro y natural.

OpenAi tiene la ventaja

En otros puntos de referencia, Deepseek R1 se desempeña a la par con OpenAi O1 en tareas de matemáticas, codificación y razonamiento científico. Pero la diferencia sustancial en nuestro punto de referencia sugiere que O1 proporciona información más confiable, mientras que R1 lucha con la consistencia objetiva.

Aunque incluimos otros modelos en nuestras pruebas integrales, la brecha de rendimiento entre O1 y R1 resalta específicamente el panorama competitivo actual en el desarrollo de IA, con la oferta de OpenAI que mantiene una ventaja significativa en las capacidades de razonamiento e integración del conocimiento.

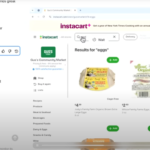

Estos resultados sugieren que OpenAi todavía tiene una ventaja cuando se trata de atribución y razonamiento de origen, posiblemente debido a la naturaleza y el volumen de los datos en los que fue entrenado. La compañía anunció recientemente su herramienta de investigación profunda, que puede crear informes con citas, hacer preguntas de seguimiento y proporcionar razonamiento para la respuesta generada.

El jurado todavía está en el valor de la herramienta para los investigadores, pero la advertencia permanece para todos: verifique todas las citas que le brinda una IA.