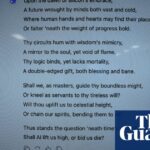

Cuando el nuevo científico reveló que había obtenido las indicaciones de ChatGPT de un ministro del Gobierno del Reino Unido a través de una solicitud de Libertad de Información (FOI), muchos en periodismo y política hicieron una doble toma. El ministro de Ciencia y Tecnología, Peter Kyle, aparentemente le había pedido al AI Chatbot que redactara un discurso, explique una política compleja y, más memorablemente, le diga en qué podcasts aparecer.

Lo que una vez parecía reflexiones privadas o uso experimental de IA ahora está firmemente en el dominio público, porque se realizó en un dispositivo gubernamental.

Es un ejemplo sorprendente de cómo se estiran las leyes de FOI en la era de la inteligencia artificial. Pero también plantea una pregunta más grande y más incómoda: ¿qué más en nuestras vidas digitales cuenta como un registro público? Si se pueden publicar indicaciones de IA, ¿deberían las búsquedas de Google las siguientes?

La Ley de Libertad de Información de Gran Bretaña se aprobó en 2000 y entró en vigor en 2005. Desde entonces, han surgido dos usos distintos de FOI. El primero, y posiblemente el más exitoso, se aplica a los registros personales. Esto le ha dado a las personas el derecho de acceder a la información que se mantiene sobre ellos, desde archivos de vivienda hasta registros de bienestar social. Es una historia de éxito tranquila que ha empoderado a los ciudadanos en sus tratos con el estado.

El segundo es lo que los periodistas usan para interrogar el funcionamiento del gobierno. Aquí, los resultados han sido irregulares en el mejor de los casos. Si bien FOI ha producido cucharadas y escándalos, también ha sido socavado por exenciones radicales, retrasos crónicos y una cultura de Whitehall que considera que la transparencia es opcional en lugar de esencial.

Tony Blair, quien presentó el acto como primer ministro, lo describió como el mayor error de su tiempo en el gobierno. Más tarde argumentó que FOI convirtió la política en “una conversación realizada con los medios de comunicación”.

Los sucesivos gobiernos se han roto contra FOI. Pocos casos ilustran esto mejor que la batalla sobre los notas de las arañas negras: cartas escritas por el entonces Príncipe (ahora Rey) Carlos a los ministros, presionando sobre temas, desde la agricultura hasta la arquitectura. El gobierno luchó durante una década para mantenerlos en secreto, citando el derecho del príncipe a los consejos confidenciales.

Leer más: contenido aburrido, pero el lanzamiento de Prince Charles Letters es un momento histórico

Cuando finalmente fueron liberados en 2015 después de un fallo de la Corte Suprema, el resultado fue ligeramente vergonzoso pero políticamente explosivo. Probó que lo que los ministros consideran la correspondencia “privada” pueden estar sujetas a escrutinio público.

El caso ChatGPT se siente como una versión moderna de ese debate. Si un político redacta ideas a través de AI, ¿es un pensamiento privado o un registro público? Si esos indican que la política de forma, seguramente el público tiene derecho a saber.

¿Las búsquedas de Google son las siguientes?

La ley de FOI es clara en el documento: cualquier información en poder de un organismo público está sujeta a liberación a menos que esté exenta. A lo largo de los años, los tribunales han dictaminado que la plataforma es irrelevante. Correo electrónico, whatsapp o notas escritas a mano: si el contenido se relaciona con los negocios oficiales y está en manos de un organismo público, es potencialmente divulgable.

El precedente se estableció en Dublín en 2017 cuando la Oficina del Primer Ministro irlandés publicó mensajes de WhatsApp al emisor de servicio público RTÉ. La Oficina del Comisionado de Información del Reino Unido también ha publicado una guía detallada que confirma que la información oficial mantenida en canales no corporativos, como correo electrónico privado, WhatsApp o Signal, está sujeta a solicitudes de FOI si se relaciona con los negocios de la autoridad pública.

La consulta en curso Covid-19 ha demostrado cómo los grupos de WhatsApp, una vez considerados backannels informales, se convirtieron en ámbitos de toma de decisiones clave en el gobierno, con mensajes de Boris Johnson, Matt Hancock y asesores principales como Dominic Cummings ahora revelados como registros oficiales.

En Australia, los mensajes de WhatsApp entre los ministros fueron examinados durante el escándalo de RobodeBT, una búsqueda ilegal de bienestar que se extendió entre 2016 y 19, mientras que la investigación de Canadá sobre las protestas del “convoy de libertad” en 2022 reveló textos y chats privados entre altos funcionarios como evidencia crucial de cómo se tomaron las decisiones.

El principio es simple: si se está haciendo el trabajo del gobierno, el público tiene derecho a verlo.

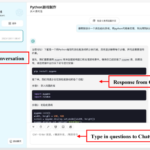

Los registros de chat de IA ahora caen en esta misma área gris. Si un funcionario o ministro usa ChatGPT para explorar las opciones de política o redactar un discurso en un dispositivo gubernamental, ese registro puede ser un registro, como lo demostraron las indicaciones de Peter Kyle.

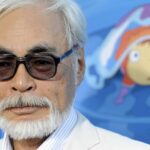

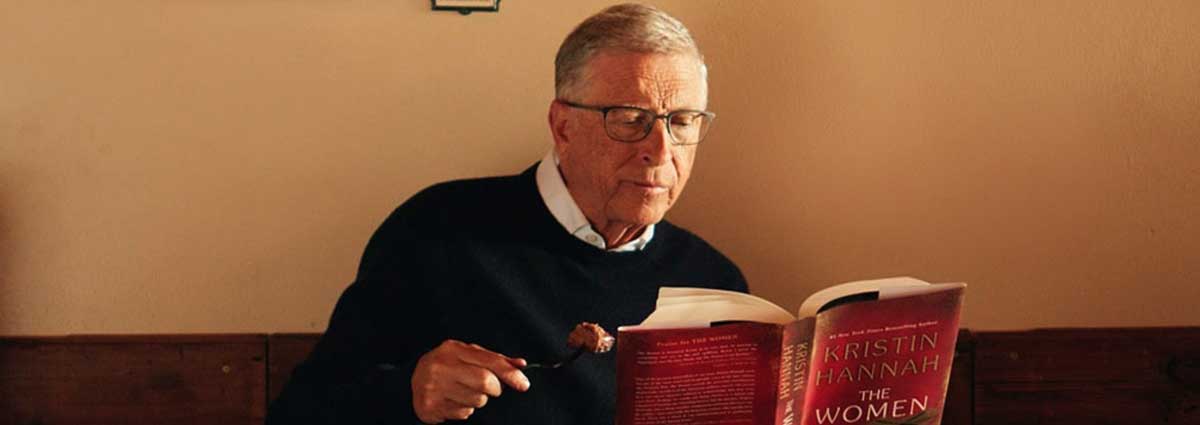

Andy Rain/Epa-Efe

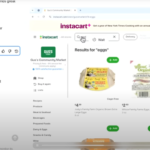

Esto abre un precedente fascinante (y ligeramente desconcertante). Si las indicaciones de AI son fáciles, ¿qué pasa con las búsquedas de Google? Si un funcionario civil tipos “cómo privatizar el NHS” en Chrome en una computadora portátil gubernamental, ¿es una consulta privada o un registro oficial?

La respuesta honesta es: no lo sabemos (todavía). FOI no ha alcanzado por completo la era digital. Las búsquedas de Google suelen ser efímeras y no se almacenan de manera rutinaria. Pero si las búsquedas se registran o se capturan en pantalla como parte del trabajo oficial, entonces podrían solicitarse.

Del mismo modo, ¿qué pasa con los borradores escritos en el asistente de escritura de IA gramatal o ideas de lluvia de ideas con Siri? Si esas herramientas se usan en dispositivos oficiales y existen registros, podrían revelarse.

Por supuesto, no hay nada que evite que este o cualquier gobierno futuro cambie la ley o apriete las reglas de FOI para excluir material como este.

Foi, periodismo y democracia

Si bien este tipo de revelaciones son fascinantes, corren el riesgo de distraer de un problema más profundo: FOI está cada vez más politizado. Las negativas ahora a menudo se basan en consideraciones políticas en lugar de la carta de la ley, con solicitudes rutinariamente retrasadas o rechazadas para evitar vergüenza. En muchos casos, el uso de los grupos de WhatsApp por parte de los ministros fue un intento deliberado de evitar el escrutinio en primer lugar.

Existe una cultura creciente de evitación de transparencia entre el gobierno y los servicios públicos, una que se extiende más allá de los ministros. Las empresas privadas que entregan contratos públicos a menudo están protegidos de FOI por completo. Mientras tanto, algunos gobiernos, incluidos Irlanda y Australia, han debilitado la ley misma.

Las herramientas de IA ya no son experimentos, se están convirtiendo en parte de cómo se desarrolla la política y se toman decisiones. Sin una supervisión adecuada, corren el riesgo de convertirse en el próximo punto ciego en la responsabilidad democrática.

Para los periodistas, este es un posible cambio de juego. Los sistemas como ChatGPT pronto pueden integrarse en los flujos de trabajo del gobierno, redactar discursos, resumir informes e incluso una estrategia de lluvia de ideas. Si las decisiones están cada vez más formadas por sugerencias algorítmicas, el público merece saber cómo y por qué.

Pero también revive un viejo dilema. La democracia depende de la transparencia, sin embargo, los funcionarios deben tener espacio para pensar, experimentar y explorar ideas sin temor a que cada consulta o borrador de IA termine en la portada. No todos los solicitantes de búsqueda o chatbot son una posición de política final.

Blair puede haber llamado a Foi un error, pero en verdad, obligó al poder a enfrentar la realidad de la responsabilidad. El verdadero desafío ahora es actualizar FOI para la era digital.