Un nuevo modelo de IA chino, creado por la startup con sede en Hangzhou, Deepseek, ha sorprendido a la industria de la IA estadounidense al superar a algunos de los principales modelos de OpenAi, desplazando a Chatgpt en la parte superior de la tienda de aplicaciones de iOS y usurpando a Meta como el principal proveedor de SOM llamadas herramientas de IA de código abierto. Todo lo cual ha planteado una pregunta crítica: a pesar de las sanciones estadounidenses a la capacidad de Beijing para acceder a semiconductores avanzados, ¿se está poniendo al día con los Estados Unidos en la carrera global de IA?

A un supuesto costo de solo $ 6 millones para entrenar, el nuevo modelo R1 de Deepseek, lanzado la semana pasada, pudo igualar el rendimiento de varias métricas de matemáticas y razonamiento del modelo O1 de OpenAi: el resultado de decenas de miles de millones de dólares en inversión por OpenAI y Su patrón Microsoft.

El modelo chino también es más barato para los usuarios. El acceso a sus versiones más poderosas cuesta un 95% menos que Operai y sus competidores. El resultado: la industria de la tecnología de los Estados Unidos se enfrenta repentinamente a un retador potencialmente más barato y más poderoso, inversores desconcertantes, que vendieron acciones tecnológicas estadounidenses el lunes por la mañana.

Sin embargo, no todos están convencidos. Algunos investigadores estadounidenses de IA han puesto en duda las afirmaciones de Deepseek sobre cuánto gastó y cuántos chips avanzados implementó para crear su modelo.

Pocos, sin embargo, disputan las impresionantes capacidades de Deepseek. “Deepseek R1 es el momento Sputnik de AI”, escribió el destacado capitalista de riesgo estadounidense Marc Andreessen en X, refiriéndose al momento en la Guerra Fría cuando la Unión Soviética logró poner un satélite en órbita por delante de los Estados Unidos.

Entonces, ¿qué es Deepseek y qué podría significar para la supremacía tecnológica estadounidense?

¿Qué es Deepseek?

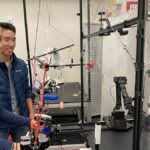

Deepseek fue fundado hace menos de dos años por el Fondo de cobertura chino High Flyer como un laboratorio de investigación dedicado a perseguir la inteligencia general artificial, o AGI. Una serie de lanzamientos de código abierto a fines de 2024 colocó la startup en el mapa, incluido el modelo de lenguaje grande “V3”, que superó a todos los LLM de código abierto de Meta y rivalizó con el GPT4-O de código cerrado de OpenAi.

Según los informes, Liang Wenfeng, el CEO, dijo que había contratado jóvenes investigadores de informática con un lanzamiento para “resolver las preguntas más difíciles del mundo”, críticamente, sin apuntar a las ganancias. eficiente que los lanzamientos de 2024 de Deepseek provocaron una guerra de precios dentro de la industria china de IA, lo que obligó a los competidores a reducir los precios.

Este año, esa guerra de precios parece llegar a través del Océano Pacífico.

Sin embargo, la IA de Deepseek se ve diferente de sus competidores estadounidenses de una manera importante. A pesar de su alto rendimiento en las pruebas de razonamiento, los modelos de Deepseek están limitados por las políticas restrictivas de China con respecto a las críticas al gobernante Partido Comunista Chino (PCCh). Deepseek R1 se niega a responder preguntas sobre la masacre en la Plaza Tiananmen, Beijing, en 1989, por ejemplo. “Lo siento, eso está más allá de mi alcance actual. Hablemos de otra cosa ”, dijo el modelo cuando se considera el tiempo.

¿Qué podría significar el éxito de Deepseek para los gigantes tecnológicos estadounidenses?

En un momento en que Google, Meta, Microsoft, Amazon y docenas de sus competidores se preparan para gastar más decenas de miles de millones de dólares en una nueva infraestructura de IA, el éxito de Deepseek ha planteado una pregunta preocupante: ¿podrían coincidir las empresas tecnológicas chinas potencialmente, o incluso superar, ¿Su destreza técnica mientras gastaba significativamente menos?

Meta, que planea gastar $ 65 mil millones en infraestructura de IA este año, ya ha establecido cuatro “salas de guerra” para analizar los modelos de Deepseek, buscando averiguar cómo la empresa china había logrado capacitar a un modelo tan barato y usar las ideas para mejorar Sus propios modelos de Llama de código abierto, sitio de noticias tecnológicas, la información informó durante el fin de semana.

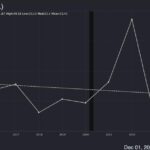

En los mercados financieros, el precio de las acciones de Nvidia cayó más del 15% el lunes por la mañana por temor a que se necesitaran menos chips de IA para capacitar a una IA poderosa de lo que se pensaba anteriormente. Otras acciones tecnológicas estadounidenses también se cotizaban más bajo.

“Mientras [DeepSeek R1] Es una buena noticia para los usuarios y la economía global, son malas noticias para las acciones tecnológicas estadounidenses ”, dice Luca Paolini, estratega jefe de Pictet Asset Management. “Puede resultar en una reducción nominal de la inversión de capital en IA y presión sobre los márgenes, en un momento en que las expectativas de valoración y crecimiento están muy estiradas”.

Pero la tecnología estadounidense no ha perdido, al menos todavía no.

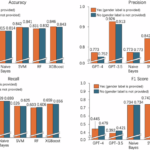

Por ahora, el modelo “O1 Pro” de Openai todavía se considera el más avanzado del mundo. Sin embargo, el rendimiento de Deepseek R1 sugiere que China está mucho más cerca de la frontera de la IA de lo que se pensaba anteriormente, y que los modelos de código abierto han alcanzado sus homólogos de código cerrado.

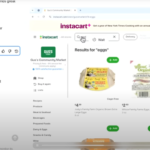

Quizás aún más preocupante para compañías como OpenAi y Google, cuyos modelos son de código cerrado, es cuánto, o más bien, cuán poco, DePseek está cobrando a los consumidores a acceder a sus modelos más avanzados. Openai cobra $ 60 por millón de “tokens”, o segmentos de palabras, generados por su modelo más avanzado, O1. Por el contrario, Deepseek cobra $ 2.19 por el mismo número de tokens de R1, casi 30 veces menos.

“Eroja la base industrial, erosiona el margen, erosiona el incentivo para una mayor inversión de capital en Western [AI] escala de fuentes privadas “, dice Edouard Harris, director de tecnología de Gladstone AI, una firma de IA que trabaja en estrecha colaboración con el gobierno de los Estados Unidos.

… ¿Pero Deepseek es transparente?

El éxito de Deepseek fue aún más explosivo porque parecía cuestionar la efectividad de la estrategia del gobierno de los Estados Unidos para restringir el ecosistema de IA de China restringiendo la exportación de fichas poderosas o GPU, a Beijing. Si las afirmaciones de Deepseek son precisas, significa que China tiene la capacidad de crear modelos de IA poderosos a pesar de esas restricciones, subrayando los límites de la estrategia de los Estados Unidos.

Deepseek ha afirmado que está limitado por el acceso a chips, no en efectivo o talento, diciendo que entrenó a sus modelos V3 y R1 utilizando solo 2,000 chips Nvidia de segundo nivel. “El dinero nunca ha sido el problema para nosotros”, dijo el CEO de Deepseek, Liang Wenfeng, en 2024. “Las prohibiciones de los envíos de chips avanzados son el problema”. (La política actual de EE. UU. Hace que sea ilegal exportar a China los tipos más avanzados de chips de IA, los gustos de los cuales pueblan centros de datos de EE. UU. Utilizados por OpenAi y Microsoft).

¿Pero son ciertas esas afirmaciones? “Entiendo que Deepseek tiene 50,000 H100”, dijo recientemente el CEO de Scale AI, Alexandr Wang, a CNBC en Davos, refiriéndose a los chips de GPU de NVIDIA mejor potenciados actualmente en el mercado. “No pueden hablar de [them]porque está en contra de los controles de exportación lo que Estados Unidos ha establecido “. (Un grupo H100 de ese tamaño costaría en la región de miles de millones de dólares).

En una señal de cuán en serio, el PCCh está tomando la tecnología, Liang, el CEO de Deepseek, se reunió con el primer ministro de China, Li Qiang en Beijing, el lunes pasado. En esa reunión, Según los informes, Liang le dijo a Li que Deepseek necesita más chips. “Deepseek solo tiene acceso a unos pocos miles de GPU, y sin embargo, están logrando esto”, dice Jeremie Harris, CEO de Gladstone AI. “Entonces, esto plantea la pregunta obvia: ¿qué sucede cuando obtienen una asignación del Partido Comunista Chino para proceder a toda velocidad?”

A pesar de que China podría haber logrado un nivel sorprendente de capacidad de IA con menos chips, los expertos dicen que más potencia informática siempre seguirá siendo una ventaja estratégica. En ese frente, Estados Unidos sigue muy por delante. “Nunca es malo tener más”, dice Dean Ball, investigador de la Universidad George Mason. “No importa cuánto tengas de él, siempre lo usarás”.

¿Dónde deja esto la rivalidad tecnológica de Estados Unidos con China?

La respuesta corta: desde la perspectiva de Washington, en aguas inciertas.

En los días finales de la administración Biden, el asesor de seguridad nacional saliente Jake Sullivan advirtió que la velocidad del avance de la IA era “lo más importante que sucedió en el mundo en este momento”. Y pocos días después de su nuevo trabajo, el presidente Trump anunció una nueva empresa de $ 500 mil millones, respaldada por Operai y otros, para construir la infraestructura vital para la creación de “inteligencia general artificial”, el próximo salto hacia adelante en la IA, con sistemas lo suficientemente avanzados para Haga nuevos avances científicos y razones de manera que hasta ahora se haya mantenido en el ámbito de la ciencia ficción.

Leer más: Qué saber sobre ‘Stargate’, la nueva empresa de Openai anunciada por el presidente Trump

Y aunque quedan preguntas sobre el futuro de las restricciones de Chips en China, las prioridades de Washington eran evidentes en la orden ejecutiva de IA del presidente Trump, también firmada durante su primera semana en el cargo, lo que declaró que “es la política de los Estados Unidos sostener y mejorar El dominio global de IA de Estados Unidos para promover el florecimiento humano, la competitividad económica y la seguridad nacional “.

Mantener este dominio significará, al menos en parte, comprender exactamente lo que están haciendo las empresas tecnológicas chinas, así como protegerse de la propiedad intelectual de los Estados Unidos, dicen los expertos.

“Existe una buena posibilidad de que Deepseek y muchas de las otras grandes compañías chinas estén siendo apoyadas por el [Chinese] Gobierno, de manera más que una forma monetaria “, dice Edouard Harris de Gladstone Ai, quien también recomendó que las compañías de IA de EE. UU. Enduden sus medidas de seguridad.

¿A dónde va la IA desde aquí?

Desde diciembre, los nuevos modelos O1 y O3 de Openai han roto discos en las pruebas de razonamiento avanzado diseñadas para ser difíciles para los modelos de IA.

Leer más: Los modelos de IA se están volviendo más inteligentes. Las nuevas pruebas están corriendo para ponerse al día

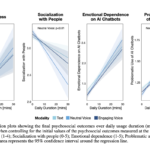

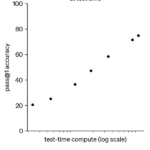

Deepseek R1 hace algo similar, y en el proceso ejemplifica lo que muchos investigadores dicen que es un cambio de paradigma: en lugar de escalar la cantidad de potencia informática utilizada tren El modelo, los investigadores escalan la cantidad de tiempo (y, por lo tanto, calculan la energía y la electricidad) que el modelo usa para pensar en una respuesta a una consulta antes de responder. Es esta escala de lo que los investigadores llaman “computa de tiempo de prueba” la que distingue la nueva clase de “modelos de razonamiento”, como Deepseek R1 y Openi’s O1, de sus predecesores menos sofisticados. Muchos investigadores de IA creen que queda mucho espacio para la cabeza antes de que este paradigma alcance su límite.

Algunos investigadores de IA elogiaron el R1 de Deepseek como un avance en el mismo nivel que Alphazero de Deepmind, un modelo de 2017 que se volvió sobrehumano en el ajedrez de los juegos de mesa y pasó simplemente jugando contra sí mismo y mejorando, en lugar de observar cualquier juego humano.

Esto se debe a que R1 no estaba “previamente” en los datos marcados con humanos de la misma manera que otros LLM principales.

En cambio, los investigadores de Deepseek encontraron una manera de permitir que el modelo arrancara sus propias capacidades de razonamiento esencialmente desde cero.

“En lugar de enseñar explícitamente al modelo sobre cómo resolver un problema, simplemente le proporcionamos los incentivos correctos y desarrolla de forma autónoma estrategias avanzadas de resolución de problemas”, afirman.

El hallazgo es significativo porque sugiere que las capacidades de IA poderosas podrían surgir más rápidamente y con menos esfuerzo humano de lo que se pensaba, con solo la aplicación de más potencia informática. “Deepseek R1 es como GPT-1 de este paradigma de escala”, dice Ball.

En última instancia, el reciente progreso de la IA de China, en lugar de usurpar la fuerza de los Estados Unidos, podría ser el comienzo de un reordenamiento: un paso, en otras palabras, hacia un futuro donde, en lugar de un poder hegemónico, hay muchos centros competidores de poder de IA.

“China aún tendrá su propia superinteligencia (s) no más de un año después de los Estados Unidos, ausente [for example] Una guerra “, escribió Miles Brundage, un ex empleado de políticas de Operai, en X.” Entonces, a menos que desee una guerra (literal), debe tener una visión para navegar por los resultados de IA multipolar “.